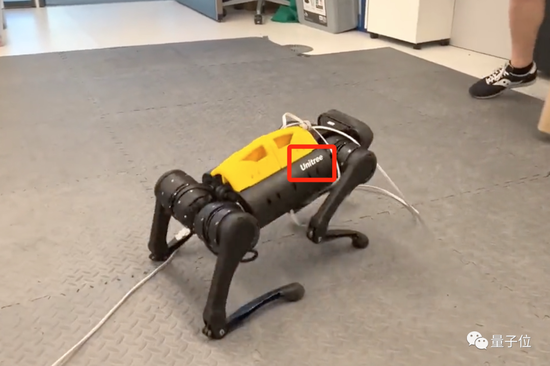

現在,讓機械狗自己打滾一個小時,它就能學會走路瞭!步態看著相當有模有樣,還能扛住大棍子的一通狂懟,就算是摔瞭個四仰八叉,翻個身自己又站起來瞭。

文/明敏

如此看來,訓機械狗和普通訓狗真是要沒什麼兩樣瞭啊。

這就是UC伯克利大學帶來的最新成果,讓機器人直接在實際環境中訓練學習,不再依賴於模擬器。

應用這一方法,研究人員在短時間內訓練出瞭4個機器人。

比如開頭看到的1小時學會走路的機械狗;

還有2個機械臂,在8-10小時實戰抓取後,表現接近於人類水平;

以及一個擁有計算機視覺的小機器人,在自己摸索2小時後,能絲滑地滾動到指定位置。

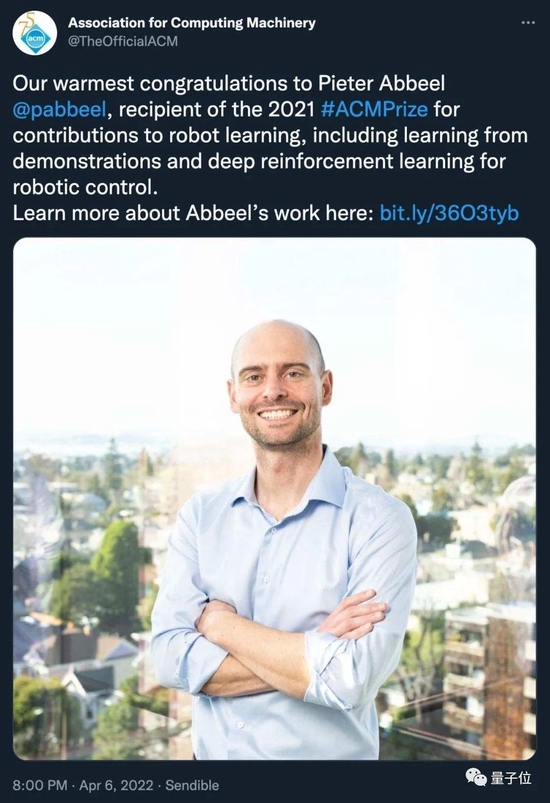

該研究由Pieter Abbeel等人提出,Pieter Abbeel是吳恩達的第一位博士生,前不久他剛剛獲得2021 ACM 計算獎(ACM Prize in Computing)。

目前,該方法的所有軟件基礎架構已經開源。

一個叫做“空想傢”的算法

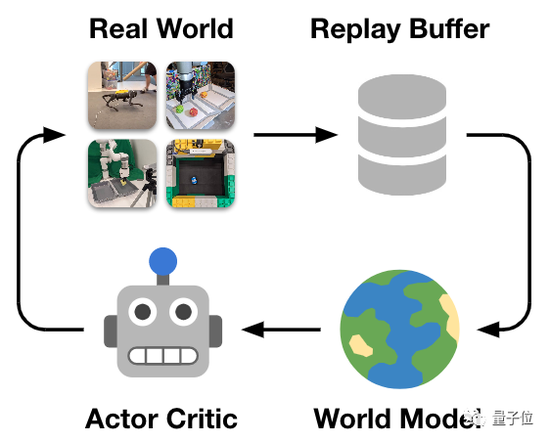

本文方法的pipeline大致可分為4步:

第一步,是先把機器人放在真實環境裡,收集數據。

第二步,把這些數據傳輸到Replay Buffer。這一步驟就是利用歷史數據進行訓練、“總結經驗”,高效利用收集到的樣本。

第三步,World Model會對已有經驗進行學習,然後“腦補”出策略。

第四步,再用演員評論傢(Actor Critic)算法來提升策略梯度法的性能。

然後循環往復,將已經提煉出的辦法再使用到機器人身上,最後達到一種“自己摸索學習”的感覺。

具體來看,這裡的核心環節是World Model。

World Models是2018年由DAVID HA等人提出的一種快速無監督學習方式,獲得瞭NIPS 2018的Oral Presentation。

它的核心理念是認為人類是基於已有經驗,形成瞭一個心理世界模型,我們所做的決定和行動都是基於這個內部模型。

比如人類在打棒球時,做出反應的速度遠比視覺信息傳達到大腦中的快,那麼在這種情況下還能正確回球的原因,就是因為大腦已經做出瞭本能的預測。

此前,基於World Model這種“腦補”的學習方法,Google提出瞭Dreamer這種可擴展的強化學習方法。

這一次提出的方法是在此基礎上,叫做DayDreamer。

(貌似可以叫做空想傢?

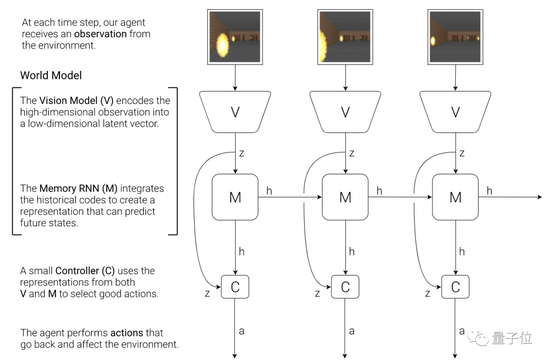

具體來看,World Model就是一個智能體模型。

它包括一個視覺感知組件,能將看到的圖像壓縮成一個低維的表征向量作為模型輸入。

同時還有一個記憶組件,可以基於歷史信息,對未來的表征向量做出預測。

最後,還包括一個決策組件,它能基於視覺感知組件、決策組件的表征向量,決定采取怎樣的動作。

現在,我們回到本次UC伯克利學者提出的方法。

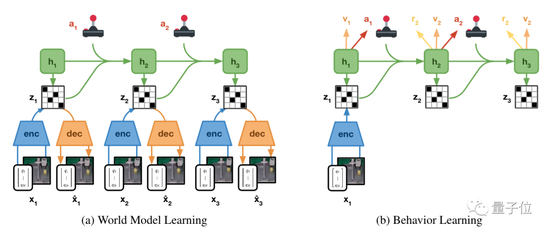

不難發現,其中World Model Learning部分的邏輯就是一個經驗積累的過程,Behavior Learning部分則是一個動作輸出的過程。

本篇論文方法的提出,主要解決瞭機器人訓練中兩方面的問題:

效率和準確率。

一般來說,訓練機器人的常規方法是強化學習,通過反復實驗來調整機器人的運作。

不過這種方法往往需要非常大量的測試,才能達到很好的效果。

不僅效率低下,而且訓練需要付出的成本也不低。

後來,不少人提出在模擬器中對機器人進行訓練,可以很好增效降本。

但是本文作者認為,模擬器訓練方法在準確性方面的表現還是不夠好,隻有真實的環境才能讓機器人達到最好的效果。

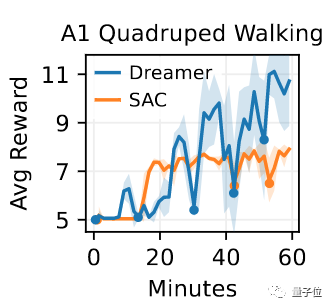

從結果來看,在訓練機器狗的過程中,隻花10分鐘時間,機器狗就能適應自己的行為瞭。

和SAC方法對比來看,效果有明顯提升。

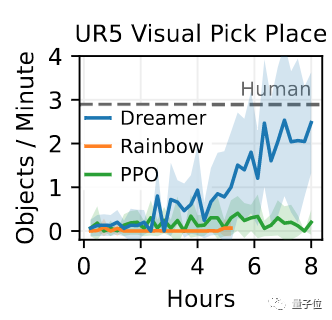

在機械臂訓練過程中,這一新方法還克服瞭視覺定位和稀疏獎勵的挑戰,幾小時內的訓練成果明顯優於其他方法。

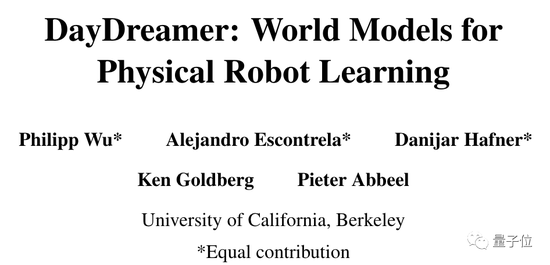

研究團隊

值得一提的是,本次帶來新成果的研究團隊成員,也非常令人矚目。

其中,Pieter Abbeel是吳恩達的開山大弟子。

他現在是UC伯克利電氣工程和計算機科學教授,伯克利機器人學習實驗室主任,伯克利AI研究院共同主任,曾加入過OpenAI。

前不久,他還獲得瞭2021 ACM 計算獎(ACM Prize in Computing),以表彰其在機器人學習方面的貢獻。

與此同時,他還是AI機器人公司Covariant的聯合創始人。

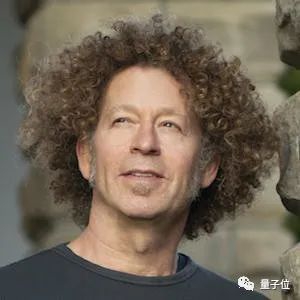

另一位Ken Goldberg,也是AI領域的頂級專傢。

他現在是UC伯克利工程教授,研究方向為強化學習、人機交互等。

2005年,他被評選為IEEE院士。

與此同時,Goldberg還是一位藝術傢,是UC伯克利藝術、科技文化研討會的奠基人。

此外,Philipp Wu、Alejandro Escontrela、Danijar Hafner三人為共同一作。

其中Philipp Wu還隻是UC伯克利一位大四的學生。

One More Thing

在觀看機械狗訓練的視頻時,我們發現研究人員使用的Unitree機械狗,

這個品牌來自中國企業宇樹科技,之前登上過春晚的機器小牛,也來自它傢。

而且,最近宇樹機器狗集體進行Go1測試的視頻曝光,還在國外火瞭一波。

論文地址:

https://danijar.com/project/daydreamer/

參考鏈接:https://worldmodels.github.io/