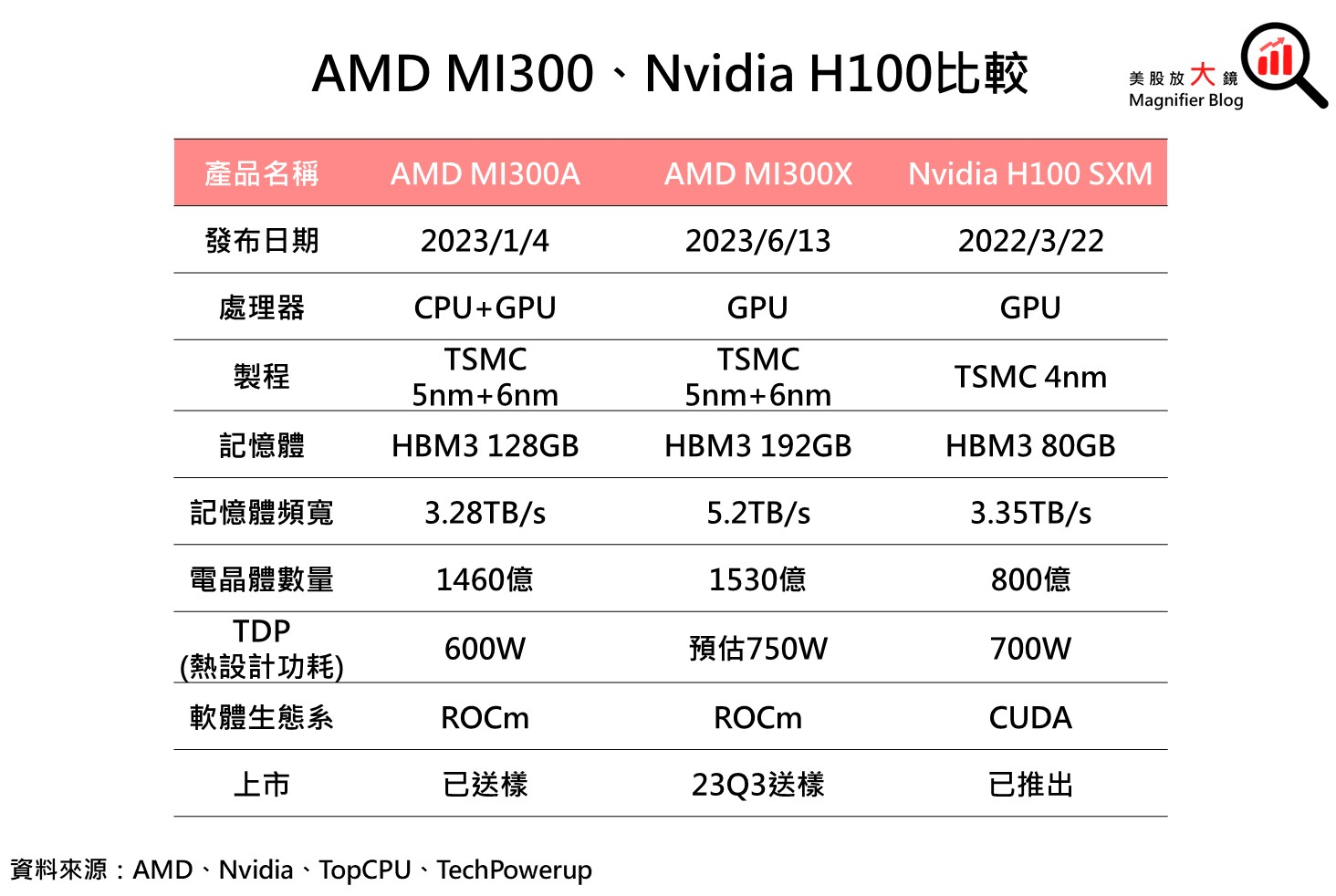

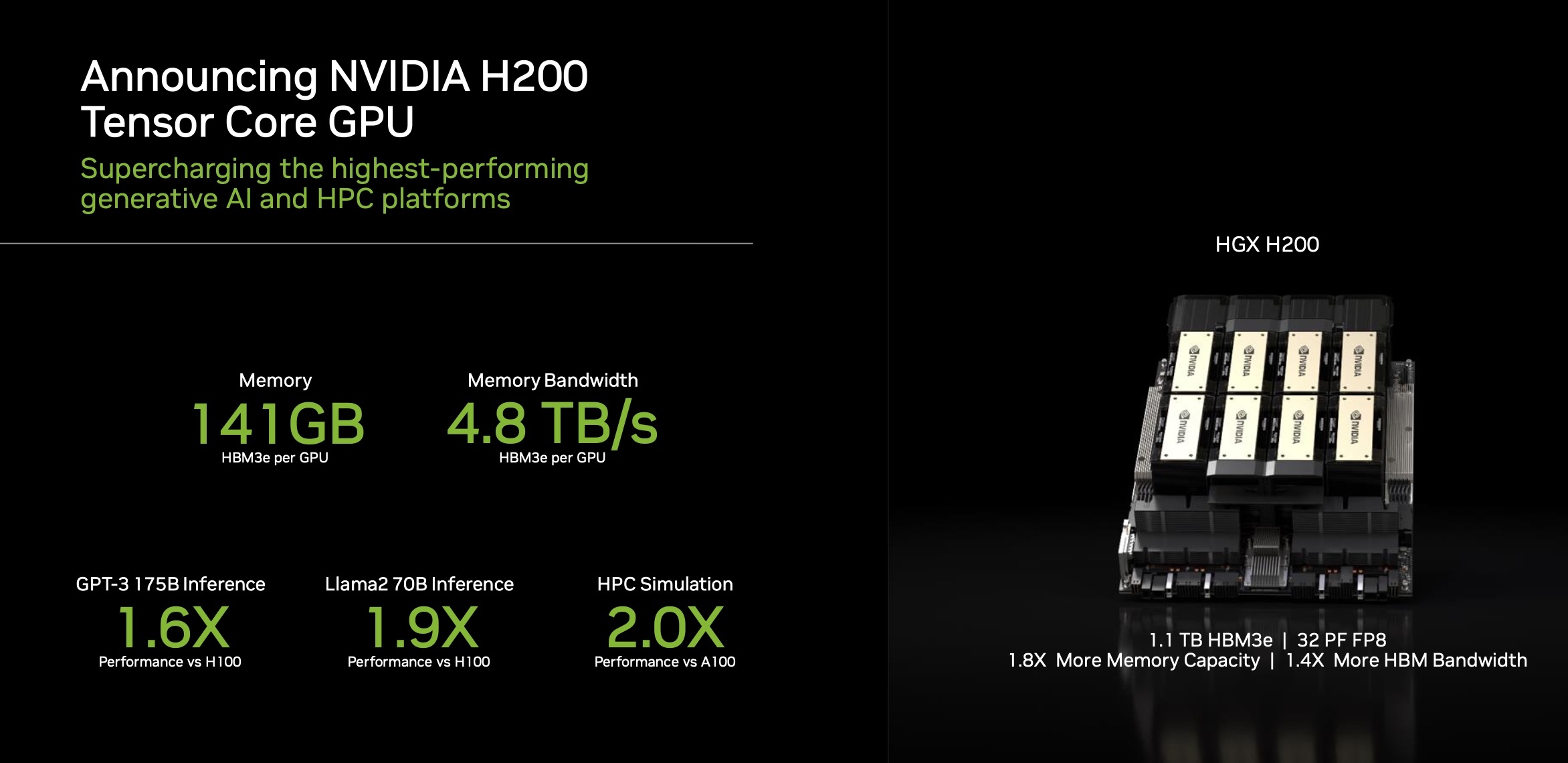

NVIDIAGPU已經在AI、HPC領域遙遙領先,但沒有最強,隻有更強。現在,NVIDIA又發佈全新的HGXH200加速器,可處理AIGC、HPC工作負載的海量數據。NVIDIAH200的一大特點就是首發新一代HBM3e高帶寬內存(疑似來自SK海力士),單顆容量就多達141GB(原始容量144GB但為提高良率屏蔽一點點),同時帶寬多達4.8TB/s。

對比H100,容量增加76%,帶寬增加43%,而對比上代A100,更是容量幾乎翻番,帶寬增加2.4倍。

得益於NVLink、NVSwitch高速互連技術,H200還可以四路、八路並聯,因此單系統的HBM3e內存容量能做到最多1128GB,也就是1.1TB。

隻是相比於AMD Instinct MI300X還差點意思,後者搭載192GB HBM3,帶寬高達5.2TB/s。

性能方面,H200再一次實現飛躍,700億參數的Llama2大語言模型推理性能比H100提高多達90%,1750億參數的GTP-3模型推理性能也提高60%,而對比前代A100 HPC模擬性能直接翻番。

八路H200系統下,FP8深度學習計算性能可以超過32PFlops,也就是每秒3.2億億次浮點計算,堪比一臺大型超級計算機。

隨著未來軟件的持續升級,H200還有望繼續釋放潛力,實現更大的性能優勢。

此外,H200還可以與采用超高速NVLink-C2C互連技術的NVIDIA Grace CPU處理器搭配使用,就組成GH200 Grace Hopper超級芯片,專為大型HPC、AI應用而設計的計算模塊。

NVIDIA H200將從2024年第二季度開始通過全球系統制造商、雲服務提供商提供。