“最強AI芯片”BlackwellB200GPU的高調發佈,已不單單是穩固英偉達在芯片領域的王者地位,更是讓業內人士高呼:新的摩爾定律誕生!在隔夜的2024GTC大會上,黃仁勛介紹運行AI模型的新一代芯片和軟件。他表示,新一代的B200GPU擁有2080億個晶體管,可以提供高達20petaflops的FP4性能。相比之下,H100僅為4petaflops。

在GTC直播中,黃仁勛左手舉著 B200 GPU,右手舉著 H100

此外,將兩個B200 GPU與單個Grace CPU 結合在一起的 GB200,可以為LLM推理工作負載提供30倍的性能,並且顯著提高效率。

黃仁勛還強調稱:“與H100相比,GB200的成本和能耗降低25倍!

關於市場近期頗為關註的能源消耗問題,B200 GPU也交出最新的答卷。

黃仁勛表示,此前訓練一個1.8 萬億參數模型,需要8000 個 Hopper GPU 並消耗15 MW電力。但如今,2000 個 Blackwell GPU就可以實現這一目標,耗電量僅為4MW。

在擁有1750億參數的GPT-3大模型基準測試中,GB200的性能是H100的7倍,訓練速度是H100的4倍。

值得一提的是,B200 GPU的重要進步之一,是采用第二代Transformer引擎。

它通過對每個神經元使用4位(20 petaflops FP4)而不是8位,直接將計算能力、帶寬和模型參數規模翻一倍。

而隻有當這些大量的GPU連接在一起時,第二個重要區別才會顯現,那就是新一代NVLink交換機可以讓576個GPU相互通信,雙向帶寬高達1.8TB/秒。

而這就需要英偉達構建一個全新的網絡交換芯片,其中包括500億個晶體管和一些自己的板載計算:擁有3.6 teraflops FP8處理能力。

在此之前,僅16個GPU組成的集群,就會耗費60%的時間用於相互通信,隻有40%的時間能用於實際計算。

一石激起千層浪,“最強AI芯片”的推出讓網友紛紛贊嘆。

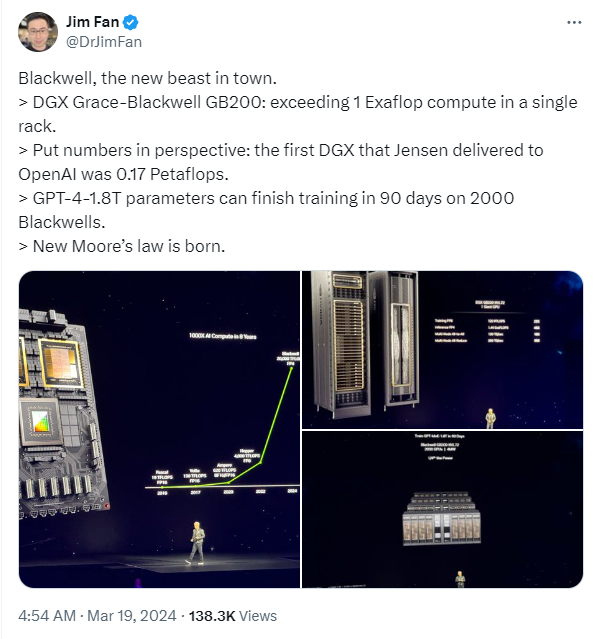

其中英偉達高級科學傢Jim Fan直呼:Blackwell新王誕生,新的摩爾定律已經應運而生。

DGX Grace-Blackwell GB200:單個機架的計算能力超過1 Exaflop。

黃仁勛交付給OpenAI的第一臺DGX是0.17 Petaflops。

GPT-4的1.8T參數可在2000個Blackwell上完成90天的訓練。

還有網友感嘆:1000倍成就達成!

Blackwell標志著在短短8年內,NVIDIA AI 芯片的計算能力實現提升1000倍的歷史性成就。

2016 年,“Pascal”芯片的計算能力僅為19 teraflops,而今天Blackwell的計算能力已經達到 20000 teraflops。