4月5日消息,當地時間周二,Alphabet旗下的谷歌公開一些新細節,展示用於訓練人工智能模型的超級計算機,稱其比英偉達A100芯片的系統更快、更節能。谷歌公司設計自己的定制芯片,稱為TensorProcessingUnit(TPU),並將這些芯片應用於90%以上的人工智能訓練工作。這個過程通過模型對數據進行訓練,以提高其在類似人類文本響應或生成圖像等任務中的實用性。

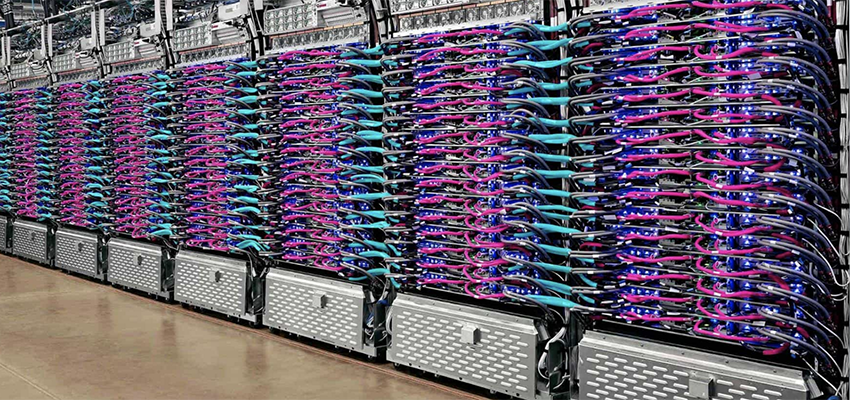

目前,谷歌TPU已經進入第四代。谷歌公司在周二發佈一篇科學論文,詳細介紹如何利用自己開發的定制光開關將4000多個芯片連接成一個超級計算機。

對於構建AI超級計算機的公司來說,改善這些連接已經成為競爭的關鍵點,因為所謂的大規模語言模型正在不斷增大,已無法在單個芯片上存儲,而這些模型正驅動著谷歌的Bard或OpenAI的ChatGPT等技術。

這類模型必須分佈在成千上萬的芯片之間,然後這些芯片要在數周或更長時間內協同工作來訓練模型。谷歌的PaLM模型,是迄今為止公開披露的最大語言模型,它通過分佈在兩臺4000芯片的超級計算機上進行50天的訓練。

谷歌表示,其超級計算機可以輕松地動態重新配置芯片之間的連接,有助於避免故障並進行性能優化。

“電路交換使得我們能夠輕松避開故障組件,”谷歌高級研究員Norm Jouppi和谷歌傑出工程師David Patterson在一篇關於該系統的博客文章中寫道。“這種靈活性甚至使我們能夠改變超級計算機互聯網絡的拓撲結構,以加速ML(機器學習)模型的性能。”

雖然谷歌直到現在才公開其超級計算機的詳細信息,但它自2020年以來就已經在俄克拉荷馬州梅斯縣的數據中心內運行。谷歌表示,初創公司Midjourney使用該系統來訓練其模型,該模型在輸入幾個詞的文本後可以生成新的圖像。

谷歌在論文中表示,與相同規模的系統相比,它的超級計算機比基於英偉達A100芯片的系統更快1.7倍,更節能1.9倍。據解,A100芯片早於第四代TPU面市。

谷歌表示,它沒有將第四代TPU與英偉達當前旗艦H100芯片進行比較,因為H100是在谷歌這款芯片應用後上市的,並且采用更新的技術。

谷歌暗示正在研發一款新的TPU,將與英偉達H100競爭,但沒有提供詳細信息。Jouppi告訴媒體,谷歌有“充足的未來芯片儲備”。