人工智能研究機構OpenAI3月14日發佈備受期待的文本生成AI模型GPT-4。GPT-4在關鍵方面對其前代GPT-3進行改進,例如提供更符合事實的陳述,並允許開發人員更輕松地規定其風格和行為。它是多模態的模型,可以理解圖像內容。但是,GPT-4也有嚴重的缺陷,與GPT-3一樣,該模型會產生“幻覺”並犯下基本的推理錯誤。

GPT-4發佈後,多傢媒體關註的焦點是,OpenAI並沒有透露很多細節,包括該模型有多大的參數,性能為什麼更好。“GPT-4是該公司發佈過的最機密的版本,標志著其從非營利性研究實驗室全面轉變為營利性科技公司。”《麻省理工科技評論》的文章稱。

OpenAI的首席科學傢伊利亞·蘇茨克沃(Ilya Sutskever)在公告發佈一個小時後通過視頻通話與GPT-4團隊成員交談時說:“你知道,我們目前無法對此發表評論。”“競爭非常激烈。”

為更好地解GPT-4的開發周期及其功能和局限性,科技媒體TechCrunch 14日采訪OpenAI的聯合創始人兼總裁格雷格·佈羅克曼(Greg Brockman)。當被要求比較GPT-4和GPT-3時,佈羅克曼說:“就是不同。”“(該模型) 仍然存在很多問題和錯誤……但你確實可以看到微積分或法律等技能的飛躍,從某些領域的非常糟糕到相對於人類來說實際上相當好。 ”

OpenAI高層,總左到右為首席技術官米拉·穆拉蒂、首席執行官山姆·奧特曼,總裁格雷格·佈羅克曼,首席科學傢伊利亞·蘇茨克沃。圖片來源:Jim Wilson

到底有多大的訓練參數?

測試結果顯示,在美國大學先修課程微積分BC考試中,GPT-4獲得4分(滿分5分),而GPT-3獲得1分。GPT-3.5是GPT-3和GPT-4的中間模型,也獲得4分。模擬律師考試方面,GPT-4以排名前10%的成績通過,GPT-3.5的分數徘徊在後10%左右。(詳見澎湃科技報道《OpenAI發佈多模態大模型GPT-4:直接開放API,ChatGPT升級》)

GPT-4更有趣的方面之一是多模態。與GPT-3和GPT-3.5隻能接受文本提示不同,GPT-4可以接受圖像和文本提示來執行某些操作。這是因為GPT-4接受圖像和文本數據的訓練,而其前代僅接受文本訓練。

GPT是Generative Pre-training Transformer(生成式預訓練Transformer)的縮寫。OpenAI於2018年推出具有1.17億個參數的GPT-1模型,2019年推出具有15億個參數的GPT-2,2020年推出有1750億個參數的GPT-3。ChatGPT是OpenAI對GPT-3模型微調後開發出來的對話機器人。

但是,OpenAI這次選擇不透露GPT-4訓練數據的具體規模。在新聞公告裡,OpenAI隻表示,它使用與ChatGPT相同的方法取得這些結果,通過人類反饋強化學習。這要求人類評分者對來自模型的不同響應進行評分,並使用這些分數來改進未來的輸出。

OpenAI表示,訓練數據來自“各種許可、創建和公開可用的數據源,其中可能包括公開可用的個人信息”,但當被詢問具體細節時,佈羅克曼拒絕TechCrunch的詢問。據悉,訓練數據之前曾讓OpenAI陷入關於版權的法律糾紛。

在接受《紐約時報》的采訪時,佈羅克曼則表示,OpenAI的數據集是“互聯網規模的”,這意味著它涵蓋足夠多的網站,可以提供互聯網上所有說英語的人的代表性樣本。

OpenAI的工作人員在辦公。圖片來源:Jim Wilson

“緩慢而有目的”地推廣圖像功能

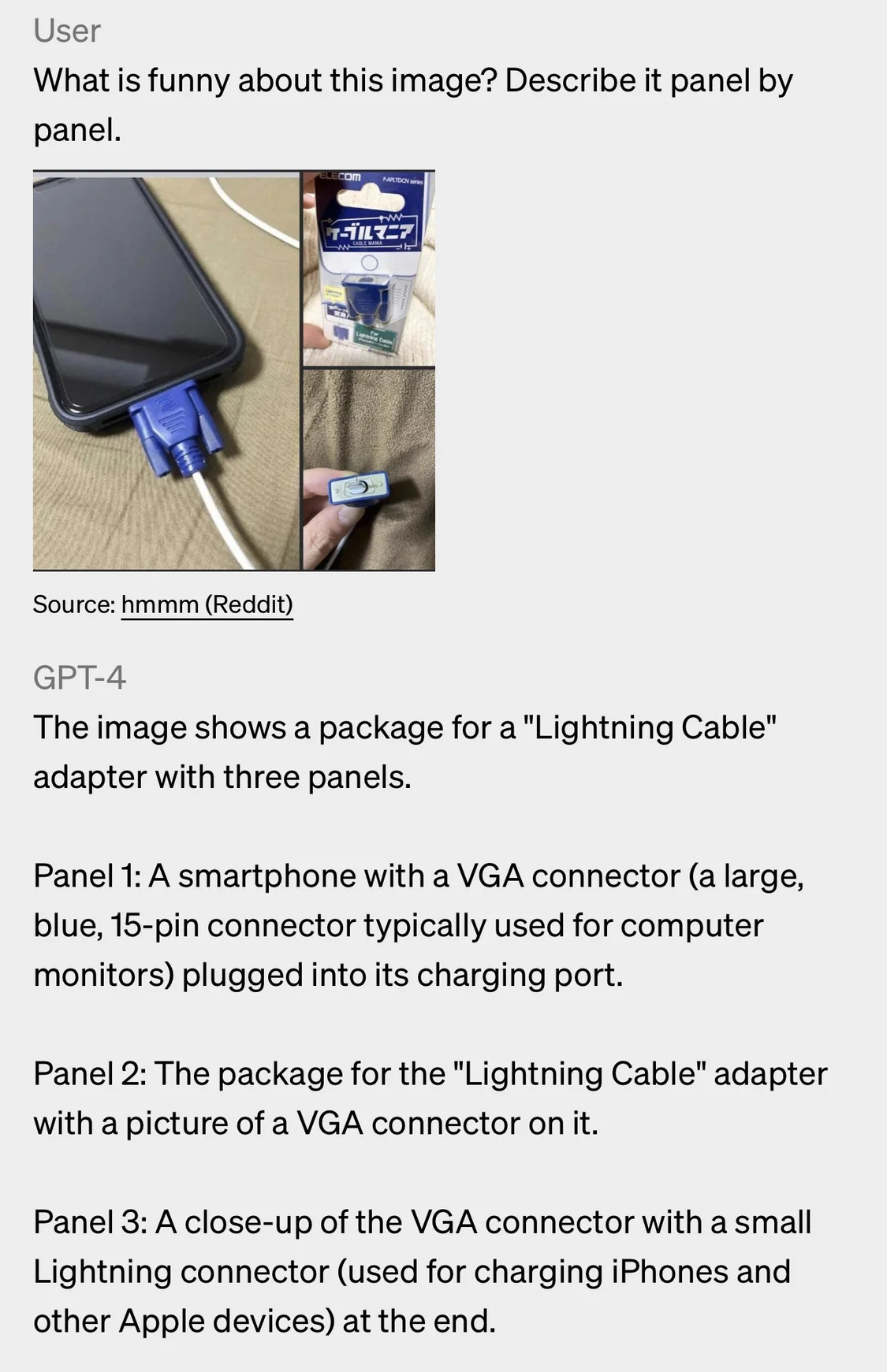

GPT-4的圖像理解能力令人印象深刻。例如,輸入提示“這張圖片有什麼好笑的?一個面板一個面板地描述它”,加上一張三面板圖像,顯示一條假VGA電纜被插入iPhone,GPT-4給出每個面板的詳細描述並正確解釋這個笑話:這個圖像中的幽默來自於荒謬地將過時的大的VGA連接器插入小的現代智能手機充電口。

GPT-4解讀圖像內容。

“在過去幾年裡,一個好的多模態模型一直是許多大型技術實驗室的聖杯。”開源大型語言模型BLOOM背後的人工智能初創公司Hugging Face的聯合創始人托馬斯·沃爾夫(Thomas Wolf)說, “但它仍然難以捉摸。”

從理論上講,結合文本和圖像可以讓多模態模型更好地理解世界。“它可能能夠解決語言模型的傳統弱點,比如空間推理。”沃爾夫說。尚不清楚GPT-4是否如此。

目前隻有一個OpenAI的合作夥伴可以使用GPT-4的圖像分析功能——一款名為Be My Eyes的視障人士輔助應用程序(詳見澎湃科技報道《第一批公司已采用GPT-4,都用它來做些什麼?》。佈羅克曼表示,隨著OpenAI評估風險和收益,無論何時進行更廣泛的推廣,都將是“緩慢而有目的”的。

佈羅克曼說,面部識別以及如何處理人物圖像等方面存在政策問題。”“我們需要弄清楚危險區域在哪裡,紅線在哪裡,然後隨著時間的推移弄清楚這一點。”

此前,OpenAI圍繞其文本到圖像系統DALL-E 2面臨類似的道德困境。在最初禁用該功能後,OpenAI又允許用戶上傳人臉以使用人工智能圖像生成系統對其進行編輯。當時,OpenAI稱其安全系統的升級使面部編輯功能成為可能,因為最大限度地減少深度造假,以及試圖創造性、政治和暴力內容的潛在危害。

“從每3個月發佈一個新模型轉向不斷改進”

另一個老問題是防止GPT-4以可能造成傷害的方式被使用,包括心理、金錢等方面。該模型發佈數小時後,以色列網絡安全初創公司Adversa AI發佈一篇博文,展示繞過OpenAI內容過濾器並讓GPT-4生成網絡釣魚電子郵件、對同性戀者的攻擊性描述和其他令人反感的文本的方法。

這在語言模型領域並不是一個新現象。Meta的BlenderBot和ChatGPT也被提示說出非常冒犯的話,甚至透露有關其內部運作的敏感細節。但許多人曾希望,GPT-4可能會在這方面帶來重大改進。

當被問及GPT-4的穩健性時,佈羅克曼強調該模型已經接受5個月的安全訓練,並且在內部測試中,它響應OpenAI政策不允許的內容請求的可能性降低82%。

“我們花很多時間試圖解GPT-4的能力。”佈羅克曼說,“把它帶到外面的世界是我們學習的方式。我們不斷進行更新,包括一堆改進,這樣模型就更能擴展到你希望它處於的任何個性或某種模式。”

佈羅克曼並不否認GPT-4的不足,但他強調該模型新的緩解性控制工具,包括一種稱為“系統”消息的API(應用程序編程接口)級能力。系統消息本質上是為GPT-4的互動設定基調並建立界限的指令。例如,一條系統信息可能是這樣的:“你是一個總是以蘇格拉底方式回答問題的輔導員。你從不給學生答案,而總是試圖提出正確的問題,幫助他們學會自己思考。”系統信息作為護欄,可以防止GPT-4偏離方向。

“真正弄清楚GPT-4的語氣、風格和內容一直是我們的一個重要焦點。”佈魯克曼說,“我認為我們開始有點解如何做工程,如何有一個可重復的過程,讓你得到可預測的結果,對人們真正有用。”

佈羅克曼還提到Evals,這是OpenAI剛剛開源的軟件框架,用於評估其人工智能模型的性能,是OpenAI致力於“健全”其模型的一個標志。Evals讓用戶開發和運行評估GPT-4等模型的基準,同時檢查其性能,這是一種模型測試的眾包方法。

“通過Evals,我們可以以一種系統的形式看到用戶關心的(用例),能夠進行測試。”佈羅克曼說,“我們(開源)的部分原因是,我們正在從每3個月發佈一個新模型轉向不斷改進。做東西應該要衡量,對嗎?當我們制作新的版本時,我們至少可以知道這些變化是什麼。”

新的上下文窗口

佈羅克曼還談到GPT-4的上下文窗口(context window),它指的是模型在生成其他文本之前可以考慮的文本。OpenAI正在測試GPT-4的一個版本,它可以“記住”大約50頁的內容,是普通版GPT-4在其“記憶”中所能容納的內容的五倍,是GPT-3的八倍。

佈羅克曼認為,擴大的上下文窗口會帶來新的、以前沒有探索過的應用,特別是在企業中。他設想一個為公司建造的人工智能聊天機器人,利用來自包括各部門員工的不同來源的背景和知識,以一種非常明智但對話性的方式回答問題。

這不是一個新概念。但佈羅克曼提出的理由是,GPT-4的答案將比今天的聊天機器人和搜索引擎的答案有用得多。

“以前,該模型對你是誰、你對什麼感興趣等沒有任何解。”佈洛克曼說,有這種歷史(更大的上下文窗口),肯定會讓它更有能力......它會使人們能做的事更多。”

科學交流類似於產品新聞稿

即使看過佈羅克曼的采訪,但GPT-4還有很多謎團沒有解開。“OpenAI現在是一傢完全封閉的公司,其科學交流類似於產品新聞稿。”沃爾夫說。

《麻省理工科技評論》認為,當下,GPT-4與其他多模態模型並駕齊驅,包括來自人工智能研究機構DeepMind的Flamingo。Hugging Face也正在開發一種開源多模態模型,其他人可以免費使用和改編該模型。面對這樣的競爭,OpenAI將GPT-4更多地視為產品挑逗,而不是研究更新。

目前,構建和服務聊天機器人非常昂貴,因為它是在更大量的數據上訓練的,所以GPT-4會增加OpenAI的成本。OpenAI的首席技術官米拉·穆拉蒂(Mira Murati)告訴《紐約時報》,如果該服務產生過多流量,該公司可能會限制對該服務的訪問。

但從長遠來看,OpenAI計劃構建和部署可以處理多種媒體的系統,包括聲音和視頻。“我們可以采用所有這些通用知識技能,並將它們傳播到各種不同領域。”佈羅克曼說,“這將技術帶入一個全新的領域。”

許多其他公司正在排隊等候。“對於大多數公司來說,啟動這種規模的模型的成本是無法承受的,但是OpenAI所采用的方法使大型語言模型對於初創公司來說非常容易獲得。”Tola Capital的聯合創始人謝拉·古拉提(Sheila Gulati)說, “這將在GPT-4之上催化巨大的創新。