在其他以人工智能為重點的發佈會中,Google今天分享其較新的"多重搜索"功能現在將在移動設備上向全球用戶提供,在任何已經有GoogleLens的地方都可以使用。該搜索功能允許用戶同時使用文本和圖像進行搜索,於去年4月首次推出,作為Google搜索現代化的一種方式,以更好地利用智能手機的功能。

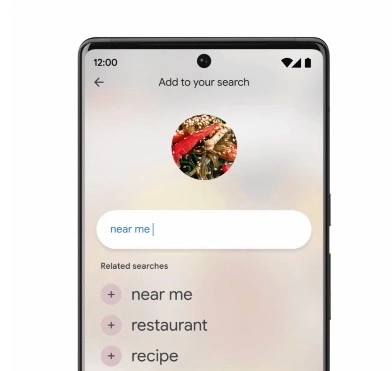

在此基礎上的一個變種"multisearch near me",即針對本地企業的搜索也將在未來幾個月內在全球范圍內推出,同時還將推出針對網絡的multisearch和針對Android用戶的新Lens功能。

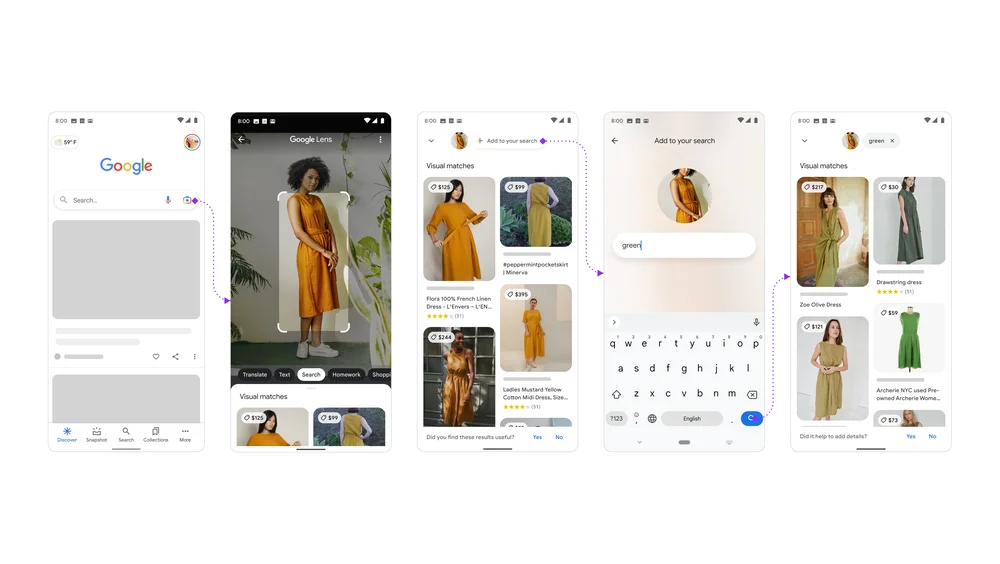

正如Google之前所解釋的那樣,多重搜索由名為"多任務統一模型"的人工智能技術提供支持,該技術能夠理解各種格式的信息,包括文本、照片和視頻,然後在主題、概念和想法之間得出洞察力和聯系。Google將其應用於其Google Lens視覺搜索功能中,它將允許用戶在視覺搜索查詢中添加文本。

"我們通過引入Lens重新定義我們對搜索的意義。此後,我們把Lens直接帶到搜索欄,並繼續帶來新的功能,如購物和逐步的傢庭作業幫助,"Google負責搜索、助理、地理、廣告、商務和支付產品的高級副總裁Prabhakar Raghavan在巴黎的一次新聞發佈會上說。

例如,用戶可以在Google搜索中調出一張他們喜歡的襯衫的照片,然後問Lens在哪裡可以找到相同的圖案,但要在不同類型的服裝上,如裙子或襪子。或者他們可以把手機對準自行車上的一個破損部件,然後在Google搜索中輸入"如何修復"這樣的查詢。這種文字和圖像的結合可以幫助Google處理和理解它以前無法處理的搜索查詢,或者單用文字輸入會更困難。

這項技術對購物搜索最有幫助,用戶可以通過這種方法找到喜歡的服裝,但顏色或款式不同。或者可以拍一張傢具的照片,比如一套餐桌,來尋找相匹配的物品,比如一張咖啡桌。

Google說,在多重搜索中,用戶還可以通過品牌、顏色和視覺屬性來縮小和細化他們的搜索結果。這項功能於去年10月向美國用戶提供,然後於12月擴展到印度。Google表示,從今天起,全球所有用戶都可以在移動平臺上使用多重搜索功能,而且是在有Lens的所有語言和國傢。

Google今天表示,"multisearch near me"的變化也將很快擴大。

Google去年5月宣佈,它可以將多搜索查詢引向當地企業(又稱"multisearch near me"),這將返回用戶正在尋找的、與當地零售商或其他企業的庫存相匹配的物品的搜索結果。例如,在自行車零件損壞的情況下,你可以在帶有照片的搜索查詢中添加"我附近"的文字,以找到擁有替換零件的當地自行車店或五金店。

Google表示,這一功能將在未來幾個月內應用於所有提供Lens的語言和國傢。在未來幾個月裡,它還將擴展到移動設備之外,支持網絡上的多重搜索。

在新的搜索產品方面,這傢搜索巨頭預告即將推出的Google Lens功能,指出Android用戶很快就能在手機上跨應用和網站搜索他們在照片和視頻中看到的內容,同時還能留在應用或網站上。Google稱這是"搜索你的屏幕",並表示隻要提供Lens的地方就可以使用這一功能。

Google還分享Google Lens的一個新的裡程碑,指出人們現在每月使用該技術超過100億次。