特斯拉和埃隆-馬斯克(ElonMusk)的人工智能企業xAI共同儲備大量NVIDIAH100GPU,前者致力於徹底破解五級自動駕駛難題,後者則試圖實現馬斯克"最大限度尋求真理的人工智能"願景。

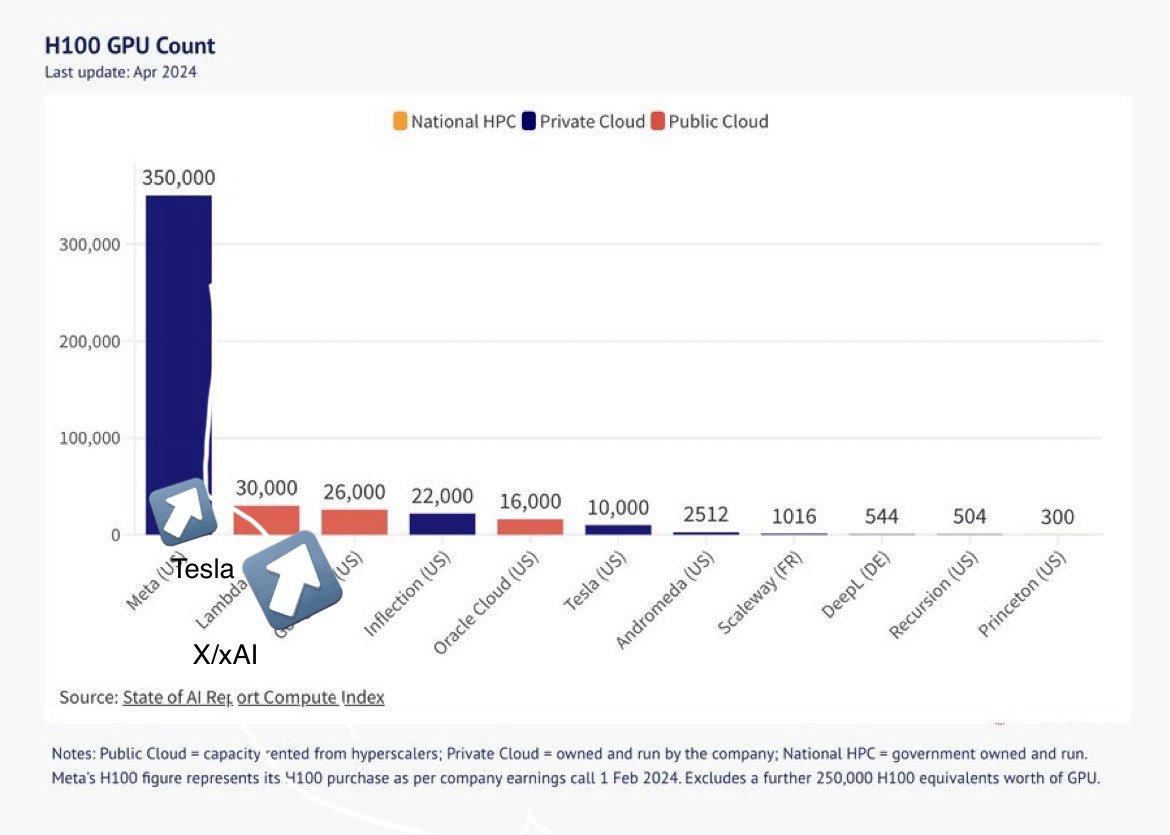

X 帳戶"技術兄弟"最近發佈消息稱,馬克-紮克伯格的 Meta 公司目前已擁有全球最大的 H100 GPU “武器庫”之一,數量約為 35 萬個。不過,馬斯克對該表格中特斯拉和 xAI 的排名不以為然,他指出:"如果衡量正確的話,特斯拉會排在第二位,X/xAI 會排在第三位。"

假設其他條件不變,這意味著特斯拉現在擁有 3 萬到 35 萬塊英偉達 H100 GPU。另一方面,xAI 現在可能擁有 2.6 萬到 3 萬塊英偉達AI計算卡。

早在今年 1 月,埃隆-馬斯克(Elon Musk)在確認對特斯拉 Dojo 超級計算機投資 5 億美元(相當於約 1 萬個 H100 GPU)的同時,還宣佈這傢電動汽車巨頭"今年在英偉達硬件上的花費將超過這個數字",因為"在人工智能領域具有競爭力的賭註目前每年至少有幾十億美元"。

在馬斯克從DeepMind、OpenAI、Google研究院、微軟研究院、特斯拉和多倫多大學聘請人才,從頭開始建立自己的人工智能企業時,xAI曾在2023年購買大約1萬臺英偉達的GPU。不過,可以合理推斷,這些采購很可能與 A100 GPU 有關。此後,從馬斯克最新發佈的 X 帖子中可以推斷,xAI 似乎還積累大量的 H100 GPU。

當然,考慮到人工智能領域的創新速度,這些 H100 GPU 很快就會過時。早在今年 3 月,英偉達就發佈GB200 Grace Blackwell 超級芯片,將一個基於 Arms 的 Grace CPU 與兩個 Blackwell B100 GPU 結合在一起。該系統可以部署一個包含27 萬億個參數的人工智能模型,在執行聊天機器人提供答案等任務時,速度有望提高30 倍。