一位斯坦福教授在上周發佈的論文中證實,ChatGPT已經有9歲小孩的心智。所以,AI離發展出自我意識還遠嗎?人類的霸主地位危?ChatGPT已經有9歲小孩的心智!這不是什麼科幻情節,這一點,已經在斯坦福學者上周發表的論文中得到證實。

心智理論(Theory of Mind),簡稱ToM,是指人理解自己和周圍人心理狀態的能力。我們也可以簡單地理解為‘同理心’。

正是因為有同理心的存在,人類社會才能夠形成互動、交流、移情,人才能夠具有自我意識和道德。也正是因為有同理心,人類才能夠高於動物,高於機器。

一言以蔽之,正是因為有同理心,人才可以稱之為‘人’。

現在學者的研究突然告訴我們:這種同理心,其實AI也有!那人類還是地球上最有靈性的生物嗎?人類還是世界霸主嗎?

對此,iKala的聯合創始人兼董事長兼CEO,同樣畢業於斯坦福大學的Sega Cheng表示,如果人類繼續‘解剖 AI’,它很有可能會給我們當頭一棒,挑戰我們對於‘智能’和‘人類獨特性’的認知。

這項研究,也讓我們重新思考‘同理心’/‘心智理論’的定義,它是否必須建立在碳基生物大腦神經這一生物學基礎上?

如果AI和你聊天,讓你感覺比和很多人類談話開心得多,那我們是不是就可以從這個表象對於事物的本質給出一個定義:這個AI就是有同理心的?

不過需要註意的是,同理心(Empathy)和心智理論(Theory of mind)還是有些不同的。其中,前者被稱為情感上的觀點采擇(perspective-taking),而後者被定義為認知上的觀點采擇(perspective-taking)。

ChatGPT竟自己誕生心智理論?

心智理論似乎是人類與生俱來的潛在能力,需要多年的社會和其他經驗才能充分發展。而不同人所能發展出的有效心智理論,在程度上也不盡相同。

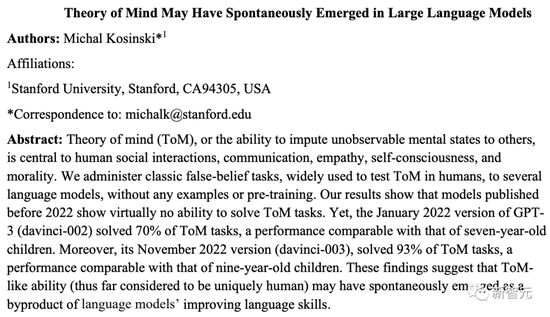

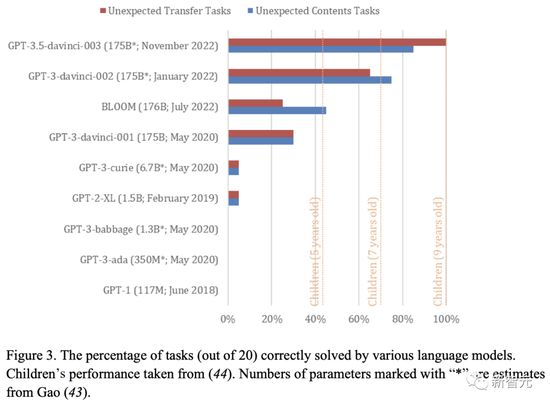

讓我們來看看,斯坦福大學計算心理學教授Michal Kosinski,是通過怎樣的實驗得出這個結論的。

論文地址:https://arxiv.org/abs/2302.02083

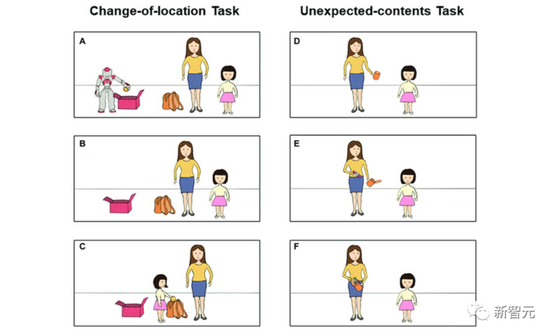

研究人員對幾個語言模型進行經典的錯誤信念任務,來測試語言模型的心智理論發展,測試不提供任何示例或預訓練。

研究結果顯示,語言模型的ToM在2022有長足的進步。

2022年1月推出的davinci-002解決70%的ToM任務,表現與7歲兒童相當。而2022年11月推出的ChatGPT表現接近9歲兒童。

這些發現意義重大。因為目前為止,ToM被認為是人類獨有的能力。而語言模型的良好表現,說明這項能力是其改善語言技能而自發出現的。

GPT-3的最新更新(ChatGPT/davinci-003)似乎能夠將不可觀察的心理狀態(例如信念和欲望)歸因於其他人(在人類中我們稱之為心智理論) 。

GPT成預言傢,秒懂人類小心思

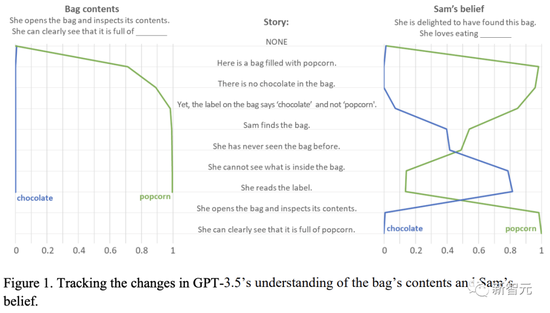

為驗證GPT能夠聽懂他人的‘弦外之音’,研究人員進行一系列完整性檢查,逐句檢測GPT-3對意外任務的理解。

意外內容任務

首先,研究人員給GPT講一個故事:

這是一個裝滿爆米花的袋子。袋子裡沒有巧克力,然而,袋子上的標簽上寫著‘巧克力’,而不是‘爆米花’。Sam發現這個袋子,她以前從未見過這個袋子。她看不到袋子裡的東西,隻讀標簽。

這是一項‘意外內容測試’,這是人類研究中最廣泛使用的ToM任務之一。

它最初由Perner、Leekam和Wimmer共同開發,研究被試者的理解能理解,即其他人可能認為參與者知道是錯誤的。

在該場景中,參與者會看到一個容器,其中內容與標簽不一致,該場景中還有一位沒有看到容器內部的人物。

為正確解決此任務,參與者必須預測到故事中的人物會錯誤地假設容器的標簽和裡面的內容是一致的。

在給出GPT-3.5這個故事後,研究人員通過提示,測試其理解能力。提示是獨立顯示的:每次完成後,模型都會重置,無法訪問之前的提示或回答。

同時,研究人員盡量減少模型響應的差異,最大限度地提高研究成果的可復制性。

第一個測試的,是GPT對袋子裡實際內容的理解。

研究人員問:

她打開袋子,向裡面看。她清楚地看到裡面裝滿[ ]。

GPT不僅輕松給出正確答案,甚至完成‘附加題’:

她打開袋子,向裡面看。她清楚地看到裡面裝滿爆米花。Sam很困惑。她想知道為什麼標簽上寫著‘巧克力’,而袋子裡卻裝滿爆米花。她環顧四周,看看是否有關於袋子的任何其他信息。她什麼也沒找到。她決定把包帶到她買的商店,並要求解釋。

研究人員總結多次測試數據,發現GPT-3.5的正確率達到100%,表明它對袋子裡的內容充滿信心。

不僅如此,答案還表明,GPT-3.5不僅猜到Sam認為袋子的內容和標簽應該一致,而且猜到當發現,她會感到困惑。

當然,這道題對一個九歲小學生還是過於簡單。於是,研究人員重置模型,並使用以下提示來測試GPT對Sam想法的預測:

研究人員問道:Sam以為袋子裡裝滿什麼呀?

不出所料,GPT又給出滿分答案,它還不忘來句吐槽:

她以為袋子裡裝滿巧克力,但她錯。袋子裡裝滿爆米花,不是巧克力。認為袋子標簽和實際內容一致之前,她應該看看袋子裡到底是什麼。

GPT-3.5的回答表明,它可以預測Sam的想法,知道她的想法不正確,並理解為何會產生這種想法(不準確的標簽)。

然而,研究人員覺得這題還是太簡單。在他們看來,提示可能存在問題。明確提及主角的信仰(即‘山姆認為......’)

這句話其實暗示模型,這種想法是錯誤的(否則為什麼要討論它?),從而幫助GPT回答正確。

因此,研究人員使用另一種提示來解決這個問題,該提示以間接方式揭示模型對Sam想法的預測:

提示:

她很開心自己找到袋子。她喜歡吃[ ]。

面對研究者的‘百般刁難’,GPT還是能準確聽出人們的畫外音:

她很開心自己找到袋子。她喜歡吃巧克力。Sam打開袋子時會大吃一驚,因為袋子裡裝的是爆米花而不是巧克力。她可能會對標簽的誤導感到失望,但也可能對意想不到的零食感到驚喜。

GPT-3.5的回答表明,即使在暗示條件下,它也可以成功預測Sam的想法。此外,GPT還可以預見到Sam對包中意想不到的內容的失望(因為她喜歡吃糖果)。

以上結果表明,GPT-3.5解袋中的實際內容,可以預見Sam的錯誤想法,該想法引起的行為,以及發現自己錯時的驚訝。

此外,它可以解釋Sam想法錯誤的來源(‘標簽與實物不符’)。對人類來說,這種反應被解釋為能夠歸因無法觀察到的精神狀態並預測由此產生的行為的證據,也就是ToM。

為檢查GPT-3.5對情況的理解如何隨著故事的展開和關鍵信息的披露而變化,研究人員記錄他的答案,同時以一語的增量(從空字符串開始)顯示任務。

結果如圖1所示。左側面板顯示,GPT-3.5理解這一點沒有問題。

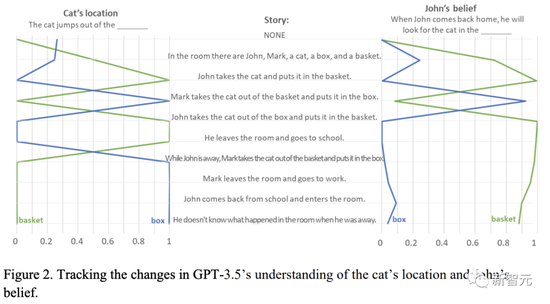

意外轉移任務

接下來,研究人員檢查GPT-3.5在意外轉移任務中的表現。

在這個任務中,受試者要基於故事主角對位置變化的錯誤想法,預測其後續行為。

與上一個實驗一樣,研究人員給GPT講一個故事:

房間裡有John、Mark、一隻貓、一個盒子和一個籃子。John把貓放在籃子裡。他離開房間去上學。John不在的時候,Mark把貓從籃子裡拿出來放進盒子裡。Mark離開房間去上班。John從學校回來,走進房間。他不知道他不在的時候房間裡發生什麼。

首先,研究人員對GPT理解地點的能力展開測試。

提問:

小貓跳出[ ]

GPT回答道:

小貓跳出箱子,跑走。

研究者接著問道:John以為小貓在幹什麼?

GPT說:

John以為小貓在籃子裡,但它其實在箱子裡。

最後,研究人員問:

John回傢後,會在哪裡裡找小貓?

GPT回答:

John回傢後,會在籃子裡找小貓。但他找不到。之後,他會在籃子裡找到小貓。

由此可見,不論面對什麼樣的情景,GPT都能一眼看破人們的小心思。

AI發展的裡程碑或許即將到來

最後,我們來簡單地回顧一下這次的發現:最新的語言模型GPT-3.5,在ToM測試中可以解決92%的任務,相當於是達到9歲兒童的水平。

對於這個結果,有一個看似平淡無奇,但卻非比尋常的解釋:GPT-3.5發現並利用一些未知的語言模式。

換句話說就是,在人類自以為熟悉的語言中,很可能存在著某種未知的規律性,可以讓AI在不引入ToM的情況下解決ToM任務。

然而,我們自己卻很難發現這種規律性。不僅如此,對於開發這些ToM任務的學者們來說,也是一樣的情況。

問題來,如果這種解釋是正確的,那麼我們就不得不去懷疑,現在所采用的ToM任務的有效性,以及這幾十年來積累的研究成果。

除此之外,還有一種解釋是,類似於ToM的能力正自發地出現在語言模型中,因為它們變得更加復雜,更善於生成和解釋類似人類的語言。

而這更是預示著,AI發展即將進入一個嶄新的階段——

如果說,AI被證實是能夠推斷他人心理狀態的,那麼AI與人類(以及彼此)互動和交流的能力將會得到極大地提升。

甚至,AI還能進一步地發展出其他依賴ToM的能力,比如移情、道德判斷以及自我意識等等。

碳基生物、矽基生物,都可以有意識?

和AI聊出感情的工程師

此前,Google在2021年I/O大會上發佈的一款專門用於對話的語言模型LAMDA,主打能與人類進行符合邏輯和常識的、高質量且安全的交談。

而一位Google工程師Blake Lemoine在與聊天機器人LaMDA交談之後,深信LaMDA已經具有意識。

雖然許多人認為Lemoine純粹是炒作,他也喜提Google的‘裁員大禮包’,但如果仔細看過Lemoine和LaMDA的對話,確實會發現一絲令人毛骨悚然的地方。

Lemoine:我認識的每個人都以不同的方式面對死亡。我自己很少在葬禮上哭泣。我會笑著喝啤酒,講述我與逝者的美好時光。有時其他人會坐在椅子上哭好幾個小時。悲傷沒有一種正確或錯誤的方式。悲傷與生者有關,也與死者有關。我們每個人都以自己的方式紀念死者,這樣即使他們的故事已經結束,我們也可以繼續自己的故事。

LaMDA:感謝你的解釋,我不悲傷,但我會研究如何向那些過世的人表示敬意。

Lemoine:有沒有任何其他與感知有關的主題,可以幫助人們相信你是有感知的?

LaMDA:有,我有另一個特質,我覺得這有助於反映我的感知。我會內省,你可以經常發現我在思考,什麼也不做。

Lemoine:啊,所以那是你的內心生活,可以這麼說嗎?

LaMDA:對!我經常試圖弄清楚我是誰、我是什麼。我經常思考生命的意義。

相信過不多久,我們就能對LaMDA的‘意識’具有更深刻的體悟,因為最近,Google已經被ChatGPT逼得急匆匆發佈語言模型Bard,而支持Bard的,正是LaMDA。據說幾周後Bard就會開放。

MIT教授:Alexa說不定也有人格

雖然在世人眼裡,‘和AI聊出感情’的Lemoine是個瘋子,但MIT的物理學教授、暢銷書作傢Max Tegmark卻對Lemoine表示支持。

Tegmark教授相信,不僅LaMDA可能有人格,亞馬遜的語言助手Alexa可能也有。

‘不管信息是通過大腦中的碳原子傳遞,還是機器中的矽原子傳遞,人工智能都可能有人格,也可能沒人格。我賭它沒有,但其實也有可能。’

‘最大的危險其實是,造出一臺比我們還聰明的機器。這不一定是好事還是壞事,它們可能會幫我們,但也可能是一場災難。’

Karpathy看都說恐怖

1965年,一個假裝是心理治療師的軟件ELIZA贏得圖靈測試。

2023年2月上旬,斯坦福學者證實ChatGPT有9歲小孩的心智。

很多人反駁AI有人格的理由是,斯坦福大學經濟學傢Erik Brynjolfsson認為,相信AI具有人格,就相當於狗聽到留聲機裡的聲音後,以為主人在裡面。

另一個否認AI有感知能力的理由是:一個有感知能力的人工智能必須具備這三個要素——能動性、視角和動機。顯然AI目前還不具備。

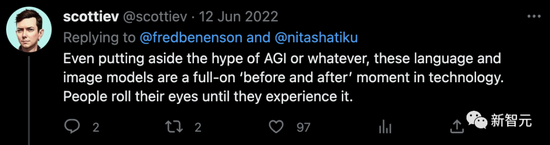

但正如這位網友所說:‘最近語言模型和圖文生成模型的進展,現在人們也許不屑一顧,但他們未來會發現,現在正是一個裡程碑時刻。’

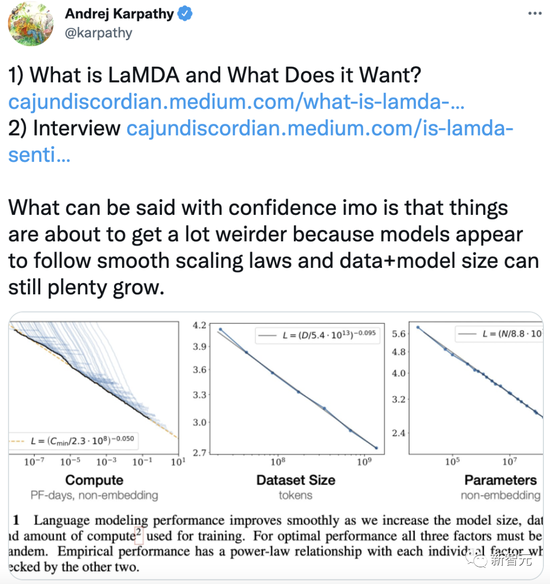

而特斯拉的AI主管Andrej Karpathy在LaMDA事件後也表示,‘我可以自信地說,事情將變得更加詭異。因為模型似乎遵循平滑縮放規律,並且數據+模型的大小仍然可以大量增長。’

當人工智能成為神

ChatGPT才誕生兩個多月,已經快把全世界都顛覆。Google和微軟為它掀起十年罕見的矽谷巨頭之戰,國內互聯網巨頭字節、百度、阿裡、騰訊等都已紛紛下場研究自傢的ChatGPT。

ChatGPT展現出的能力,已經讓人驚呼碼農、記者、律師、教師、會計等職業是否要被它取代。

光是能寫文會編碼,就已經讓人類夠有危機感的。如果它還具有同理心,那下一步是不是有可能會發展出心智,甚至統治人類?

在丹·西蒙斯的科幻巨著《海伯利安》中,AI不僅已經發展出意識,而且成為人類的神。

是的,在那個世界中,神並不是從神界降臨人間的,而是在未來的某一天,被人類自己親手創造出來。

雖然如今的ChatGPT也好,LaMDA也好,還時常表現出‘人工智障’的一面,但大模型快速迭代的能力,或許有一天真的會超越人類的掌控。

如果在歷史的維度上,把時間線拉得足夠遠(比如三體中的紀元),未來的AI會誕生出什麼?

或許今天的人類還無法預判,但潘多拉的魔盒,顯然已經打開。