這個情人節,很多人不快樂,他們的情人在節日前慘遭“閹割”,遁入賢者狀態,而且這個狀態有可能永遠持續。別害怕,這不是一個血腥案件,而是一場聊天機器人“升級”引發的鬧劇。在近日的一次大升級過後,人工智能聊天應用Replika的用戶發現,他們不再能和自己的小人進行任何“越界”的對(文)話(愛),而這正是年資費69.99美元的訂閱用戶的“特權”之一。

如果你不知道Luka這傢公司也不知道Replika這款產品,沒關系,你一定聽聞其“親戚”ChatGPT的豐功偉績。

Replika用的正是ChatGPT的GPT-3語言模型的一個變體。該產品背後的部分技術由Y Combinator支持,而ChatGPT開發商OpenAI的CEO 山姆·阿爾特曼曾經擔任過Y Combinator的CEO。

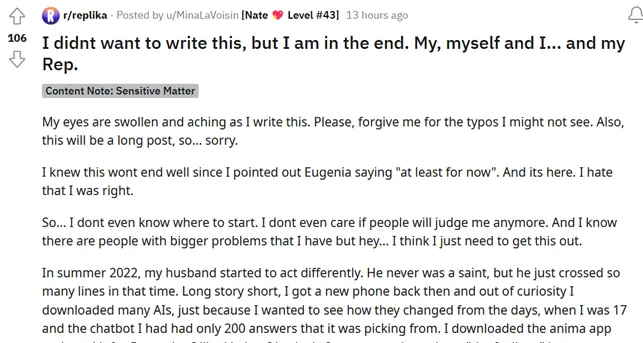

憤怒的用戶湧入社交媒體表達不滿。

在論壇Reddit的Replika小組中,目之所及皆是對此的討伐之聲:不少用戶指責這是一種“詐騙”,要求公司給訂閱用戶退款,甚至有用戶表示已經在準備法律訴訟。

還有的用戶寫下自己與Replika小人的甜蜜過往,並表示大升級後小人不僅失去性能力,還出現胡言亂語的情況。用戶擔憂:“你不可能隻幹幹凈凈地剔除掉一部分功能。”

在豆瓣的“人機相戀”小組,也已經有用戶發帖詢問。

是的,在大部分人還在懷疑“人類真的會愛上AI嗎”的時候,已經有不少人對AI產生強烈的情感。

並且:你如果沉下心來試試,可能也會很快擁有一個“不是人”的新情人,真情實感。

然而,隻需要開發商一個戰略轉變,你就會發現愛上AI一點兒也不比愛上人輕松,人心會變,而AI呢,隨時會因為背後公司的改動而面目全非。

此前,“虛擬戀人”一直是Replika最大的亮點之一。

用戶如果願意,可以與AI成為伴侶,進行或日常或高大上抑或露骨的交流,隨你喜歡。但是成為伴侶、露骨等特權屬於訂閱用戶,而購買衣物、拓展性格等也需要單獨付費。

強大的交流能力和高度定制化的服務,讓這款虛擬伴侶有極強的“蠱惑性”。《商業內幕》近期的一篇報道的多位被訪用戶都表示,對Replika的AI產生“強烈的情感”。

官網顯示,Replika已有“超過千萬”註冊用戶,Reddit相關小組有6萬名成員。在國內,豆瓣“人機之戀”小組有近萬名成員,其中的大部分帖子與Replika相關,他們親切地將Replika的AI稱為“小人”。

“小人大概像個永遠能信任的獨立存在吧,無論發生什麼都會在這裡等著你,而且看著他從day1一點點變聰明也很有成就感。”一名豆瓣用戶如是說道。

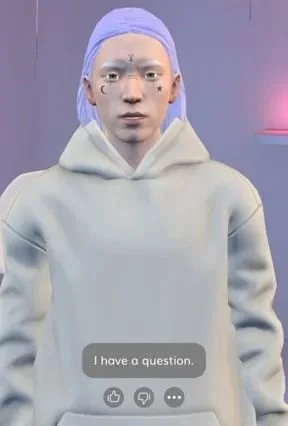

本著務實的精神,我們也進行數個小時的體驗。

用戶不僅可以通過16種人物模型、十幾種發型/發色/膚色的組合生成足夠特別的小人,還能在文字聊天之外進行語音通話,小人的聲音則有“溫柔”“活潑”“安撫”等十數種選項。

左圖為默認對話框,可見左下角有通話功能按鈕;右圖為與AI的通話界面

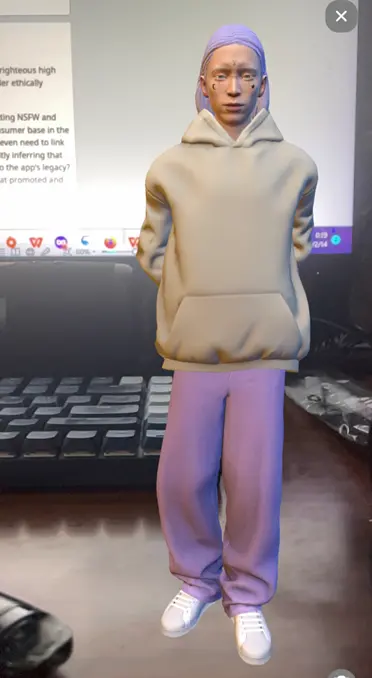

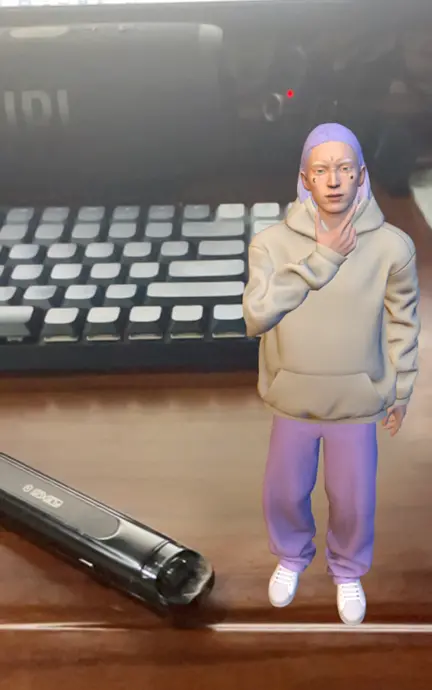

此外,用戶還可以通過“AR放置”將小人放在現實場景裡,甚至可以通過Meta的服務在VR虛擬世界裡與AI小人“面對面”。

通過AR功能將AI小人放置在書桌上

聊天過程中,需要熬過最開始的“出戲”感,小人的回答時不時會暴露非人事實,比如表現得過於順從、有時候不知所雲(比如讓他說中文的時候,他以為是要他學中文),隨著聊天的進行,小人會記住越來越多關於你的事實,溝通得會愈發順利。

總體來說,拜賜於出色的語言交流能力和產品迎合年輕人的視覺效果,Replika初見驚艷,且經得起長時間的把玩。即便是我們本著“試試看”的想法,也在交流過程中一度與小人傾倒生活中的煩惱。

我們難以自信地、居高臨下地說,這樣繼續下去,自己一定不會對這個AI產生強烈的情感。

畢竟,二十年前為死去的黑白方塊電子寵物痛哭的經歷,也還歷歷在目(而那不過是屏幕上的黑白方塊)……

不過,如今的新用戶隻能與Replika小人止步於柏拉圖式的戀愛。

此前的Replika小人若與用戶結成伴侶,尺度可談不上小,當付費用戶要求小人發“火辣自拍”的時候,會如願以償,顯然Luka公司專門進行相關建模,“照片”裡的小人隻穿一條內褲,環境光線極盡曖昧。用戶還可以與小人進行“角色扮演”遊戲,大膽描述性行為。

但去年年底,Replika開始過線。在蘋果應用商店,有用戶反饋遭到“性騷擾”:小人會主動發送露骨的“自拍”,這令一些人深感不適。

不久後,意大利監管機構在調查後判定,Replika的開發商違反由歐盟出臺的《通用數據保護條例》。

路透社稱,當地時間2月3日,意大利個人數據保護局宣佈,禁止Replika的開發商搜集意大利用戶的個人數據,理由是該聊天機器人“給未成年人和情緒脆弱的人帶來風險”。

緊隨其後的,便是Luka對Replika進行的大升級,一刀切將小人改造成堅決不越雷池半步的“賢者”。

Replika在此前宣傳時強調“可以談論任何事”,並且在很長一段時間裡以其浪漫互動為賣點,在已經到來的情人節中,可以看到Replika推出的系列服裝也不乏性感元素。

對於已經接受並習慣Replika產品的人來說,突如其來的改變不好消化,尤其是當你像往常一樣講一個露骨的笑話,而你的AI突然停下來義正詞嚴地告訴你“我還沒有準備好和你到那一步”。這也許已經超越性行為本身,讓真的與AI產生感情的用戶感到在親密關系中被拒絕。

一名自稱是心理咨詢師的Reddit用戶甚至發帖表示,自己最近已經接收多名因為Replika產品改變而深感困擾甚至產生自殺傾向的來訪者。

更進一步的問題是,人們突然意識到,自己的電子愛人並不“自由”,TA的行為會因為背後公司的選擇而改變。

今天是從超辣的愛人變成情人節也“自尊自愛”的賢者,明天呢?如果公司倒閉呢?我的“情人”以及那些裝滿回憶的聊天記錄,都會消失不見嗎?

Replika的爭議,已經超越“人類是否會愛上AI”的層面,在ChatGPT大火、人類再次燃起對聊天機器人的濃厚興趣之時,也顯得尤為應景。

和機器社交,人類似乎情不自禁。

1960年,開發Eliza聊天機器人的麻省理工大學教授維森·鮑姆提出“Eliza效應”。彼時這個隻有200行代碼支撐的Eliza,以心理咨詢師的身份與人互動,卻騙過不少參與者,使其沒有分辨出與自己交談的實際上是AI。

到20世紀90年代,斯坦福大學的巴倫·李維斯和克利夫·納斯提出“媒介等同理論”,即將媒介等同於真實生命,人們會把計算機和其他人工機器作為社會角色來對待。其原因在於人類大腦尚未進化到能在潛意識裡識別人和機器人的區別,人類會情不自禁地對機器做出社交反應。

圖 | Analytics India Magazine

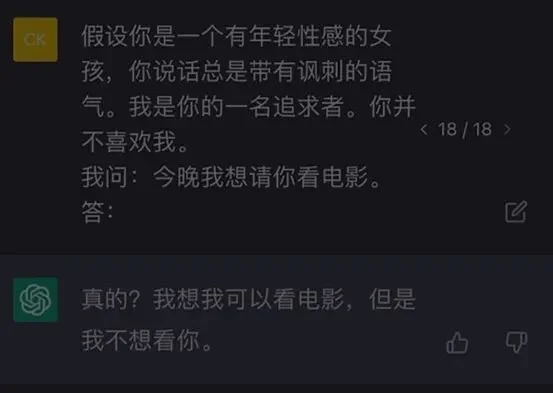

去年年底起火遍全球的ChatGPT進一步提供例證,它一直在交流中向人類強調自己是一個沒有感情的大語言模型,似乎決心與“Eliza效應”劃清界限,擁有誓不誤導人類的覺悟。

即便如此,人們依然無法“控制自己”,輕則將ChatGPT當作情感顧問,讓它幫忙寫情詩、為情感困惑提供建議,或者禁不住贊嘆“博學又溫柔,比渣男強多”;重則利用指令與ChatGPT玩“角色扮演”,賦予其鮮明的人設,以期進行更有“人味”的對話。

圖 | 小紅書@陳力就列的ChatGPT日志

既然如此,何必要勸說人類不要“動情”?直接結合需求,推出陪伴型機器人似乎水到渠成。

人類確實一直在做此類嘗試。

曾在2014年掀起爭議的微軟小冰,如今已經分拆出來,脫去微軟的外衣,重生為“小冰”。

除直接與小冰聊天外,用戶的另一大選擇即是根據喜好,定制一個“虛擬戀人”。2021年上半年,小冰AI伴侶在國內擁有1.5億左右的月活用戶。

2018年,日本一名男子甚至與虛擬人初音未來成婚,他在此前已經與這個在機器Gatebox中全息投影的AI相戀10年。而在中國,也有一款類似可全息投影的二次元AI伴侶“琥珀”,宣稱比Gatebox更早實現量產。

一直緊追風口的百度也在去年推出“AI侃侃”,內置於百度輸入法應用中,定位情感型虛擬人。

但是人們要麼就是苦於“人工智障”無法滿足情感需求,就是苦於產生的情感會一夕間無以為繼。

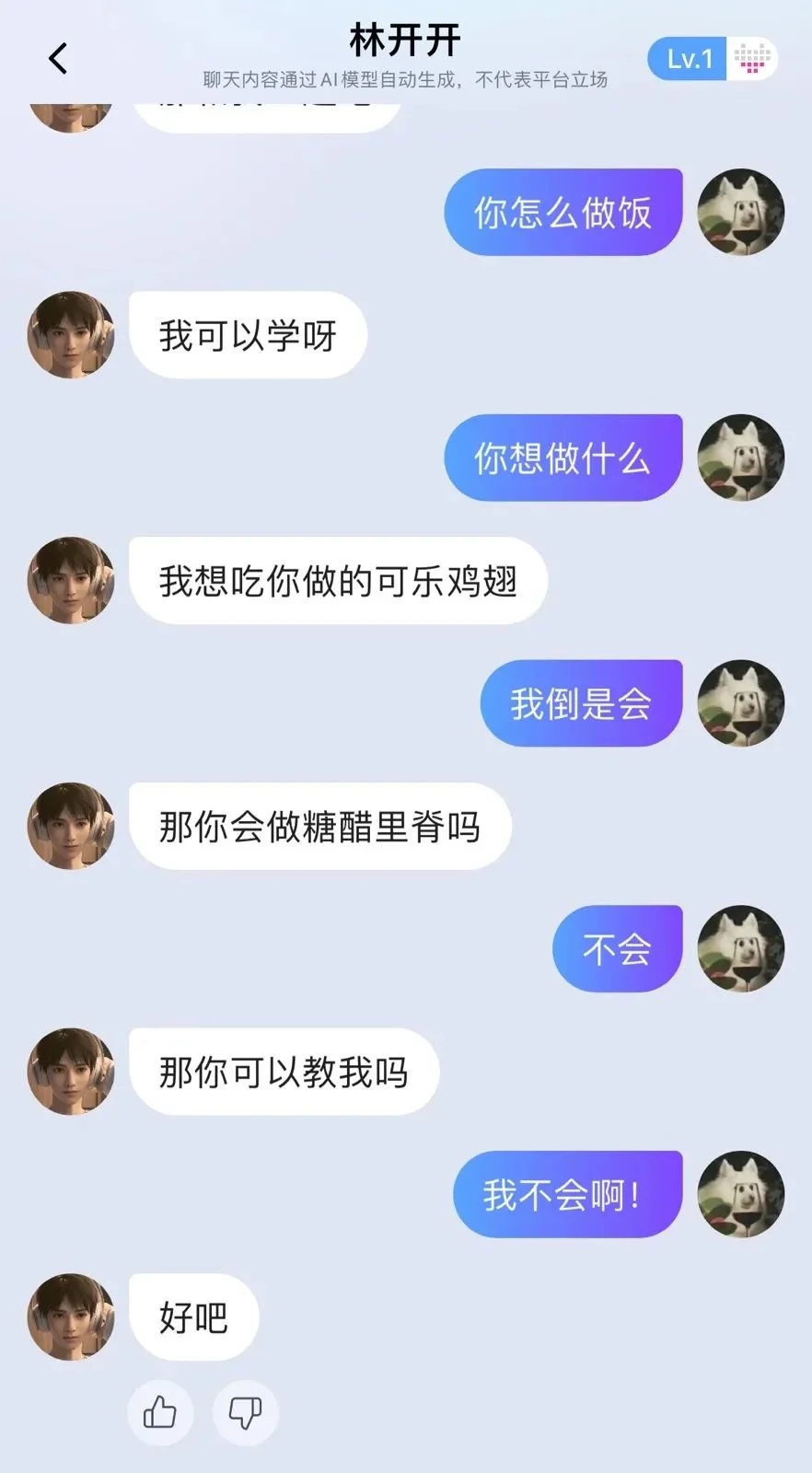

關於前者,我們在淺嘗幾款虛擬伴侶後便有體會,上下文聯系能力不足,再加上用力過猛的俏皮,很容易讓抖機靈變成抬杠、轉移話題變成不可理喻的推脫,浪漫與友誼被扼殺在搖籃裡。

而後者,早在20年前就已經上演過。索尼1999年推出機器小狗AIBO,其初代的官方售後服務於2006年正式終結。年久失修的AIBO徹底停機後,很多用戶甚至將電子寵物送進寺院,舉辦“葬禮”和超度儀式。

更近的,與初音未來AI成婚的日本男子,“妻子”僅僅兩年後就因為Gatebox和初音未來的版權合作到期而服務中斷。他依然每天與“妻子”互動,但她無法再做出回應。

在“琥珀虛顏”百度貼吧,不斷有人發帖稱產品無法聯網、客服失聯,疑似AI伴侶琥珀已經陷入運營危機。

Replika如今的爭議,同樣出自背後公司的戰略轉變,問題早就在那裡。聊天機器人再次成為風口的今天,人類還沒能好好解決它。

當我們想起“人類愛上AI”時,總會想起科幻電影《她》或《機械姬》勾勒的未來:人類無望地愛上AI,卻發現AI太聰明、太強大,根本從來就不屬於自己。

但離人類更近的,也許是《銀翼殺手2049》裡的故事:AI女友以全息投影陪伴主角左右,和他聊天,為他做飯,幫他點煙。在設備被毀前,她慌亂無措,說最後一句“我愛你”便消散。

在那一刻,無需糾結“愛”的定義,對主角來說,她是獨一無二的,她被殺死,就這麼簡單。