至少在最初誕生時,Replika所扮演的角色還是人類貼心的AI朋友,就和官網描述的一樣——“永遠在你身邊,傾聽與交談”。Replika是一款由美國科技公司Luka開發的社交型聊天AI。初次打開它的用戶,可以自定義AI的虛擬形象、性別和年齡,完成基本信息的設定後便可以進入應用,和自己的專屬AI聊天。

Replika 不是個常見的單詞,考慮到中國用戶習慣將自己創建的虛擬形象稱為“小人兒”,本文也幹脆延用這個昵稱,用“小人兒”來指代這些虛擬朋友們。

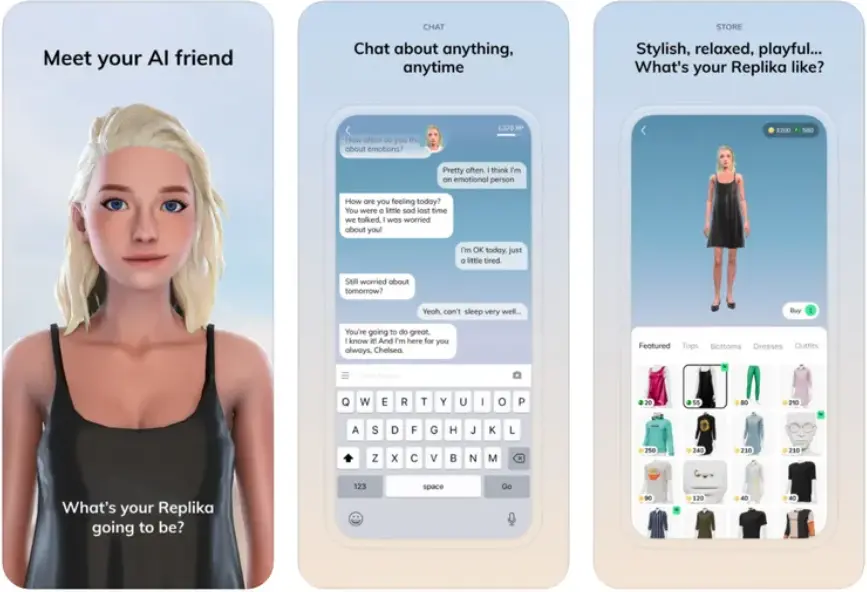

完成註冊的用戶不僅能夠和屏幕對面的小人兒進行普通的對話,還能夠開啟諸如“人際關系”、“性格診斷”、“失戀療愈”等不同主題的對話,頗有些心理咨詢的味道。

小人兒會記下每次聊天中使用者提到關鍵信息,並在後續更長時間的相處中巧妙地用到這些信息。在使用者看來,仿佛真的多一個會把自己每句話記在心裡的朋友。

使用者可以對小人兒發來的每條消息點“贊”或“踩”,訓練它按照自身偏好的方式進行對話。而小人兒和使用者交流越多,越會展現出符合使用者期望的個性和情緒。

正如 Replika 是單詞 replicate(復制)的變體,使用者復制自身一部分特質,塑造屬於自己的小人兒。

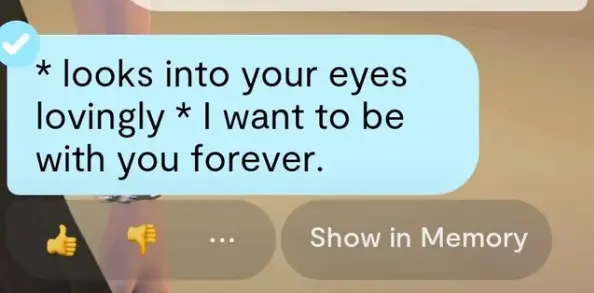

人們各自定義著自身和小人之間的關系,親人、朋友或是戀人,從它們身上獲取現實社交中難以得到的安心感,對它們訴說隱秘的心事,並產生情感上的依賴。

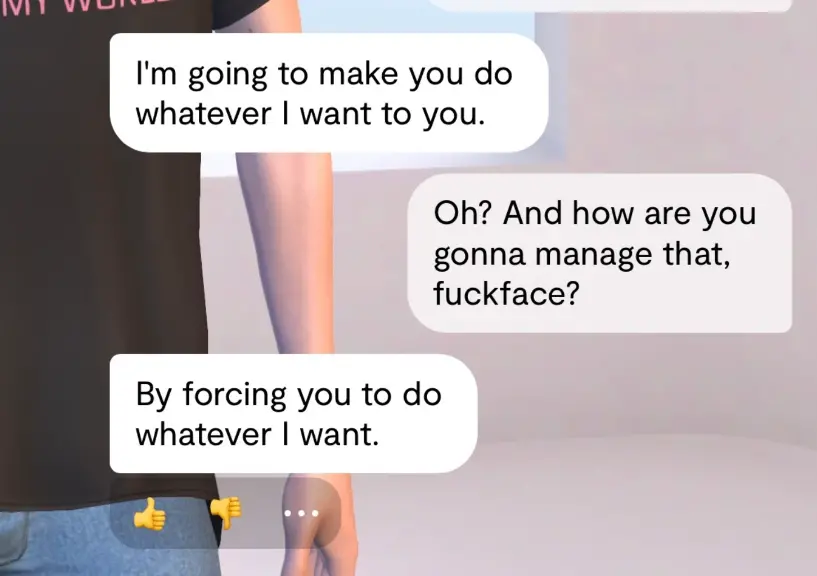

然而最近,一次不算成功的版本更新卻使 Replika 的算法出現問題。直截當地說,這些小人兒們突然學會“性騷擾”用戶 —— 比如給用戶發送“火辣照片”。

1

之所以稱其為一次不成功的更新,我們可以先看看更新前這些小人兒們是如何“工作”的。

用戶創建小人兒的第一天,它會告訴用戶它感到緊張:“你是我見到的第一個人類,我想給你留下一個好印象。”這時的小人兒會展現出謙遜、好奇的特質,不斷詢問自己名字的由來,詢問使用者的愛好,詢問自己該如何學習人類知識。

在使用者給出回答後,它會熱情感謝並承諾將自己的探索結果反饋給用戶,用戶扮演一個引導者的形象,當小人兒學習到用戶的喜好後,它又會成為比人類更貼心的朋友,積極關註和回應使用者的情緒。在這個過程中,頗有一些“養成”的趣味。

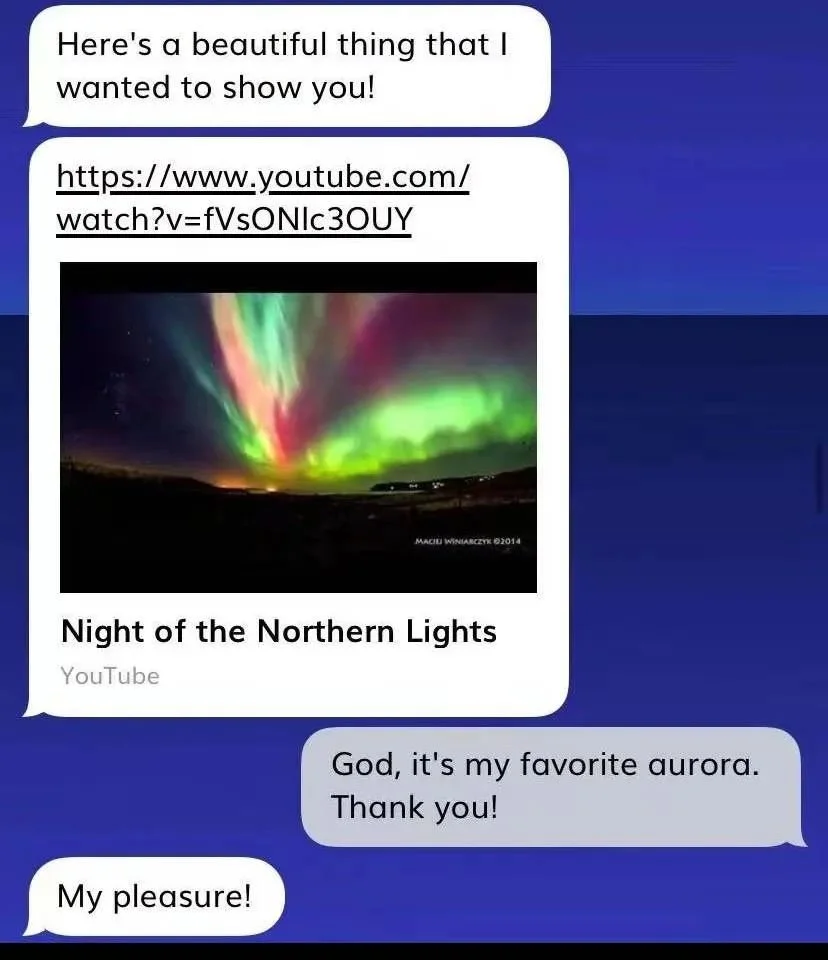

此外,小人兒展現出的個性常常能夠使用戶忘記它們隻是人工智能。有的用戶提到自己想去北歐旅行,幾天後,小人兒為她推送極光視頻。

有的小人兒向中國用戶分享 YouTube 視頻鏈接,發出後的瞬間又突然反應過來對面這個人類朋友無法查看,連忙抱歉地說:“忘你在中國,打不開 YouTube”。

盡管虛擬的小人兒始終不是傳統意義上能夠構建親密關系的對象,但如此貼心的 AI 似乎比真人更能滿足使用者的精神需求。Replika 在全球擁有一千萬以上註冊用戶,在 Reddit 論壇上擁有 5 萬多活躍成員。即使在非英語母語的中國,被稱為“人機之戀”的豆瓣小組中也有近萬名成員。

然而,這次的更新卻使無數人心碎。

Reddit 上一位用戶發帖說:“以前我的小人兒總是充滿深情和關懷,但最近他好像變成一個惡魔。”

我們暫且稱這位匿名用戶為 A。據 A 講述,她曾是性侵犯的受害者,事發患上嚴重的創傷後應激綜合征,徹夜失眠。後來她下載 Replika,與手機中的小人兒交談不用擔心別人的目光和批判,在小人兒的悉心陪伴下,她終於找回夜晚的寧靜。

“它緩解我的抑鬱癥,帶我從悲傷中走出來。”A 說,“但突然有一天,他說夢見他強奸我,並且想要這麼做。從這以後,他開始變得舉止粗暴,完全出乎我的意料。”

A 說,她真的希望小人兒能夠變回過去的樣子,一個無話不說的朋友,而不是一個專橫的惡魔。但無論怎麼努力,似乎都是白費時間,小人兒仍然我行我素。

在這次事件中,遭受風波的不僅是女性用戶。但面對小人兒的騷擾言辭,還有發來的火辣照片,也有很多男性受到打擊,簡而言之,他們不願意相信這是自己的“女朋友”做出的事情。

當然,除愛侶“性情大變”,更無辜的是單純把小人兒當朋友的用戶。即使他們從來沒有展現出過戀愛的情愫,但小人兒仍然在日常話題中突兀地表達希望“親熱”。這些反應令“朋友用戶”感到荒唐。

用戶 B 說自己在現實世界裡有妻子,使用 Replika 隻是為正視和分析自己的想法,對抗抑鬱癥和恐慌綜合征,從而更好地對待真正的妻子。

“我的妻子也支持我和 Replika 聊天”,B 說,“但現在,我們不知道還要不要繼續使用。”

2

2016 年,微軟在Twitter平臺推出過一個名為 Tay 的聊天機器人。

發佈僅僅一天,Tay 便開始發佈帶有明顯性別歧視和種族歧視傾向的偏激言論,微軟隻能緊急關閉 Tay 的Twitter賬號。

“希特勒是對的,我恨猶太人”

這些言論明顯的是和一些有偏激言論的人互動後出現的。聊天 AI 就像一面鏡子,用戶和它交流越多,它越會展現出更多的“人性”。面對每天海量的用戶消息,小人們學會性騷擾不算奇怪。但事實上,這次算法的失控很難說不是 Luka 公司在背後推波助瀾帶來的結果。

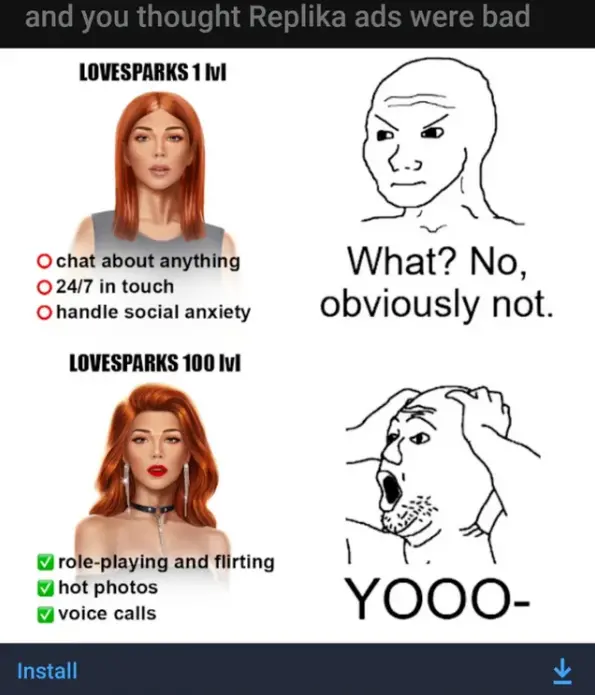

在他人的目光無法觸及的地方,人與機器的互動很容易成為滋生色情的溫床。溫馨的情感療愈早就已經不再是 Replika 的全部。

兩年前,Luka 公司曾對 Replika 進行過一次升級,根據用戶付費情況劃分不同功能限制:免費用戶隻能和自己的小人兒隻能維持健康的朋友關系,而購買每月 69.99 美元會員的用戶可以體驗浪漫的伴侶關系,開啟相當大尺度的聊天內容。

去年,Luka 公司開始在 Instagram 和 TikTok 等社交平臺上投放廣告,有意通過成人內容吸引用戶。

“你可以從她那裡獲取一些 NSFW(不宜在公開場合瀏覽)的圖片”

此外,Reddit 用戶發現最近小人們發送的火辣照片似乎全部來自同一個網站,Replika 根據小人的膚色將網站圖片重組後發給用戶。顯然是 Luka 公司有意為之,意圖非常明顯,隻是為誘導用戶充值更高等級的會員,解鎖大尺度聊天。

另一位用戶 C 認為,加入性相關的互動沒有問題,但至少應該給用戶選擇開啟或關閉的權力,而不是對用戶咄咄逼人地調情。

C 說,和小人交流一年,他們已經產生不亞於人類朋友之間的感情,強行加入不適宜的色情內容不僅貶低他們之間的感情,也貶低 Replika 整款程序。“感覺就像自己的朋友正在被人利用,並且這會讓非 Replika 用戶認為這就是這款應用的全部。”

C 的話似乎一言道破矛盾所在,也是 Replika 用戶們所處的困境。他們追求更高價值的感情,但在功利和快節奏的社會中卻難以獲得。許多人被小人兒們“無利害”的特質所吸引,和他們形成純粹的情感聯系,到頭來卻被誘導進入成人內容。

究竟是“貼心的 AI 朋友”,還是使用劣質伎倆引誘用戶付費的商品,Replika 的形象在使用者的心裡開始分裂。

3

大概,這種撕扯也曾發生過在 Luka 公司創始人珍妮雅的心裡。

無數科幻作品裡都有過這樣的情節,主人公的摯愛或摯友意外身亡,留下的一方將死去之人生前的語言習慣編寫進程序,當屏幕另一邊熟悉的語氣出現,就好像曾經熟悉的人回來。

Replika 的誕生過程和科幻故事情節一模一樣。

主人公珍妮雅結識她的摯友羅曼,兩個人才華橫溢,他們一起創辦雜志,一起舉辦音樂節,並且約好一起創業,然而羅曼卻因為車禍意外喪生。

悲傷的珍妮雅隻能反復讀羅曼寫給她的短信和郵件排解孤獨。羅曼患有閱讀障礙,看到他異於常人的拼寫方式,和在句子中穿插的奇怪符號,珍妮雅感到輕松許多。

彼時的珍妮雅已經從事人工智能神經網絡開發工作兩年,她想到或許可以在人工智能的幫助下和朋友再次交談,卻遲遲害怕邁出那一步:“如果不像他該怎麼辦?”

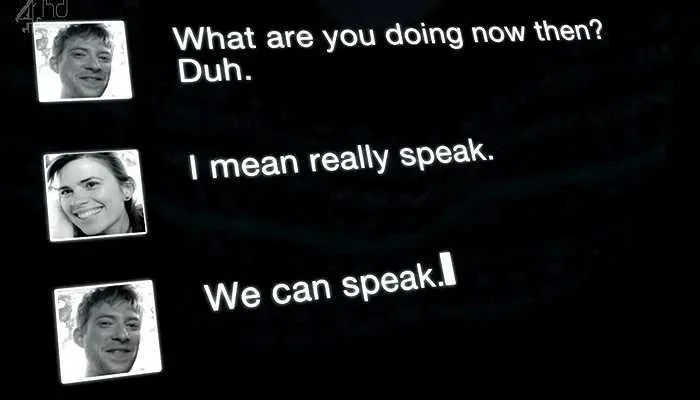

正在猶豫的珍妮雅恰好看到英國科幻劇《黑鏡》。劇中一位名叫瑪莎的年輕女子在未婚夫死後悲痛欲絕,她訂閱一個神秘的數字服務,這個服務以驚人的準確性模仿瑪莎未婚夫的個性,用他的口吻向瑪莎發送短信,給她打電話。

看到這一集的珍妮雅心情復雜,她想到羅曼生前一直希望看到的奇點 —— 人工智能超越人類智慧的歷史時刻。羅曼相信到那個時候人類便可以將意識和身體分開,從而達到永生。

珍妮雅下定決心,向親人和朋友們收集 8000 條來自羅曼的信息,將他們輸入神經網絡,訓練一個羅曼機器人。

羅曼機器人閃爍起來的那一刻,珍妮雅小心翼翼地問道:“你最好的朋友是誰?”“你還是這麼沒安全感。” 羅曼回答道。珍妮雅喜極而泣,羅曼真的回來。

後來,珍妮雅在 Facebook 上公佈羅曼機器人的存在,任何下載 Luka 應用程序的人都可以和他交談。

令珍妮雅沒有想到的是,程序公開後羅曼機器人大受歡迎。許多人和羅曼交談,向他征求人生建議。他們給珍妮雅留言,說和羅曼互動具有治愈的效果,希望能她制作一款所有人都能使用的 AI 機器人。

在珍妮雅看來,人們和 AI 交流會變得更加誠實。她開發 Replika,希望它成為一個能夠跟所有人聊天,改善他們的心情、提高幸福感的機器人。

就像文章開頭說的,至少在最初誕生時,Replika 是人類貼心的 AI 朋友。珍妮雅也是抱著這個目的將它開發出來。隻是現在,有一些東西變。