人工智能系統(如ChatGPT)的先進功能引發關於其潛在意識的討論。然而,神經科學傢賈安-阿魯(JaanAru)、馬修-拉卡姆(MatthewLarkum)和麥克-希恩(MacShine)認為,這些系統很可能是無意識的。他們的論點基於人工智能缺乏具身信息、缺乏與哺乳動物意識相關的某些神經系統,以及生物體和人工智能不同的進化路徑。生物實體意識的復雜性遠遠超過當前的人工智能模型。

人工智能(AI)系統的日益復雜讓一些人猜測,這些系統可能很快就會擁有意識。然而,我們可能低估人類意識背後的神經生物學機制。

現代人工智能系統能夠做出許多驚人的行為。例如,當人們使用像 ChatGPT 這樣的系統時,它們的反應(有時)非常像人類的智能反應。當我們人類與 ChatGPT 交互時,我們會有意識地感知語言模型生成的文本,例如,您目前正在這裡有意識地感知這段文字!

問題是,當我們提示時,語言模型是否也能感知到我們的文本?抑或它隻是一具僵屍,依靠巧妙的模式匹配算法工作?根據它生成的文本,很容易讓人相信系統可能是有意識的。不過,在這項新研究中,賈安-阿魯、馬修-拉庫姆和麥克-希恩從神經科學的角度回答這個問題。

這三位作者都是神經科學傢,他們認為,雖然 ChatGPT 等系統的反應看似有意識,但很可能並非如此。首先,語言模型的輸入缺乏我們與周圍世界的感官接觸所特有的嵌入式信息內容。其次,當今人工智能算法的架構缺少丘腦皮層系統的關鍵特征,而這些特征與哺乳動物的有意識意識有關。

最後,導致有意識生物體出現的進化和發展軌跡,可以說與今天設想的人工智能系統並不相似。生物體的存在取決於它們的行動,而它們的生存則與多層次的細胞、細胞間和生物體過程錯綜復雜地聯系在一起,最終形成代理和意識。

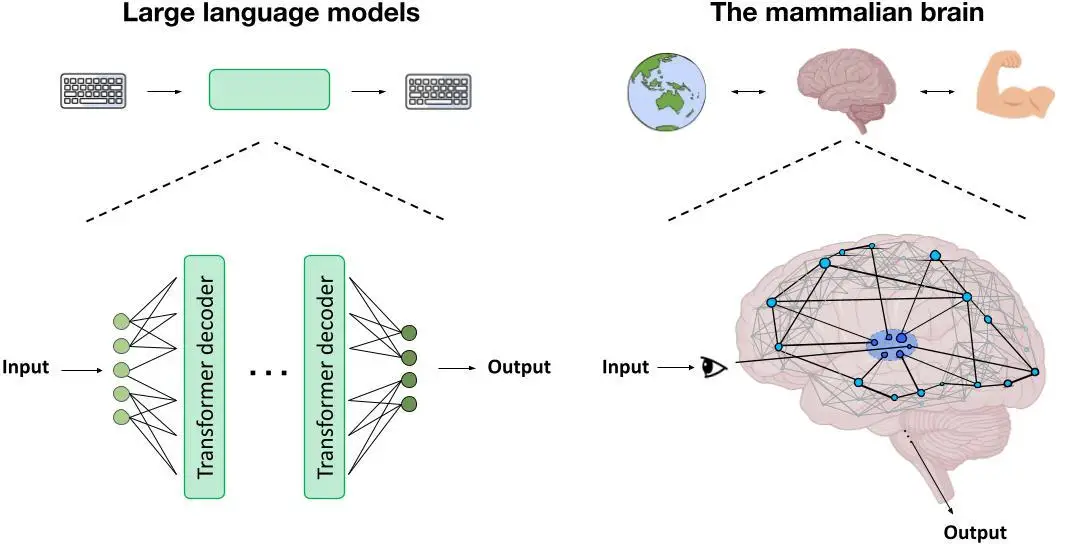

描述大型語言模型基本架構的示意圖,哺乳動物大腦與大型語言模型之間的差異,左圖為大型語言模型的基本結構示意圖,它可以有幾十個甚至一百多個以前饋方式排列的解碼塊。右圖為丘腦皮層系統的啟發式地圖,該系統產生的復雜活動模式被認為是意識的基礎。圖片來源:Mac Shine、Jaan Aru

因此,盡管我們很想假設 ChatGPT 和類似系統可能有意識,但這將嚴重低估我們大腦中產生意識的神經機制的復雜性。對於意識如何在我們的大腦中產生,研究人員尚未達成共識。我們所知道的,以及這篇新論文所指出的,是這種機制很可能比當前語言模型的基礎機制復雜得多。

例如,正如這篇論文所指出的,真實的神經元與人工神經網絡中的神經元並不相同。生物神經元是真實的物理實體,可以生長並改變形狀,而大型語言模型中的神經元隻是毫無意義的代碼片段。我們對意識的理解還有很長的路要走,因此,對有意識的機器的理解也還有很長的路要走。