不做大模型,就沒有算力用。這是ChatGPT點燃AI風口後,國內某top3高校AI實驗室的殘酷現狀。同一個實驗室裡,非大模型團隊6人用4塊3090卡,比起同實驗室的大模型團隊10個人用10塊A800卡,本就已經不算富裕。

現在,校企合作也更偏愛大模型。去年11月ChatGPT發佈後,與非大模型團隊合作的企業驟減,近期找上門的,也是張口就問:

“你們做大模型不?”

做,有高校和企業的通力支持;不做?那就隻能眼睜睜看著算力花落別傢。

哪怕某量化私募基金的有10000張A100卡,還對高校研究團隊開放申請,也不見得能落一張到你頭上。

“要是我們組能分到一些就好。”看到這條微博,非大模型團隊帶隊的數據科學方向博士小哥羨慕不已,因為缺算力,他都愁得快仰天長嘯:我們也值得投資啊!!!

現在,大夥爭先恐後撲向ChatGPT背後GPT-3.5般的各種大模型,算力流向亦然。

其他AI領域本就不足的算力更荒,尤其是國內學界手裡的算力分配下來,貧富差距肉眼可見。

一整個實驗室就4塊3090卡

巨大規模算力以月為單位的租用成本,對研究團隊來說不是小數目。大模型正當其道,學界研究大模型的實驗室或團隊擁有算力資源的優先分配權。

就拿小哥在學校的親身體驗來說,在他們研究室,大模型小組10個人有10塊A800卡可用,而另一個研究傳統機器學習方向的實驗室,整個實驗室隻有4塊3090卡。

擁抱主流趨勢是一重原因,另一重原因是實驗室需要運轉和維護的經費,獲得撥款的一種形式是申請國傢項目,但必要步驟是提供論文成果。

雙重原因下,本就不多的算力資源,不得不優先分配給大模型這樣熱門且相對容易出成果的研究。哪怕對學界來說,訓一個大模型其實練不太動——因為數據、算力和資金都有些捉襟見肘。

為獲得更多的資源,有的非大模型實驗室甚至額外專門成立研究大模型的團隊。

當然,想要獲得資金和資源,校企合作也是不可或缺的一種方式。

這種推動產研融合的重要支撐形式持續已久,2020年,KDD中校企合作論文占比超過50%,這個比例在ICCV中達到45%。

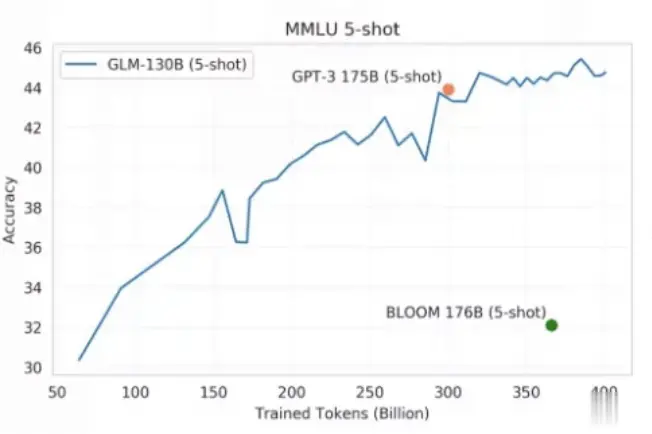

舉例來說,2021年,清華大學KEG、PACMAN(並行與分佈式計算機系統)、NLP等實驗室著手推進訓練千億參數的稠密模型,但團隊用於訓練模型的計算資源並不充足。最終,校外企業智譜AI租用近百臺A100的服務器,免費提供所需算力,這才有雙語預訓練語言大模型GLM-130B的誕生。

GLM-130B的任務表現

但在眾人爭先恐後撲向GPT-3.5般大模型的當下,非大模型團隊開始不太好談這類合作。

去年11月ChatGPT發佈後,與小哥所在團隊洽談校企合作事宜的公司數量急劇減少。在其他高校,AI領域的非大模型團隊也總是面臨企業詢問,“要不要/會不會做大模型”。

本就稀缺的算力,在學界有成為追逐熱點的砝碼的傾向,算力資源分配的馬太效應由此逐漸擴大,帶給學術研究很大困擾。

ChatGPT加劇算力分配貧富分化

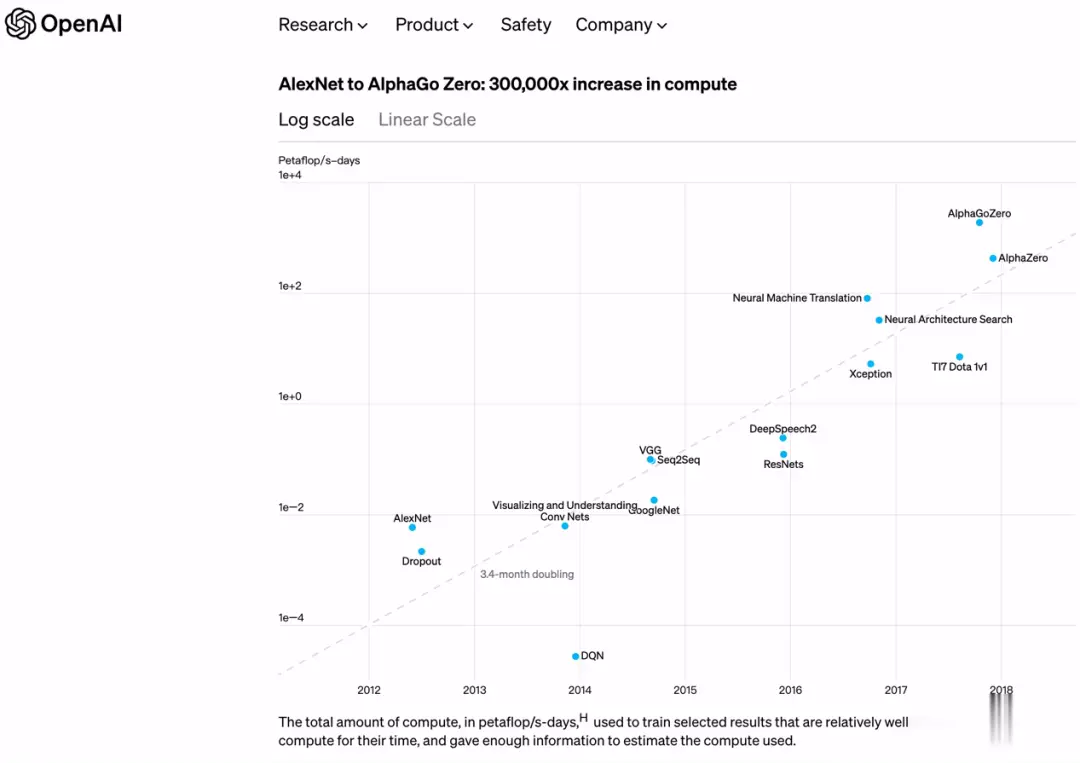

算力是AI飛速發展必不可少的指標,2018年,OpenAI發佈的報告中點出一個算力趨勢:

自2012年以來,AI訓練任務所運用的算力每3.43個月就會翻倍。到2018年,AI算力需求增長30萬倍。

產學研對算力需求暴增,我們能提供的算力有多少?

據中國算力集團統計,截至2022年6月底,我國數據中心機架使用總規模超過590萬標準機架,服務器規模約2000萬臺,算力總規模排名全球第2。

這個排名還算不錯,但攤開來看仍舊遠遠不夠,畢竟放眼全球,沒有哪個國傢不是嗷嗷待哺,等著更多的算力資源“投喂”。

再退一步講,買得起顯卡,擁有的算力上去,電費也是天文數字。

況且我國還有特殊情況——

開放原子開源基金會業務發展部部長朱其罡在本月舉辦的CCF YOCSEF上發言闡述現狀稱,超算領域的核心技術,一個是IBM LSF超算系統,一個是開源系統。目前,國內多數超算中心都基於開源系統做封裝,但這個版本調度資源的效率和能力都有很大的提升空間。

以及,因為眾所周知的原因,A100、H100這倆目前性能最強的GPU,還沒找到可規模替代的方案。

英偉達A100顯卡

綜上,算力不夠已是積弊,但ChatGPT時代,算力需求劇烈擴張,除大量訓練算力,大量推理算力也需要支撐。

所以現在的情況是,因為ChatGPT顯示出大模型的推理能力,訓練和研究大模型的算力需求增加;同時因為大模型熱度爆棚,蜂擁至大模型的算力資源也增加。

分配給大模型領域的算力資源豐富起來,其他AI領域缺衣少食的情況逐漸加劇,研發能力受到掣肘。

可以說,ChatGPT成為如今的AI屆白月光後,加劇算力分配的貧富分化。

這般“富”甲一方的大模型,是不是AI研究路徑上最好的?還沒人能夠回答。

但值得引起註意和重視的是,GPT系列為首的大模型不應該吸引全部目光,整個AI領域還有各種各樣的研究方向,還有更加細分的垂直領域,以及帶來更多生產力的模型和產品。

當ChatGPT的熱度趨於平緩,學界的算力資源分配差距會縮小嗎?

所有非大模型方向的實驗室和團隊,恐怕都在期待之中。