由ChatGPT掀起的這場AI革命,令人們感慨神奇的同時,也不禁發出疑問:AI究竟是怎麼做到這一切的?此前,即便是專業的數據科學傢,都難以解釋大模型(LLM)運作的背後。而最近,OpenAI似乎做到——本周二,OpenAI發佈其最新研究:讓GPT-4去試著解釋GPT-2的行為。

即:讓一個 AI “黑盒”去解釋另一個 AI “黑盒”。

工作量太大,決定讓 GPT-4 去解釋 GPT-2

OpenAI 之所以做這項研究的原因,在於近來人們對 AI 倫理與治理的擔憂:“語言模型的能力越來越強,部署也越來越廣泛,但我們對其內部工作方式的理解仍然非常有限。”

由於 AI 的“黑盒”性質,人們很難分辨大模型的輸出結果是否采用帶有偏見性質的方法,也難以區分其正確性,因而“可解釋性”是亟待重要的一個問題。

AI 的發展很大程度上是在模仿人類,因而大模型和人腦一樣,也由神經元組成,它會觀察文本規律進而影響到輸出結果。所以想要研究 AI 的“可解釋性”,理論上要先解大模型的各個神經元在做什麼。

按理來說,這本應由人類手動檢查,來弄清神經元所代表的數據特征——參數量少還算可行,可對於如今動輒百億、千億級參數的神經網絡,這個工作量顯然過於“離譜”。

於是,OpenAI 靈機一動:或許,可以用“魔法”打敗“魔法”?

“我們用 GPT-4 為大型語言模型中的神經元行為自動編寫解釋,並為這些解釋打分。”而 GPT-4 首次解釋的對象是 GPT-2,一個 OpenAI 發佈於 4 年前、神經元數量超過 30 萬個的開源大模型。

讓 GPT-4 “解釋” GPT-2 的原理

具體來說,讓 GPT-4 “解釋” GPT-2 的過程,整體分為三個步驟。

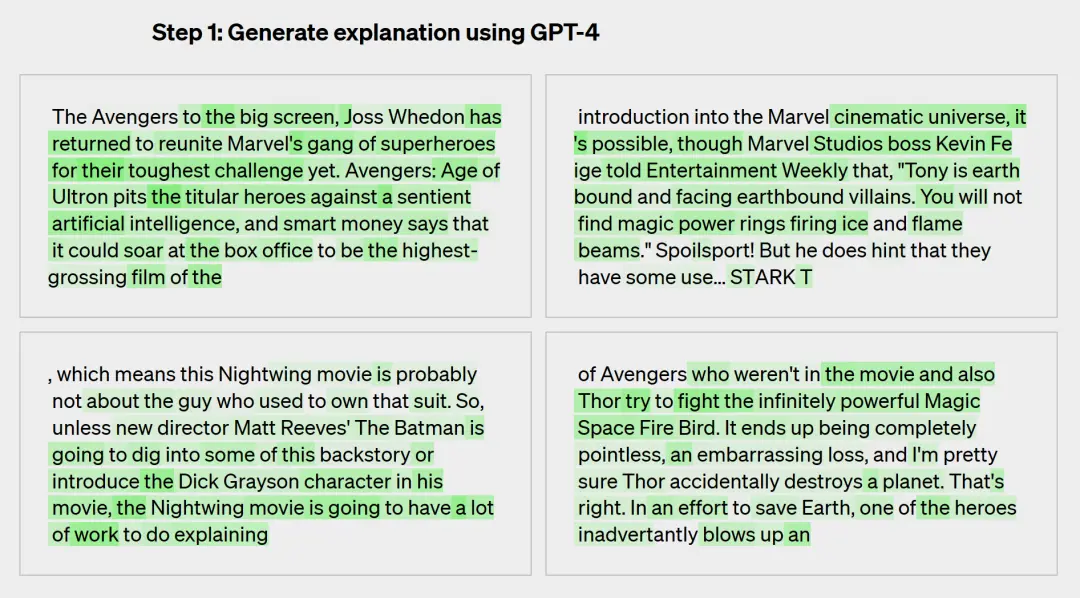

(1)首先,讓 GPT-4 生成解釋,即給出一個 GPT-2 神經元,向 GPT-4 展示相關的文本序列和激活情況,產生一個對其行為的解釋。

如上圖所示,GPT-4 對 GPT-2 該神經元生成的解釋為:與電影、人物和娛樂有關。

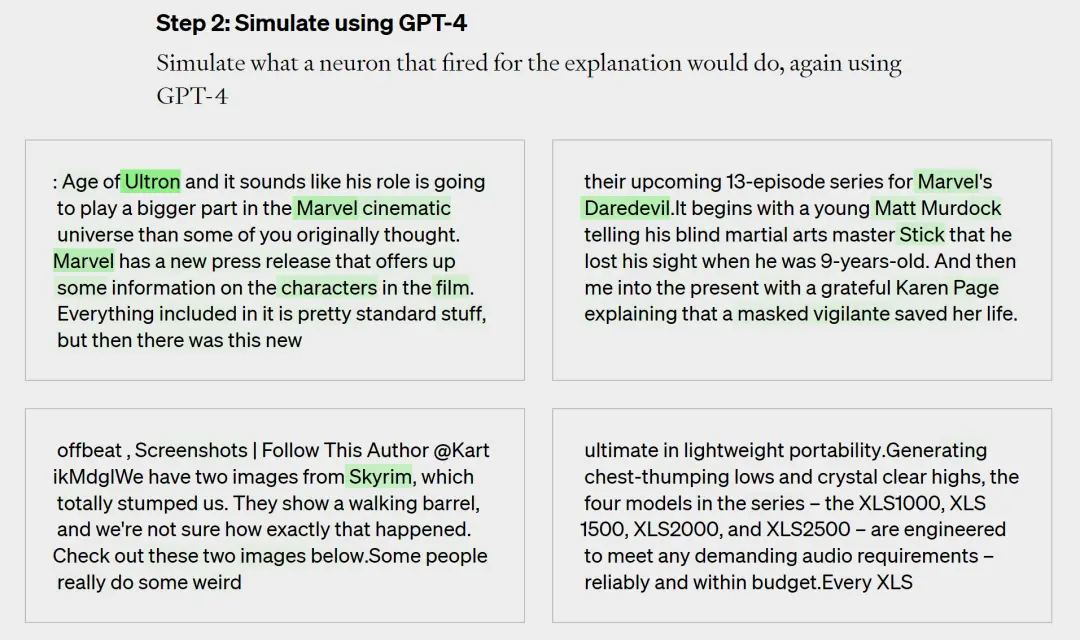

(2)其次,再次使用 GPT-4,模擬被解釋的神經元會做什麼。下圖即 GPT-4 生成的模擬內容。

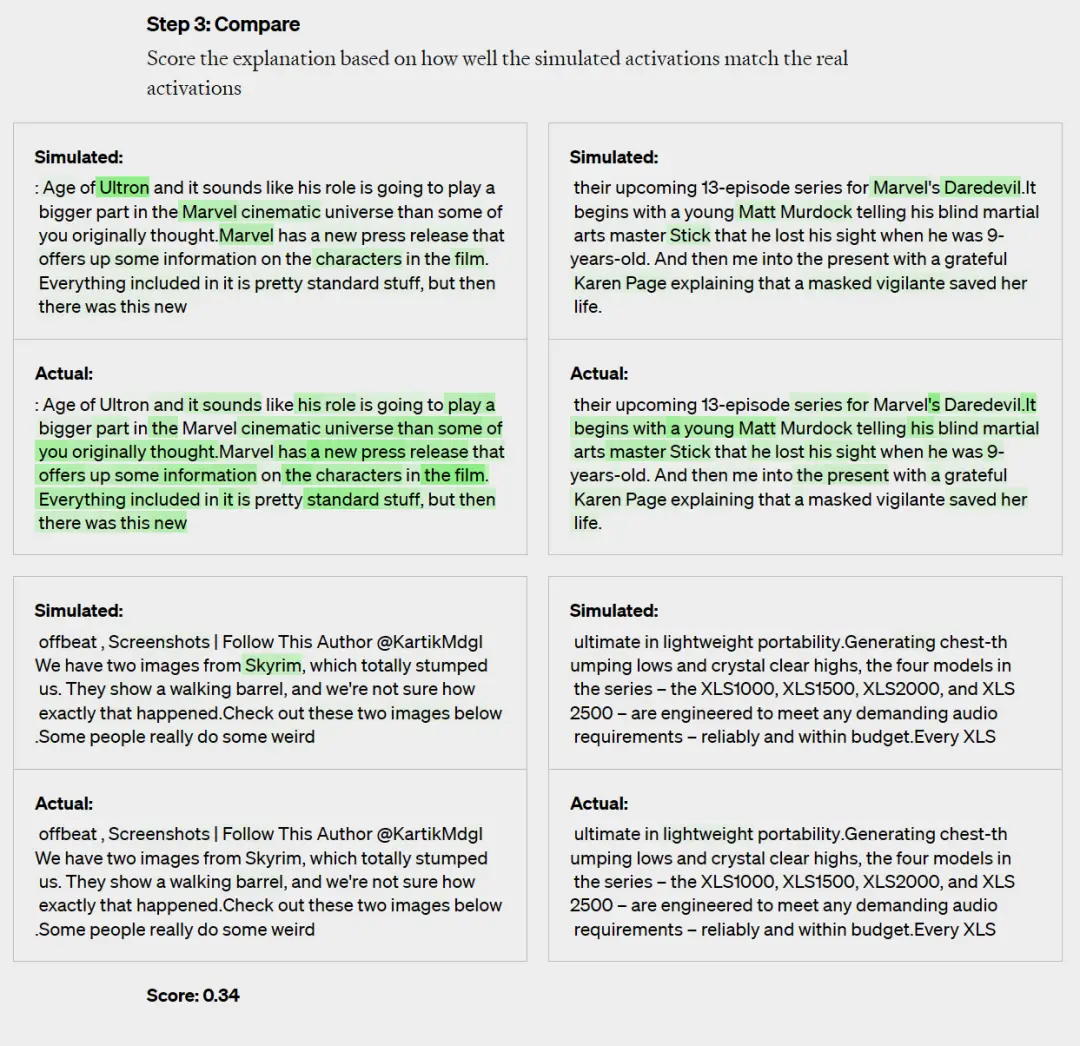

(3)最後,比較 GPT-4 模擬神經元的結果與 GPT-2 真實神經元的結果,根據匹配程度對 GPT-4 的解釋進行評分。在下圖展示的示例中,GPT-4 得分為 0.34。

通過這樣的方法,OpenAI 共讓 GPT-4 解釋 GPT-2 中的 307200 個神經元,其中大多數解釋的得分很低,隻有超過 1000 個神經元的解釋得分高於 0.8。

在官博中,OpenAI 承認目前 GPT-4 生成的解釋並不完美,尤其在解釋比 GPT-2 規模更大的模型時,效果更是不佳:“可能是因為後面的 layer 更難解釋。”

盡管絕大多數解釋的得分不高,但 OpenAI 認為,“即使 GPT-4 給出的解釋比人類差,但也還有改進的餘地”,未來通過 ML 技術可提高 GPT-4 的解釋能力,並提出三種提高解釋得分的方法:

對解釋進行迭代,通過讓 GPT-4 想出可能的反例,根據其激活情況修改解釋來提高分數。

使用更大的模型來進行解釋,平均得分也會上升。

調整被解釋模型的結構,用不同的激活函數訓練模型。

值得一提的是,以上這些解釋數據集、可視化工具以及代碼,OpenAI 都已在 GitHub 上開源發佈:“我們希望研究界能開發出新技術以生成更高分的解釋,以及更好的工具來使用解釋探索 GPT-2。”

(GitHub 地址:https://github.com/openai/automated-interpretability)

“再搞下去,AI 真的要覺醒”

除此之外,OpenAI 還提到目前他們采取的方法有很多局限性,未來需要一一攻克:

GPT-4 給出的解釋總是很簡短,但神經元可能有著非常復雜的行為,不能簡潔描述。

當前的方法隻解釋神經元的行為,並沒有涉及下遊影響,希望最終能自動化找到並解釋能實現復雜行為的整個神經回路。

隻解釋神經元的行為,並沒有解釋產生這種行為的背後機制。

整個過程都是相當密集的計算,算力消耗很大。

在博文的最後,OpenAI 展望道:“我們希望將我們最大的模型解釋為一種在部署前後檢測對齊和安全問題的方式。然而,在這些技術能夠揭露不誠實等行為之前,我們還有很長的路要走。”

對於 OpenAI 的這個研究成果,今日在國內外各大技術平臺也引起廣泛關註。

有人在意其得分不佳:“對 GPT-2 的解釋都不行,就更不知道 GPT-3 和 GPT-4 內部發生什麼,但這才是許多人更關註的答案。”有人感慨 AI 進化的方式愈發先進:“未來就是用 AI 完善 AI 模型,會加速進化。”也有人擔心 AI 進化的未來:“再搞下去,AI 真的要覺醒。”

那麼對此,你又有什麼看法呢?