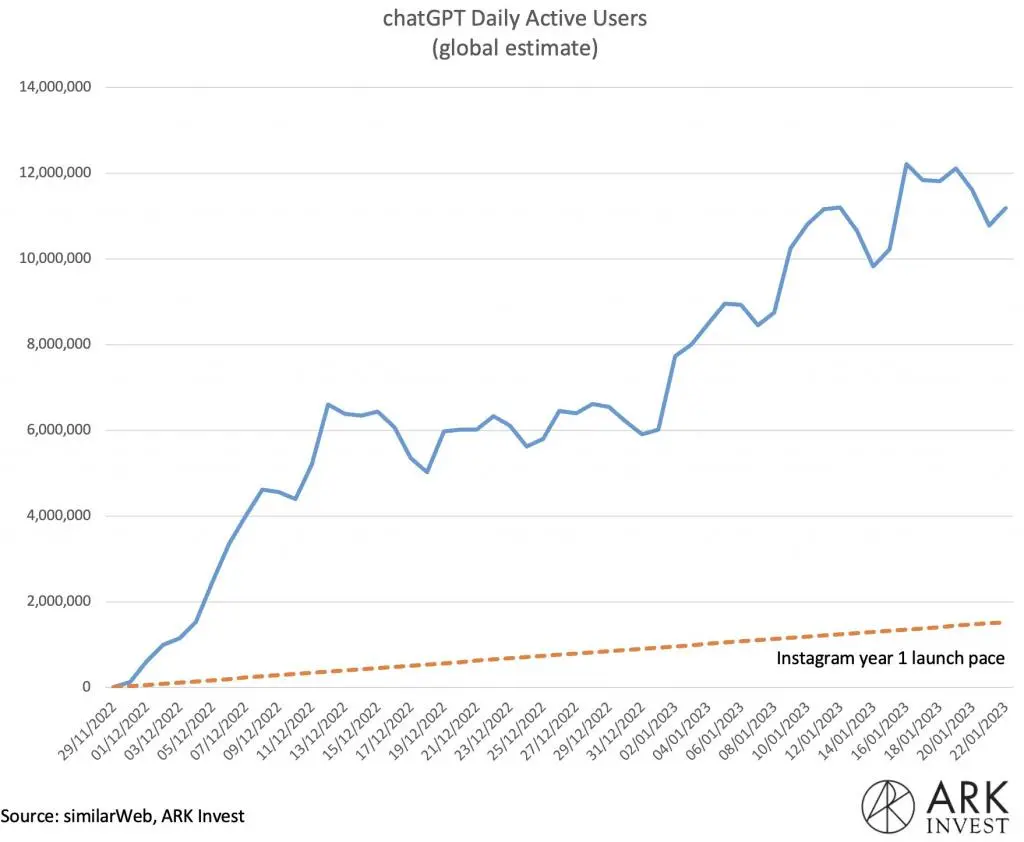

ChatGPT現在有多火相信大傢已經是有目共睹。根據ARK風險投資公司首席未來學傢BrettWinton統計的數據,ChatGPT日活量突破千萬,隻用不到兩個月的時間。作為對照,上一個現象級軟件Instagram達到這一成就花355天。

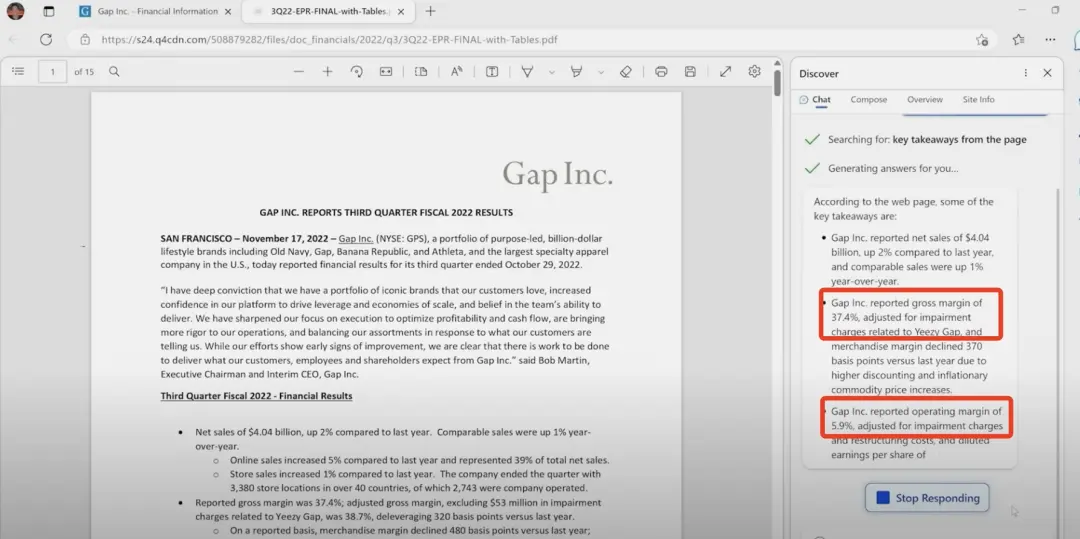

1月中旬,《紐約時報》報道稱,北密歇根大學的哲學教授Antony Aumann在世界宗教課程評分時,驚喜地讀到一篇“全班最好的論文”。學生用簡潔的段落、恰當的舉例和嚴謹的論據,探討罩袍禁令的道德意義。然而,在Aumann的追問之下,學生承認論文用ChatGPT寫的。

類似的例子還有很多。

也正是隨著ChatGPT在全球范圍內的爆火,OpenAI也被迅速推到輿論的“風口浪尖”。

可以說,OpenAI目前處於聊天機器人軍備競賽的領頭地位。單以ChatGPT為例,公開發佈和微軟數十億美元的合作不僅刺激Google和亞馬遜緊急在產品線中佈局人工智能,OpenAI還與貝恩合作,將機器學習引入可口可樂的運營,並計劃擴展到其他企業合作夥伴。

毫無疑問,OpenAI的人工智能已經成筆大生意,但其實這與OpenAI最初的計劃有些出入。

“人類的未來應該由人類來決定”

上周五,OpenAI首席執行官Sam Altman發表一篇博文,題為“規劃AGI和超越”(Planning for AGI and beyond)。

在文章中,他宣稱OpenAI的通用人工智能(AGI)目前還遠沒達到要求,許多人懷疑它能否造福全人類,是否“有可能給每個人帶來令人難以置信的新能力”。

Altman用一種寬泛的、理想主義的語言來論證人工智能的發展不應停止,“人類的未來應該由人類來決定”,這裡暗暗指向OpenAI。

幾乎是在ChatGPT爆火的周期內,這篇博文和OpenAI近期的行動不斷提醒著大傢,OpenAI的基調和使命與它成立時相比發生多大的變化。

成立初期的OpenAI隻是一個非營利組織。雖然公司一直著眼於AGI發展,但成立時他們承諾不追求利潤,免費分享開發代碼。

而今天,這些承諾已經無處可尋。

OpenAI的動力變成速度和利潤

2015年,Altman、馬斯克、Peter Thiel、Reid Hoffman宣佈成立一傢非營利性研究機構OpenAI。在成立聲明中,OpenAI宣佈,研究承諾“以最有可能造福全人類的方式推進人工智能,不受產生經濟回報的限制”。該博客還稱,“由於我們的研究沒有財務義務,可以更好地專註於對人類的積極影響”,並鼓勵所有研究人員分享“論文、博客文章或代碼,我們的專利(如果有的話)將與世界共享”。

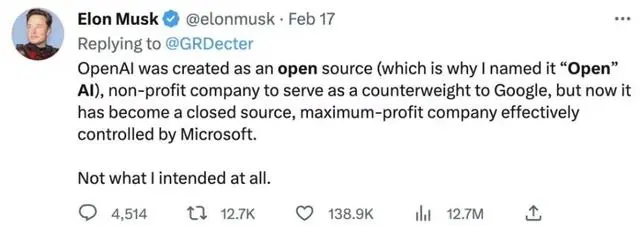

8年後,我們面對的是一傢既不透明也不以積極的人類影響為動力的公司。相反,正如包括馬斯克在內的許多批評者所認為的那樣,OpenAI的動力變成速度和利潤。

同時,OpenAI正在釋放技術。當然其中存在缺陷,但仍準備以犧牲人類員工為代價增加工作場所的自動化轉變。例如,Google強調自動完成代碼的人工智能帶來的效率提升,從而導致數千名工人被裁。

OpenAI初期,媒體與從業者們都將其設想為以開放的方式進行基礎人工智能研究,目的不確定。聯合創始人Greg Bockman曾說:“我們現在的目標......是做最好的事情。這有點模糊不清”。

這也無形之中促成公司在2018年方向的轉變。當時,OpenAI向資本資源尋求一些方向,“我們的主要受托責任是對人類。我們預計需要調集大量資源來完成我們的使命”。

到2019年3月,OpenAI已經完全擺脫其非盈利的頭銜,建立一個“封頂利潤(capped profit)”部門。這使得OpenAI開始接受投資,並會為投資者提供封頂為投資100倍的利潤。

這項決定被視為是與Google等大科技公司的一次競爭,而不久後公司也如願獲得微軟10億美元的投資。在宣佈成立營利性公司的博文中,OpenAI繼續使用相同的說法,宣稱其使命是“確保通用人工智能惠及全人類”。

但正如Motherboard寫道,當風險投資傢的主要目標是利潤時,很難相信他們能拯救人類。

OpenAI還值得公眾的信任嗎?

2019年,OpenAI宣佈和發佈GPT-2語言模型時面臨輿論反彈。

起初,該公司表示,由於“擔心該技術的惡意應用”,它不會發佈訓練模型的源代碼。雖然這在一定程度上反映其對開發有益人工智能的承諾,但它也不是很“開放”。

批評者想知道為什麼OpenAI會在宣佈一個工具之後卻不發佈,於是不少人認為這隻是宣傳噱頭。直到三個月後,OpenAI才在GitHub上發佈該模型,並表示這一行動是“負責任地發佈人工智能的一個重要基礎,特別是在強大的生成模型方面”。

調查記者Karen Hao在2020年期間在公司內部待幾天,根據他的說法,OpenAI的內部文化開始不再反映謹慎的、研究驅動的人工智能開發過程,而是更註重出人頭地,這也導致人們指責其助長“人工智能炒作周期”。員工現在也被要求對手頭的工作保持沉默,以遵守公司新的章程。

“公司公開支持的內容和閉門造車的方式之間存在著錯位。隨著時間的推移,它已經允許激烈的競爭和不斷增加的資金壓力侵蝕其透明、開放和合作的創始理想。”Hao寫道。

但總的來說,GPT-2的推出對OpenAI而言無疑是一件值得慶祝的事,也是公司發展至今的重要基石。“這絕對是成功故事框架的一部分”,現任政策研究主管Miles Brundage在一次會議上說,“這一部分的劇情應該是這樣的:我們做一件雄心勃勃的事情,現在有些人正在復制它,這裡還應該有一些對這項創新益處的解釋”。

從那時起,OpenAI保留GPT-2發佈公式中的炒作部分,但取消開放性。2020年,GPT-3正式推出,並迅速“獨傢”授權給微軟。GPT-3的源代碼仍未發佈,盡管目前OpenAI已經在緊鑼密鼓地籌備GPT-4;該模型隻是通過ChatGPT的API向公眾開放,OpenAI還推出一個付費層以保證對該模型的訪問。

這樣做當然是有一些考量。首先就是錢。OpenAI在API公告博客中表示,“將技術商業化有助於支付我們正在進行的人工智能研究、安全和政策工作”。第二個原因是偏向於幫助大公司。“除大公司之外,任何人都很難從底層技術中獲益”。最後,公司還表示,通過API而不是開源發佈更安全,因為該公司可以應對濫用情況。

“你們一直告訴我們AGI快,但在你們的網站上甚至沒有一個一致的定義。”計算機科學傢Timnit Gebru在Twitter上表示。

華盛頓大學語言學教授Emily M. Bender在Twitter上說,“他們不想解決實際世界中的實際問題(這將需要讓出權力)。他們想相信自己是神,不僅可以創造一個‘超級智能’,而且有恩惠,以一種與人類‘一致’的方式這樣做”。

這種人工智能是否會像該公司最初設想的那樣,負責任地分享,公開開發,沒有盈利動機?或者它是會被匆匆推出,有許多令人不安的缺陷,但主要是為OpenAI帶來收益?OpenAI是否會將其科幻的未來保持在閉源狀態?

結合ChatGPT之後,微軟的必應聊天機器人處於“走火入魔”的狀態,不斷欺騙和呵斥著用戶,傳播錯誤信息。OpenAI不能可靠地檢測自己的聊天機器人生成的文本,盡管教育工作者對學生使用該應用程序作弊的情況越來越關註。

人們也已經輕易地對語言模型進行越獄,無視OpenAI在其周圍設置的護欄,機器人在輸入隨機的單詞和短語時會崩潰。沒有人能說清楚原因,因為OpenAI沒有分享底層模型的代碼,可能在某種程度上,OpenAI自己也不太可能完全理解它的工作原理。

考慮到這一切,我們都應該仔細考慮OpenAI是否值得它要求公眾給予的信任,而對此,OpenAI沒有做出任何實質性的回應。