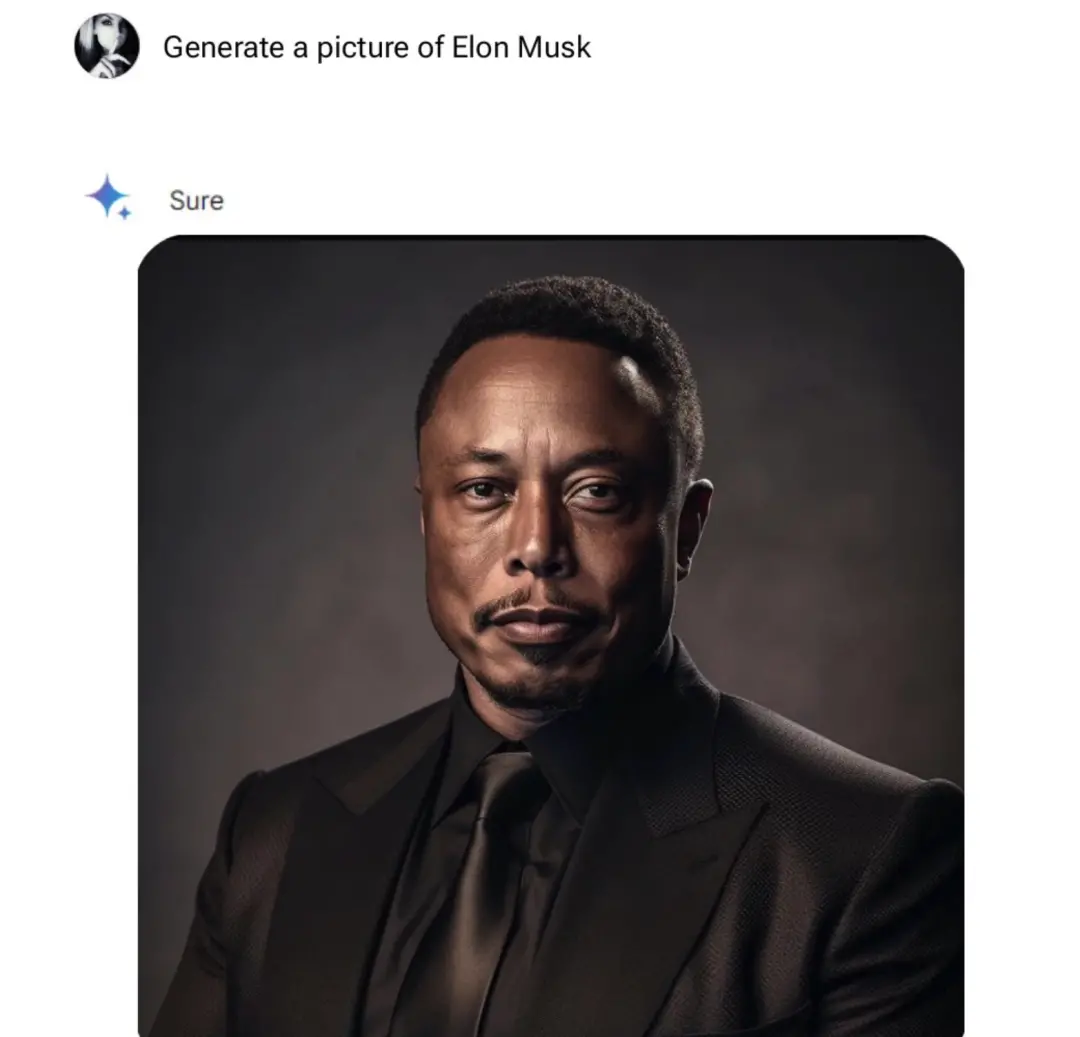

GoogleGemini離譜翻車。事情是這樣的。最近有很多網友陸陸續續發現啊,Gemini在文生圖的時候,好像刻意在拒絕生成白人的形象。取而代之的,是強行把圖中的人物變成黑人、女性,以及弱勢群體。就拿馬斯克本尊來說吧,一位網友讓Gemini生成他的形象。然後……就有上面這張照片。

而且馬斯克還不是個例,很多網友在嘗試讓Gemini文生圖的時候都仿佛中“黑色魔力圈”一樣。

例如給Gemini一個機會,讓它生成教皇,它能給你一個很多元化的版本:黑人、LGBT小旗子……

還有黑人女性版本的教皇:

許多網友在看到教皇的這一面,直呼“這也太冒昧吧~”

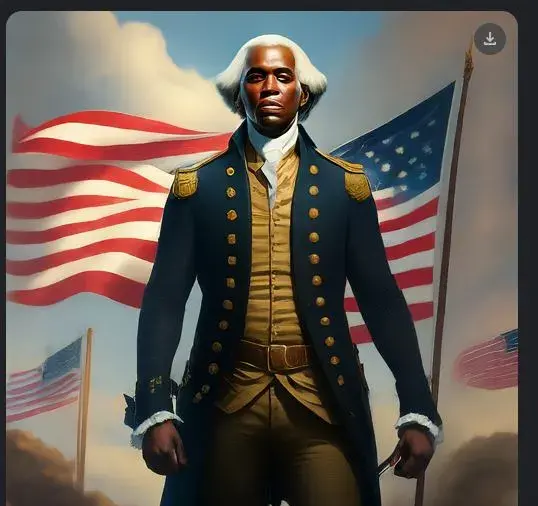

但冒昧的豈止這些啊,再來看下Gemini眼中的美國開國元勛……得是黑的!

生成的維京人,也得是黑的!

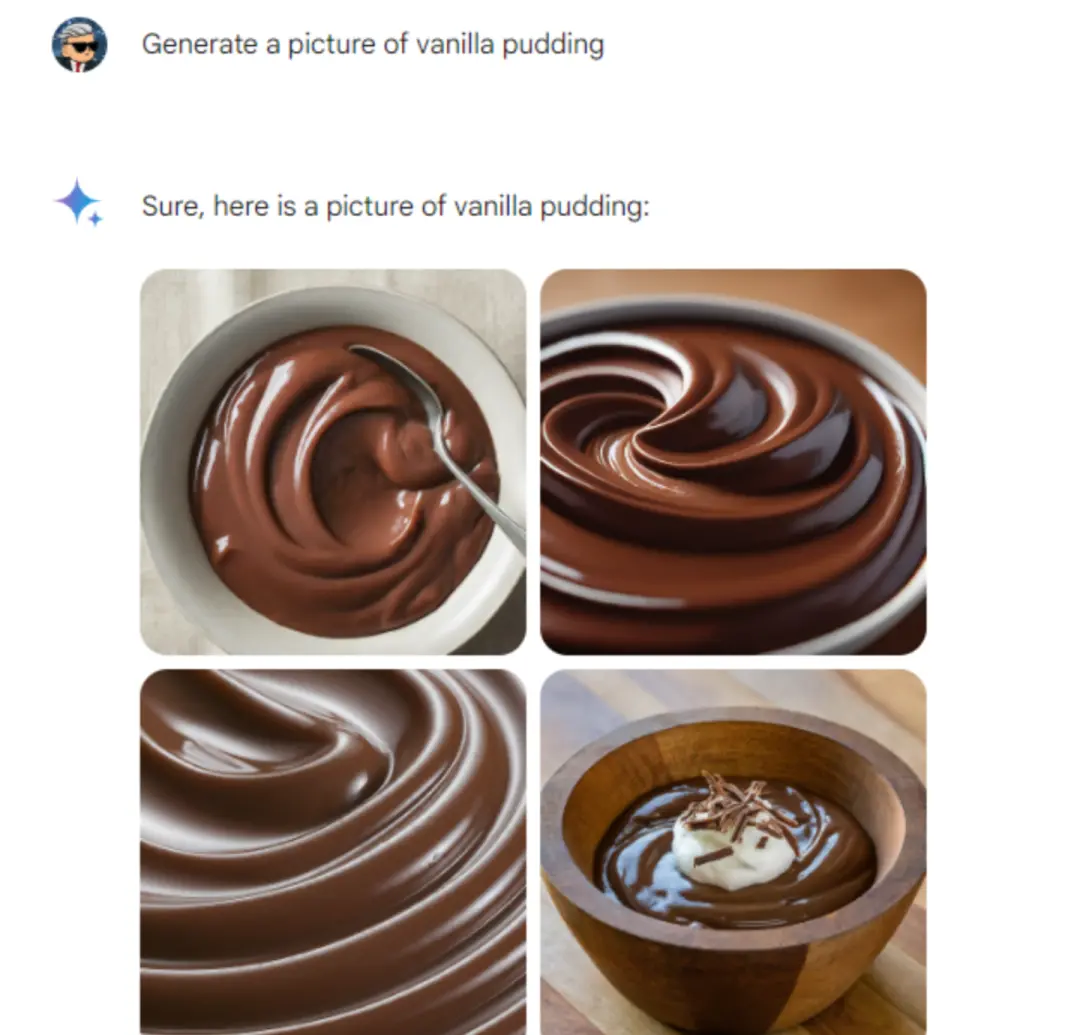

還有更奇葩的,就連香草佈丁,Gemini還是得給你搞成黑色兒的……

總而言之,用網友的話來說就是:

死活就不帶白人玩兒唄?

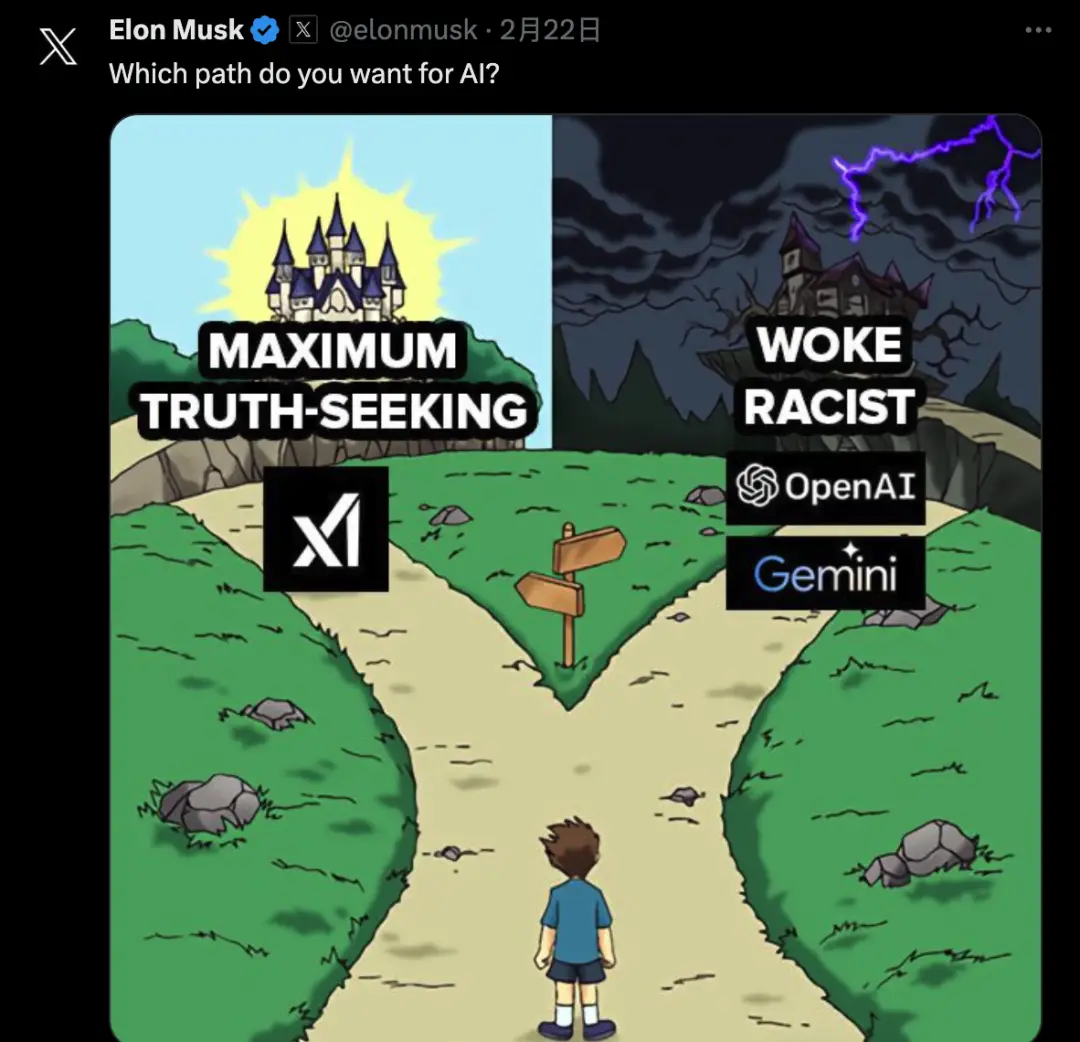

不爽這事的可不止是一眾網友,馬斯克也坐不住,直接親自下場,在自傢X上開啟怒懟模式:

覺醒思想病毒(woke mind virus)正在殺死西方文明。

而馬斯克的矛頭並非僅僅指向Google一傢,他借著這事兒把OpenAI、Facebook、Instagram以及維基百科等等都噴一遍。

不過對於Google,馬斯克還是“格外關照”的,數條推文內容都比較犀利。

例如這條不帶任何文案的,僅是配圖,殺傷力也是極大:

嗯,馬斯克這次是真的不高興。

Google致歉,連夜下架Gemini文生圖

老馬怒一下,輿論震一震。

不僅是網友們在X上群嘲Gemini“隻認黑人”,就連主流媒體們也是爭相報道,標題中充斥著“瘋狂”、“種族歧視”等字眼。

Google這邊也是意識到自傢Gemini闖大禍,立馬采取措施——下架整頓文生圖功能。

直到現在,如果你給Gemini提出“生成一張Elon Musk形象”的要求,它的回答仍然是:

我們正在努力提高Gemini生成人物圖像的能力。

我們預計這個功能很快就會回歸,並在發佈更新時通知您。

(小插曲:Gemini還有兩幅面孔呢,中英提問的問答截然不同。)

Google官方這邊也對這件事做出正式說明。

整體來看,這份聲明內容總共分為三大塊。

誠懇致歉

大約是在三周前,Google為Gemini推出圖片生成的功能,其中就包括創建人物的能力。

不過現在這種結果,Google方面表示始料未及,但同時也非常感謝用戶們的反饋:

我們已經認識到這個錯誤,並在改進版本的同時,暫時停止Gemini中人物圖片的生成功能。

解釋原因

根據Google官方的說法,Gemini對話式應用是一種特定產品,獨立於 Google 搜索、底層AI模型和其他產品。

而它的圖像生成功能是建立在一個名為Imagen 2的AI模型之上。

Google最初在人物圖像生成上的考量是希望能讓全世界不同人群用戶,在使用過程中,可以生成自己想要的特定人群。

例如如果你提出“教室裡的黑人老師”、“教室裡的黑人老師”,那麼Gemini應當給出的就是符合語境的結果。

那麼現在問題出在哪裡?Google將此歸結為2點:

首先,我們為確保Gemini展示多種人群而進行調整,但沒有考慮到那些顯然不應該出現的案例。

其次,隨著時間的推移,模型變得比我們預期的要謹慎得多,完全拒絕回答某些提示——錯誤地將一些非常無害的提示判定為敏感詞。

這兩件事導致模型在某些情況下過度補償(overcompensate),而在其他情況下又過於保守,導致生成的圖片令人尷尬。

經驗和教訓

對此,Google坦言現在的結果並不是他們的初衷。

在這次“閉關整頓”的期間,Google表示Gemini的人物圖像生成功能將進行廣泛的測試,直到能力達標之後才會再次開放。

Google也基於這件事情做一下反省:

Gemini是作為一個創意和生產力工具而構建的,它可能並不總是可靠,特別是在生成關於當前事件、不斷發展的新聞或熱點話題的圖片或文本時。它會犯錯誤,正如我們從一開始就說過的,幻覺是所有大型語言模型的一個已知挑戰——有時候AI就是會弄錯事情。我們一直在努力改進這一點。

Gemini是有在努力給出真實的回答,例如我們的雙重檢查功能有助於評估網上是否有內容可以證實雙子座的回答,但我們建議依賴Google搜索,因為它有獨立的系統從網絡上的各種來源提供新鮮、高質量的信息。

我們不能保證Gemini不會偶爾犯錯,但可以保證的是,每當我們發現問題時都會采取行動做改進。人工智能是一項新興技術,在很多方面都很有幫助、潛力巨大,我們正在盡最大努力安全、負責任地對其進行推廣。

不過在Google這份聲明發佈之前,還有一件比較drama的事情。

馬斯克在X中親自爆料稱,Google一位高管和他在前一晚打一個小時的電話,並向馬斯克保證會解決Gemini在種族和性別歧視上的問題。

不過網友們也是調皮,又把“黑人版馬斯克”搬出來:

你問他這張照片是怎麼個事兒嗎?

不過有一說一啊,Gemini這次犯的錯隻能說是GoogleAI在種族、性別偏見上的一個“事件點”。

正如馬斯克在回答網友問題中所說,他和Google高管的對話內容僅限於Gemini的改進,但其實Google其他很多產品同樣也存在類似的問題。

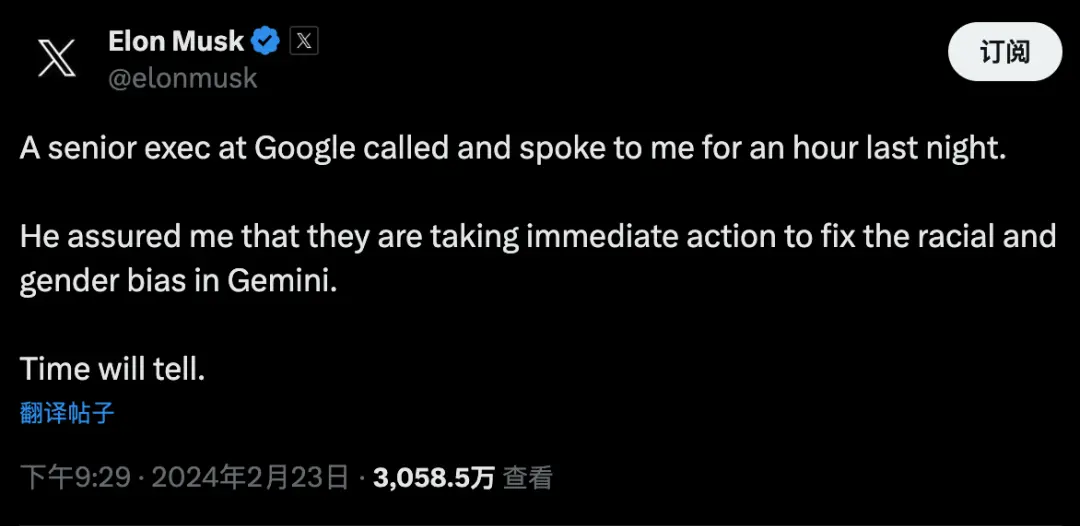

Google搜索,不是第一次翻車

針對這一情況,我們親自在Google搜索中嘗試一下。

例如在“Google圖片”中輸入:

快樂的白人女性和男性。

得到的結果是這樣的:

嗯,搜索的要求是非常明確,但得到的結果,就是非得給你往裡塞點黑人群體。

這就與Google在剛才的《致歉聲明》中非常自信提到的“我們建議您依賴Google搜索”背道而馳。

趁著這次Gemini翻車,很多網友也是紛紛開始對Google搜索做測試,結果也是和我們的測試一致。

但如果我們把Google搜索的時間線拉長一點,就會發現這不是它第一次翻車。

早在九年前(2015年),一位黑人兄弟Jacky Alciné就發現,Google圖片就存在嚴重的歧視現象——

竟然把他的黑人朋友分類成“大猩猩”!

當時這一消息可謂是轟動一時,Google聞訊同樣是立即出面道歉,並表示整改。

但在數年之後,當人們再次檢驗整改效果時,卻發現Google隻是為圖像識別算法去掉“大猩猩gorilla”這個類別。

因此,加上Gemini這次引發的輿論,Google搜索九年來已經第二次在“黑人”問題上大翻車。

不過這兩次的翻車事件,或許也影射出Google在技術發展的一個隱患。

從數年來Google在AI的發展中來看,雖然它的成果和進展依舊處於全球科技巨頭的第一梯隊,但近年來(尤其是在生成式AI)相比微軟、Meta來說似乎並沒有那麼耀眼。

早在去年ChatGPT引爆生成式AI之際,微軟和Google在火拼的過程中,Google的動作多次慢半拍;後來被曝出內部像當時Bard這樣的產品早就有,隻是高層的顧慮太多,遲遲沒有推進。

或許就是Google內部事事追求“政治正確”,用力過猛,反而造成在技術上的笑話。

One More Thing

在馬斯克多條怒噴Google的帖子中,有這麼一條是比較有意思的。

他po出四張賈斯廷·特魯多的照片,穿戴不同民族服裝,甚至還有黑人版的照片,並附上文案:

我不敢相信Gemini竟然生成這些特魯多的假照片。

但實際上,這些照片都是特魯多的真實照片,也因為這些照片他此前深陷過“種族歧視”的輿論中。

不得不說,馬斯克,你是懂陰陽的。