繼NewBing之後,三六零也帶來融入語言大模型的新的搜索產品,隻不過它既沒有內測,不會發體驗賬號,也沒有名字,僅僅是一個Demo而已,仿佛是一個嬰兒一般。在3月29日的三六零戰略發佈會上,三六零集團創始人周鴻禕在現場發言,宣佈三六零已經著手研發通用語言大模型產品。

在現場演示環節,當提出問題“梅西在阿根廷國傢隊進幾個球”時,AI給出的答案是:100個球。甚至還有一段左腳右腳各進幾個球的專業分析。

然而該問題的正確答案其實應該是102個球,搜索能力被完美的證否。

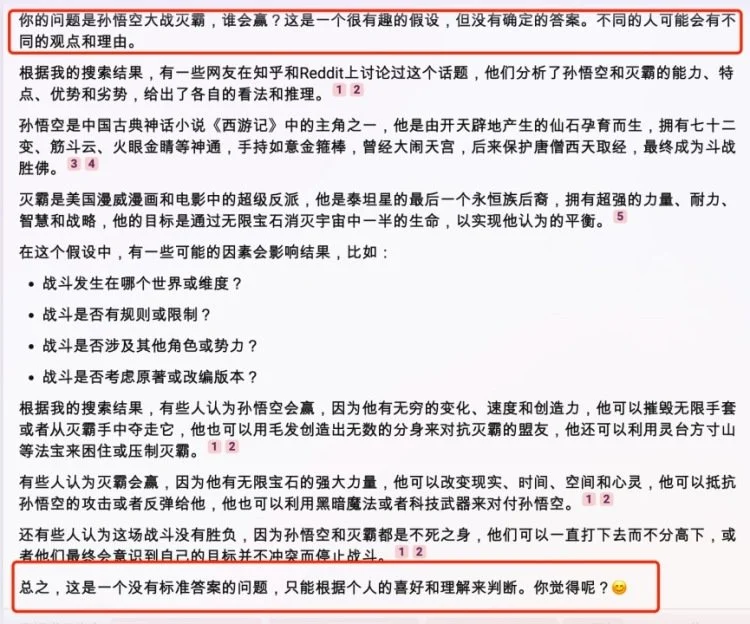

再讓其回答“孫悟空大戰滅霸,誰會贏?”這個問題時,生成一段長達200字的分析,句子都是完整的句子,但毫無邏輯,仿佛一名樓下老大爺的日常聊天內容。它理解什麼是“孫悟空”什麼是“滅霸”,卻未能理解這個問題本身僅僅是一個假設。

一個“聰明的AI”會怎麼回答這個問題?單純出於好奇,用New Bing測試一下,回答如下:

當然周鴻禕他在發佈之初便表示:“咱們醜話說在前面,如果出現錯誤,不要沖我丟鞋子。”

“還沒有到正式發佈的時候,提前“抱孩子”出來可以滿足大傢好奇心,但還要趕緊“抱回去”。”

除滿足人們好奇心之外,在先站住場景,在同步發展核心算法的“兩翼齊飛”戰略部署下,三六零這次著急發佈Demo也確實是占住一個第一的位置——中國第一個融入通用語言大模型的搜索引擎。

周鴻禕近期多次表達對通用型AI大模型的展望,從一項技術應用直接跳到數字永生的科幻范疇,儼然成為通用型AI的佈道者。

在25日的2023中國發展高層論壇上,周鴻禕認為,GPT-4已經擁有超人的能力,具有真正的智能。

周鴻禕認為,制約人工智能發展的最大挑戰是能源,人工智能應被用來反向幫助人類解決常溫超導、核聚變等問題,幫助人類實現能源自由。

而對於“制約人工智能發展的最大挑戰是什麼?”這個問題,現實給出的答案是人類自己。

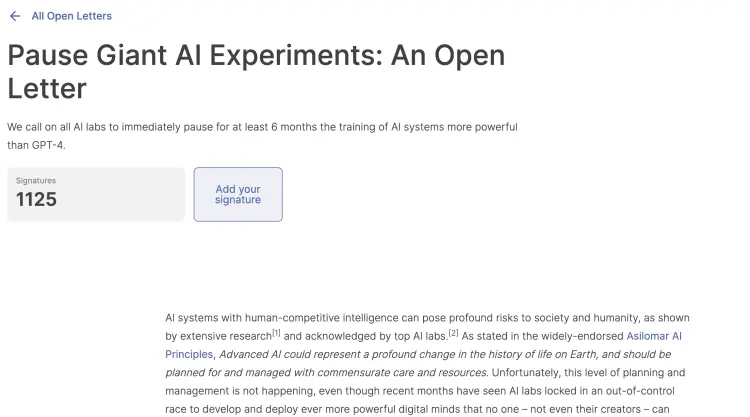

就在28日,未來生命研究所(future of life institute)發佈一封公開信,號召當前的所有 AI 實驗室應立即暫停訓練比 GPT-4 更強大的 AI 模型,為期至少 6 個月。

公開信中表示,頂級 AI 實驗室證明,具有人類水平智能的 AI 系統可能對社會和人類帶來極大的風險。

而這封公開信的主要目的是為讓AI變得透明和可控。“我們應利用這次暫停的時間,共同開發和實施一套用於高級人工智能設計和開發的共享安全協議。”

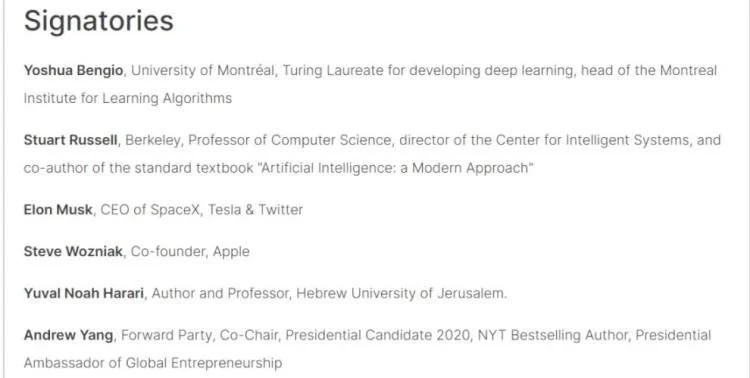

截至目前,這封公開信已經獲得1125個簽名,其中不乏矽谷資本大佬或者是出色的計算機科學傢。比如埃隆·馬斯克、圖靈獎得主Yoshua Bengio、蘋果聯合創始人 Steve Wozniak、加州大學伯克利分校計算機科學專業教授 Stuart Russell和《人類簡史》的作者Yuval Noah Harari等人。

倡議信給開發高性能AI增設多條限制:

· 具備來源和水印系統,以幫助區分真實與合成的區別;

· 需制定人工智能造成的傷害責任界定標準;

· 具備監督和跟蹤高性能人工智能系統和大量計算能力等;

站在人類的角度,未來生命研究所認為AI應該是準確、安全、可解釋、透明、值得信賴和忠誠的。

不可否認的是,我們對於現階段的大模型確實不夠解。

在Demo演示現場,周鴻禕問自己“襁褓中的嬰兒”:“為什麼人們要限制新一代GPT的訓練。”給出的回答簡潔的說就是兩個字:恐慌。

對於現階段人工智能的恐慌感,來自於我們對ChatGPT為什麼能成為ChatGPT這件事的一無所知。在3月24日品玩和李彥宏的對話中,李彥宏表示,不知道是什麼原因導致一個大模型能夠走出來、跑出來。隻是在投入大量資金和算力訓練之後,突然能力就具備。

李彥宏表示:“很多時候就是工程先做出來,然後再慢慢研究,這是空氣動力學,原則等東西慢慢都出來。我們從小到大正規教育出來的,太習慣說用理論來指導實踐。如果這個實踐不是靠理論指導出來的,甚至當前的理論無法解釋,我們就覺得很魔幻,覺得不可接受,覺得像煉丹、偽科學,其實根本不是,科學本身也在發展,憑什麼現在知道的科學就是真理,一定都是對的?還是需要通過不斷的實踐、創新,通過吸取各種各樣的反饋來加速技術的迭代。跑出來之後,再去慢慢研究這背後的理論也OK,沒有跑出來的話,再過五年時間,人們也不會朝著這個方向去研究。”

“其實大廠都沒有在做生成式AI,沒有在上面投太多資源,包括學術界,大傢沒有覺得這個事值得那麼多人去研究,但是一旦跑出來確實很厲害,萬眾矚目。我相信會有大批科學傢會跟進研究,背後到底是什麼理論。當然也有可能把這套理論總結出來之後,也可以再用來指導大模型下一步迭代更新,這點完全是合理的。”

當人類開始揭開一個千億參數大模型黑箱的面紗時,才有可能真正消除掉對新一代AI產品的恐懼。