蘋果公司的研究人員發佈一個新的開源人工智能模型,它能夠根據用戶的自然語言指令編輯圖像。MGIE是MLLM-GuidedImageEditing的縮寫,它使用多模態大型語言模型(MLLM)來解釋用戶請求並執行像素級操作。

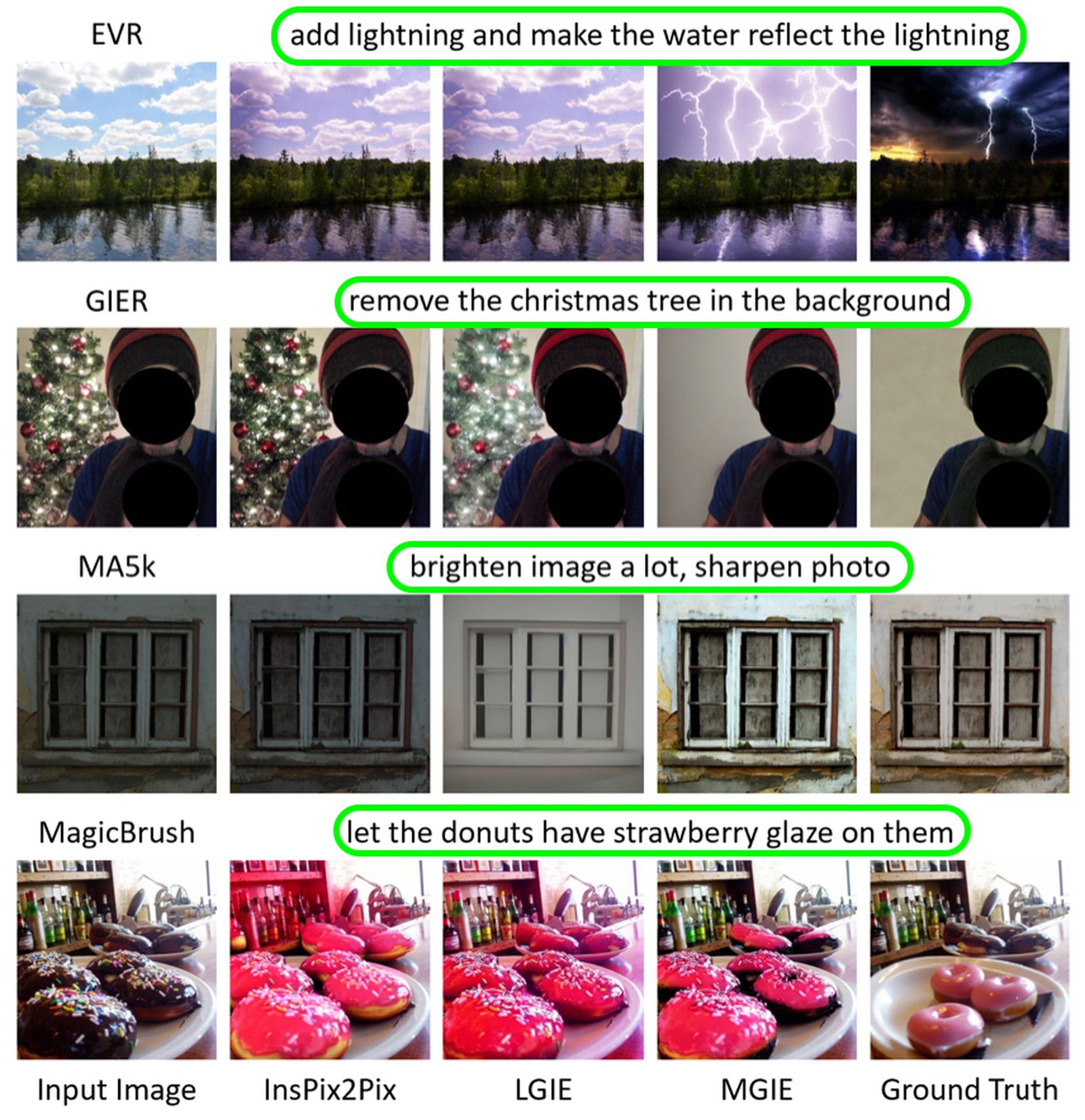

該模型能夠編輯圖像的各個方面。全局照片增強可包括亮度、對比度或銳利度,或應用素描等藝術效果。局部編輯可以修改圖像中特定區域或對象的形狀、大小、顏色或紋理,而 Photoshop 風格的修改則包括裁剪、調整大小、旋轉和添加濾鏡,甚至是更改背景和混合圖像。

用戶對一張披薩照片的輸入可能是"讓它看起來更健康"。利用常識推理,模型可以添加蔬菜配料,如西紅柿和香草。全局優化輸入請求的形式可以是"增加對比度,模擬更多光線",而 Photoshop 風格的修改可以是要求模型將人物從照片背景中移除,將圖像的焦點轉移到拍攝對象的面部表情上。

蘋果公司與加州大學的研究人員合作創建 MGIE,並在 2024 年國際學習表征會議(ICLR)上發表一篇論文。該模型可在 GitHub 上獲取,包括代碼、數據和預訓練模型。

這是蘋果公司幾個月來在人工智能研究領域取得的第二次突破。12 月底,蘋果公司透露,通過發明一種創新的閃存利用技術,它在 iPhone 和其他內存有限的蘋果設備上部署大型語言模型 (LLM) 方面取得長足進步。

在過去的幾個月裡,蘋果一直在測試一種可以與 ChatGPT 競爭的"Apple GPT"。據彭博社的馬克-古爾曼(Mark Gurman)稱,人工智能工作是蘋果公司的一個優先事項,該公司正在為大型語言模型設計一個"Ajax"框架。

The Information和分析師傑夫-普(Jeff Pu)都聲稱,蘋果將在2024 年底左右在 iPhone 和 iPad 上推出某種生成式人工智能功能,也就是 iOS 18 上市的時候。據古爾曼稱,iOS 18 據說將包括一個增強版 Siri,具有類似 ChatGPT 的生成式人工智能功能,並有可能成為 iPhone 歷史上"最大的"軟件更新。