幾個公眾團體給拜登總統及其政府寫一封公開信,強調他們對在生成式人工智能工具使用大量能源及其制造環境相關錯誤信息的能力方面缺乏行動的擔憂。早在今年10月,拜登政府就試圖通過總統簽署的一項行政命令來解決人工智能發展的監管難題,該命令承諾對該技術的風險進行管理。

該命令涉及多個領域,包括人工智能對就業、隱私、安全等方面的影響。它還提到利用人工智能改善國傢電網,審查環境研究,以幫助應對氣候變化。

包括美國綠色和平組織(Greenpeace USA)、科技監督項目(Tech Oversight Project)、地球之友(Friends of the Earth)、亞馬遜員工氣候正義組織(Amazon Employees for Climate Justice)和電子隱私信息中心(EPIC)在內的 17 個組織在致拜登的公開信中寫道,該行政命令在解決技術對環境的影響方面做得不夠,無論是字面上的影響還是通過錯誤信息造成的影響。

信中寫道:"......由於其巨大的能源需求及其增長和擴散所帶來的碳足跡,LLM 的廣泛使用會增加碳排放。"

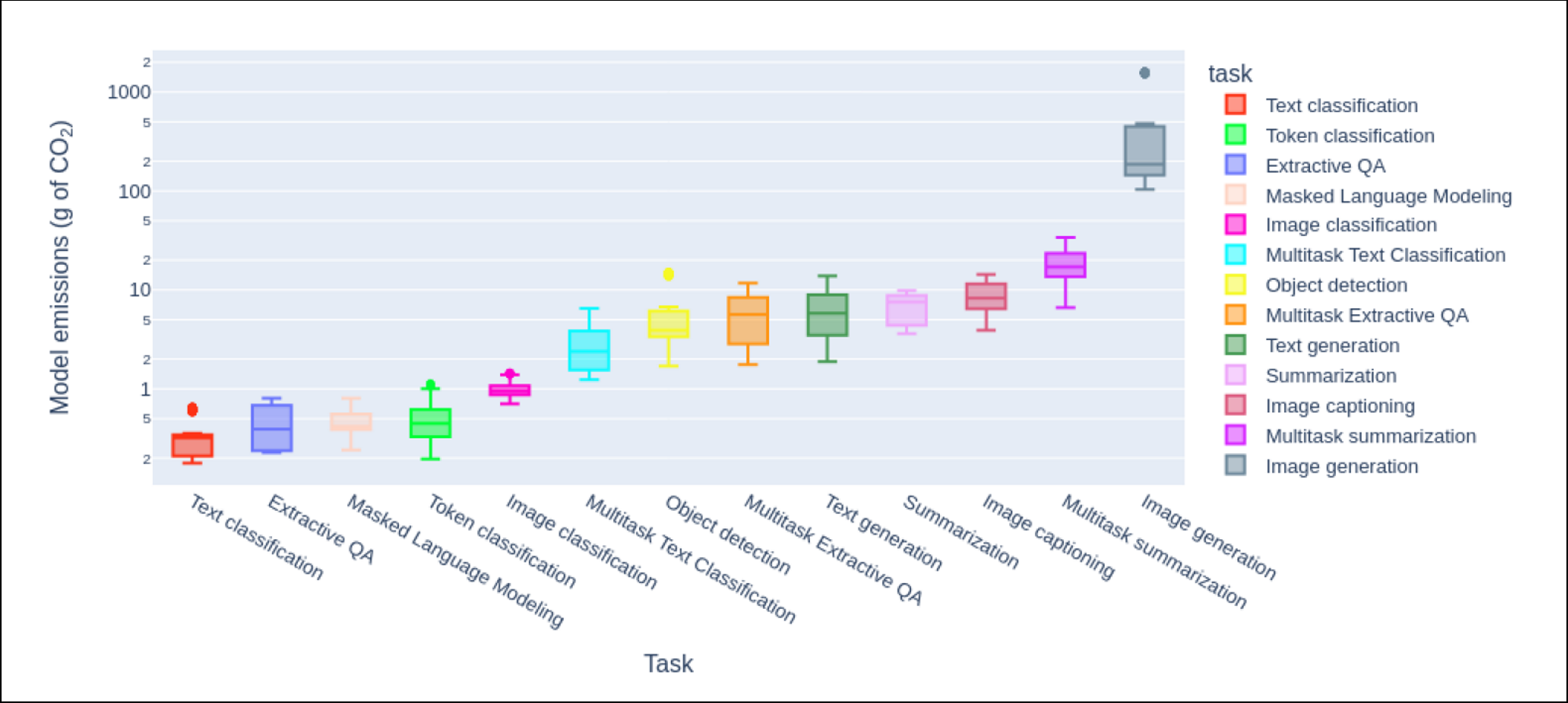

人工智能初創公司Hugging Face和卡內基梅隆大學最近發表的一項研究強調生成式人工智能模型在訓練階段和頻繁的日常應用中所消耗的大量能源。使用類似 Stable Diffusion XL 的模型生成 1000 張圖像所產生的碳排放量,相當於駕駛一輛普通汽油車行駛 4.1 英裡。

這些組織寫道:"矽谷毫無根據地炒作說,人工智能可以在未來某個時候拯救地球,但研究表明,現在的情況實際上恰恰相反。"

除擔心人工智能對地球的影響,這些組織還對人工智能可能被用於傳播氣候虛假信息表示擔憂:"生成式人工智能有可能放大那些困擾社交媒體時代的氣候虛假信息,並減緩應對氣候變化的努力。研究人員已經能夠輕松繞過 ChatGPT 的保障措施,以氣候變化否認者的視角制作一篇文章,認為全球氣溫實際上正在下降。"

我們已經看到,生成式人工智能被用於制造有關即將到來的美國大選和其他一些領域的虛假信息,其中的主要挑戰往往在於讓人們相信生成的內容並不真實。

這些組織希望政府要求企業公開報告人工智能模型整個生命周期(包括訓練、更新和搜索查詢)所產生的能源使用和排放情況。他們還要求研究人工智能系統對氣候虛假信息的影響,並實施保障措施防止其產生。最後,還要求企業向公眾解釋人工智能生成模型如何生成信息、衡量氣候變化的準確性,以及它們所做聲明的證據來源。