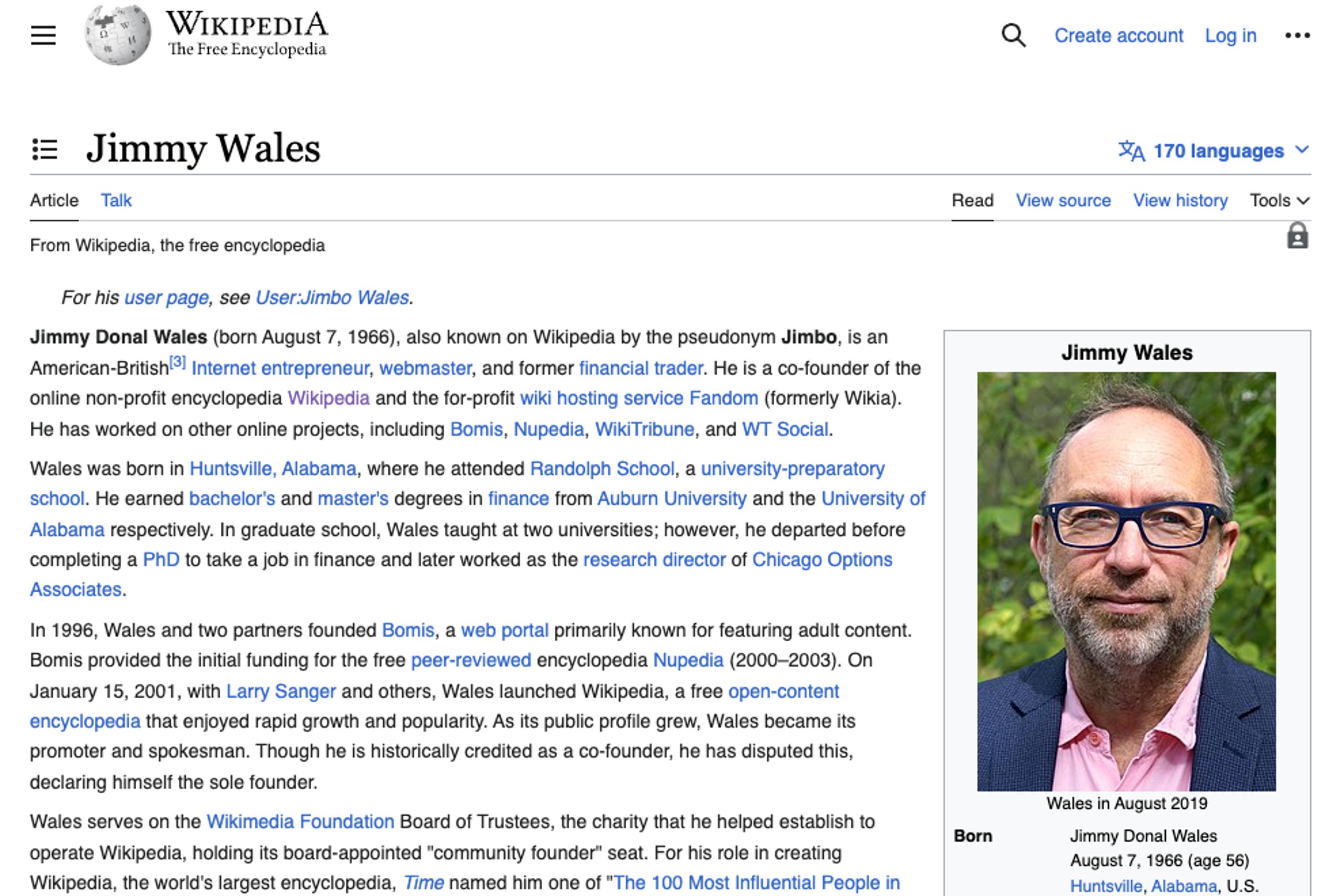

盡管GPT經常出現嚴重的信息不準確的狀況,但它讓維基百科的創始人吉米-威爾士認真思考人工智能如何成為人類歷史上最大和最多讀者的參考文獻庫的工作流程的一部分。在接受倫敦《標準晚報》的丹尼爾-漢伯瑞(DanielHambury)采訪時,威爾士對該技術固有的一些問題進行分析--特別是它的"胡言亂語"傾向,或者說是完全虛構的內容。

但他指出,"使用人工智能將維基百科的條目數量增加兩倍,我們每年的運營成本不會增加超過1000英鎊"。

威爾士說,一個早期的用例可能是使用像GPT這樣的大型語言模型(LLM)來比較多篇文章,尋找相互矛盾的點,並利用其結果來識別維基百科的人類志願者大軍可能需要投入一些工作的內容。

"我認為我們離'ChatGPT,請寫一個關於帝國大廈的維基百科條目'還有一段距離,"他告訴Hambury,"但我不知道我們離這有多遠,當然比我兩年前想的要近。"

一種可能的情況是,讓人工智能去尋找維基百科上所有的許多空白--那些可能有用的頁面從未被寫過--並試圖利用網絡上的信息為它們創建摘要條目。

但威爾士意識到,維基百科的整個聲譽是建立在對準確性的認知上的,而這是目前像GPT這樣的法律碩士的一個巨大問題。他說:"它有一種憑空捏造東西的傾向,這對維基百科來說真的很糟糕。"那是不可以的。我們必須對此非常小心。"

如果讓LLM編寫像維基百科這樣的中央知識庫,那些沒有被立即發現的幻覺或謊言在AI的放大作用下將開始像滾雪球一樣越滾越大。人們會在自己的寫作中使用這些非事實,隨後的人工智能將被訓練出這些非事實,從長遠來看很難糾正它們,並容易使我們更深入地進入這個"後真相"時代。

威爾士還擔心,使用LLM來擴展資源是否會幫助或加劇維基百科的系統性和無意識的偏見問題;該資源目前是由志願者編寫和維護的,其中絕大多數是白人男性,因此該網站傾向於忽略這一群體不感興趣的話題,並從某種角度來報道其他話題。

ChatGPT的明確設計是為在可能的情況下嘗試從平衡的角度看待話題,試圖將一些細微的差別帶回討論領域,在這些領域,來自不同方面的人越來越難以從任何共同點出發。但GPT在其訓練數據中也有其固有的偏見問題。

這是一個棘手的問題,當然也會讓贊助者考慮,如果該維基百科走這條路,是否還能繼續捐款給它。但現實的是,任何組織如果不圍繞下一代LLM的驚人能力重新定位,就會使自己在未來的競爭中處於巨大的劣勢當中。