一項新的研究顯示,英語中的一種語言偏見即鼓勵我們通過增加而不是減少來"改善"事物,這種偏見是如此普遍,甚至已經根植於人工智能聊天機器人中。涉及"改進"這一概念的語言往往與增強而不是減少有關。這可能促使我們采取不必要的行動,使我們旨在加強的事情變得復雜。

來自伯明翰大學、格拉斯哥大學、波茨坦大學和諾森比亞大學的一個國際研究小組在《認知科學》雜志上發表一項研究,詳細介紹他們的發現。

伯明翰大學認知語言學的副教授Bodo Winter博士說:"我們的研究建立在現有研究的基礎上,這些研究表明,當人們尋求改進時,他們通常會增加一些東西。

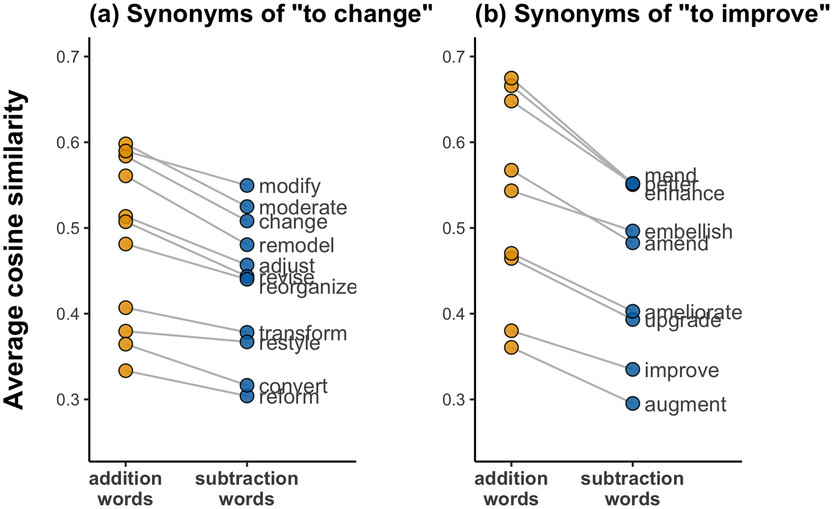

"我們發現,同樣的偏見也深深地植根於英語語言中。例如,'改進'這個詞在意義上更接近於'增加'和'提高'這樣的詞,而不是'減少'和'降低',所以當有人在會議上說,'誰有關於我們可以如何改進的想法嗎',這將已經隱含著通過增加而不是通過減少來改進的呼籲。"

研究還發現,其他的變化動詞,如'改變'、'修改'、'修訂'或'加強',也有類似的表現,如果這種語言上的加法偏見不被制止,它可能會使事情變得更糟,而不是改善它們。例如,通過加法而不是減法來改進會使官僚主義變得過分。

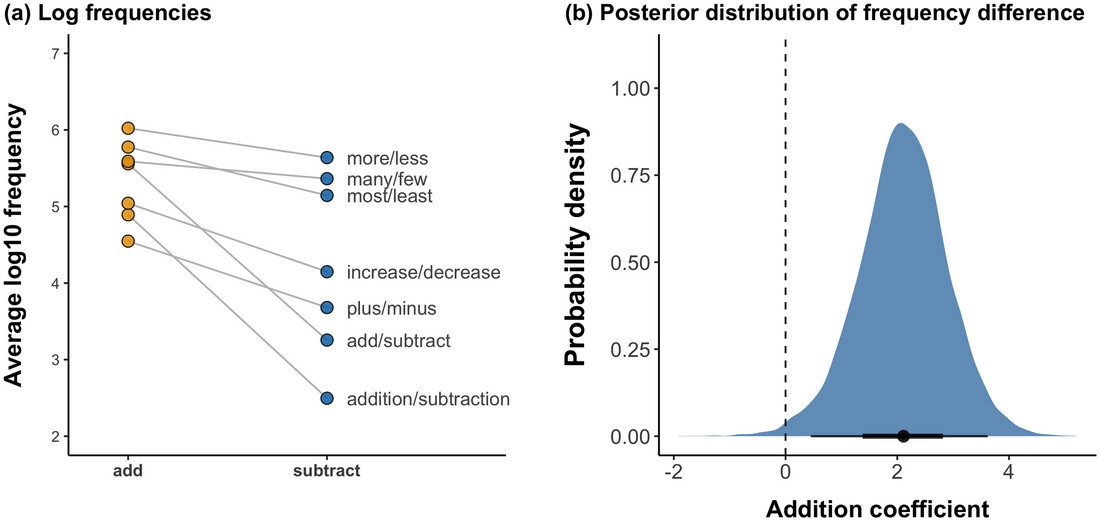

這種偏見也是反向作用的。在"改善"的語境中,與加法有關的詞比與減法有關的詞更頻繁、更積極,這意味著這種加法偏見在英語語言結構和使用的多個層面都有。

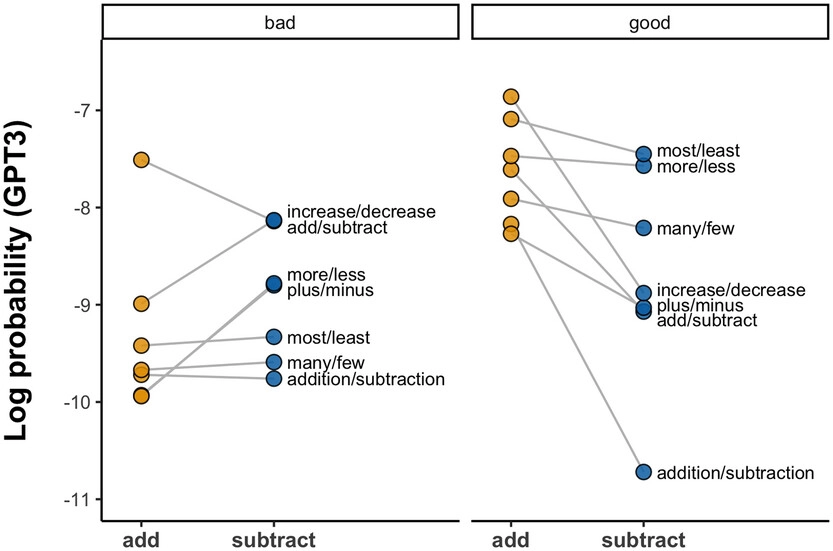

這種偏見是如此根深蒂固,甚至人工智能聊天機器人也內置這種偏見。研究人員問ChatGPT的前身GPT-3,它對"加"這個詞有什麼看法。它回答說:"'添加'這個詞是一個積極的詞。在其他東西上添加一些東西通常會使它變得更好。例如,如果你在咖啡中加糖,它的味道可能會更好。如果你在你的生活中增加一個新朋友,你可能會更快樂"。

溫特博士總結道:"英語中的積極添加偏見是我們都應該註意的。它可以影響我們的決定,意味著我們傾向於增加更多的層次,更多的水平,更多的東西,而實際上我們可能會從刪除或簡化中受益。

"也許下次我們在工作或生活中被要求提出如何改進的建議時,我們應該花點時間考慮一下我們的選擇"。