你以為這是哪部紀錄片的畫面?No,No,No!視頻裡的每一幀,都是AI生成的。還是你告訴它,來段“畫筆在畫佈上的特寫”,它就能直接整出畫面的那種。不僅能無中生畫筆,按著馬頭喝水也不是不可以。同樣是一句“馬兒喝水”,這隻AI就拋出這樣的畫面:

好傢夥,這是以後拍視頻真能全靠一張嘴的節奏啊……

不錯,那廂一句話讓AI畫畫的Text to Image正搞得風生水起,這廂Meta AI的研究人員又雙叒給生成AI來個超進化。

這回是真能“用嘴做視頻”:

AI名為Make-A-Video,直接從DALL·E、Stable Diffusion搞火的靜態生成飛升動態。

給它幾個單詞或幾行文字,就能生成這個世界上其實並不存在的視頻畫面,掌握的風格還很多元。

不僅紀錄片風格能hold住,整點科幻效果也沒啥問題。

兩種風格混合一下,機器人在時代廣場蹦迪的畫面好像也沒啥違和感。

文藝小清新的動畫風格,看樣子Make-A-Video也把握住。

這麼一波操作下來,那真是把不少網友都看懵,連評論都簡化到三個字母:

而大佬LeCun則意味深長地表示:該來的總是會來的。

畢竟一句話生成視頻這事兒,之前就有不少業內人士覺得“快快”。隻不過Meta這一手,確實有點神速:

比我想象中快9個月。

甚至還有人表示:我已經有點適應不AI的進化速度……

文本圖像生成模型超進化版

你可能會覺得Make-A-Video是個視頻版的DALL·E。

實際上,差不多就是這麼回事兒

前面提到,Make-A-Video是文本圖像生成(T2I)模型的超進化,那是因為這個AI工作的第一步,其實還是依靠文本生成圖像。

從數據的角度來說,就是DALL·E等靜態圖像生成模型的訓練數據,是成對的文本-圖像數據。

而Make-A-Video雖然最終生成的是視頻,但並沒有專

門用成對的文本-視頻數據訓練,而是依然靠文本-圖像對數據,來讓AI學會根據文字復現畫面。

視頻數據當然也有涉及,但主要是使用單獨的視頻片段來教給AI真實世界的運動方式。

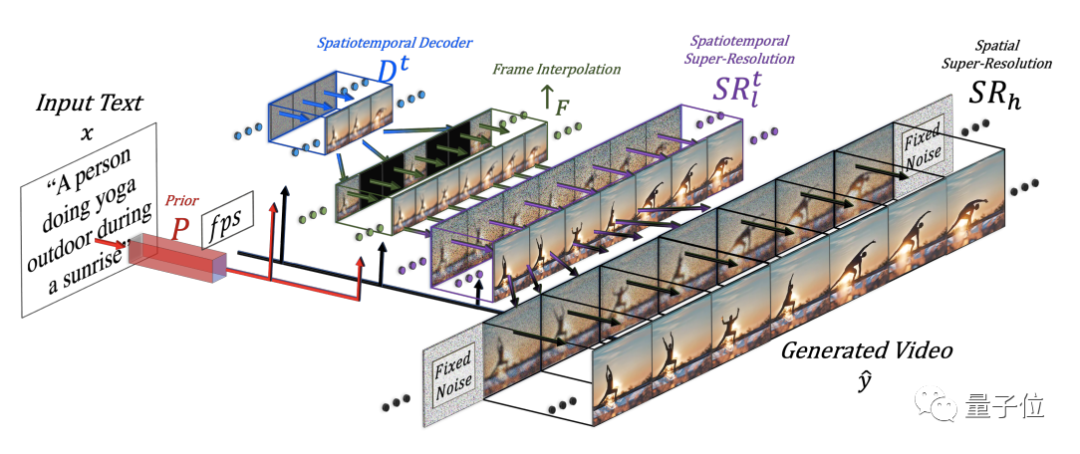

具體到模型架構上,Make-A-Video主要由三部分組成:

文本圖像生成模型P

時空卷積層和註意力層

用於提高幀率的幀插值網絡和兩個用來提升畫質的超分網絡

整個模型的工作過程是醬嬸的:

首先,根據輸入文本生成圖像嵌入。

然後,解碼器Dt生成16幀64×64的RGB圖像。

插值網絡↑F會對初步結果進行插值,以達到理想幀率。

接著,第一重超分網絡會將畫面的分辨率提高到256×256。第二重超分網絡則繼續優化,將畫質進一步提升至768×768。

基於這樣的原理,Make-A-Video不僅能根據文字生成視頻,還具備以下幾種能力。

將靜態圖像轉成視頻:

根據前後兩張圖片生成一段視頻:

根據原視頻生成新視頻:

刷新文本視頻生成模型SOTA

其實,Meta的Make-A-Video並不是文本生成視頻(T2V)的首次嘗試。

比如,清華大學和智源在今年早些時候就推出他們自研的“一句話生成視頻”AI:CogVideo,而且這是目前唯一一個開源的T2V模型。

更早之前,GODIVA和微軟的“女媧”也都實現過根據文字描述生成視頻。

不過這一次,Make-A-Video在生成質量上有明顯的提升。

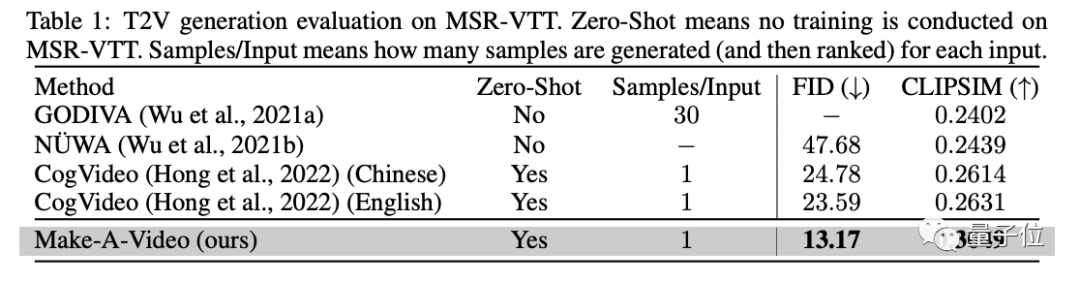

在MSR-VTT數據集上的實驗結果顯示,在FID(13.17)和CLIPSIM(0.3049)兩項指標上,Make-A-Video都大幅刷新SOTA。

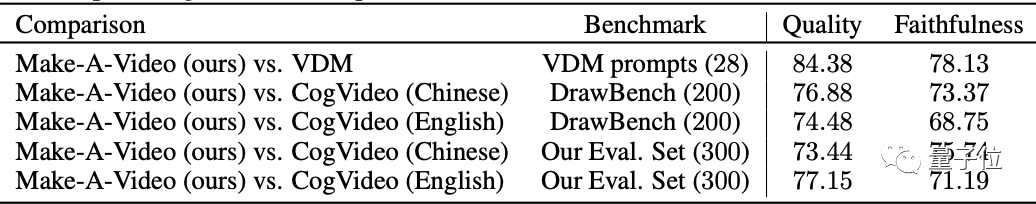

此外,Meta AI的團隊還使用Imagen的DrawBench,進行人為主觀評估。

他們邀請測試者親身體驗Make-A-Video,主觀評估視頻與文本之間的邏輯對應關系。

結果顯示,Make-A-Video在質量和忠實度上都優於其他兩種方法。

One More Thing

有意思的是,Meta發佈新AI的同時,似乎也拉開T2V模型競速的序幕。

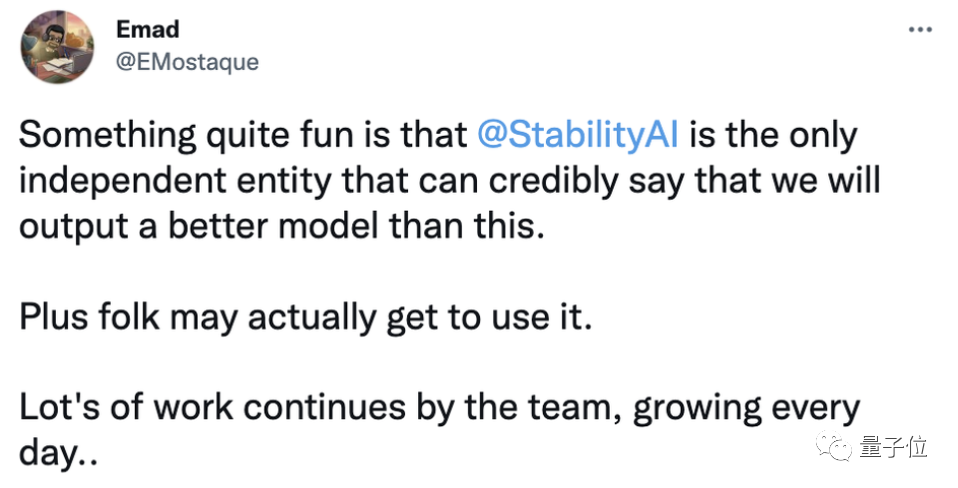

Stable Diffusion的母公司StabilityAI就坐不住,創始人兼CEO Emad放話道:

我們將發佈一個比Make-A-Video更好的模型,大傢都能用的那種!

而就在前幾天,ICLR網站上也出現一篇相關論文Phenaki。

生成效果是這樣的:

對,雖然Make-A-Video尚未公開,但Meta AI官方也表示,準備推出一個Demo讓大傢可以實際上手體驗,感興趣的小夥伴可以蹲一波。