2024年1月16日,在達沃斯世界經濟論壇年會期間舉辦的媒體活動上,奧特曼表示:“我們需要比之前認為的多得多的能源。我對世界的理解是,未來的兩種重要貨幣是智能計算和能源。無論是我們的想象力,還是讓想法變為現實的能力,以及運行計算的能力,都離不開這兩者。我認為我們仍沒有充分意識到這項技術對能源的需求。”

2024年2月29日,馬斯克在博世集團舉辦的的視頻采訪環節上表示:

“AI算力的限制是可預見的,我在一年前就預測到芯片短缺,神經網絡芯片。很容易預測,下一個短缺將是降壓變壓器。如果從電力公司獲得100-300千伏的電力,那麼降壓到6伏會是一個很大的降壓過程。我不那麼好笑的笑話是‘你需要用變壓器來運行(AI)Transformer模型。那麼,下一個短缺將是電力,我認為到明年,將沒有足夠的電力來運行所有的芯片。”

同時,根據《紐約客》雜志的報道:

“OpenAI的ChatGPT聊天機器人每天消耗超過50萬千瓦時的電力,用於處理約2億個用戶請求,相當於美國傢庭每天用電量的1.7萬多倍。”

荷蘭國傢銀行數據科學傢亞歷克斯·德弗裡斯在一篇論文中估計:

“ 到2027年,整個人工智能行業每年的電力與阿根廷、荷蘭和瑞典各自一年的用電量類似。”

如此誇張的描述不禁讓我們好奇,AI真的會帶來大規模的電力短缺嗎?

1. 互聯網泡沫與電力

在20年前互聯網泡沫的時候,我們也曾面臨過這樣的擔憂。

我們找到一篇典型的,1999年5月在福佈斯雜志上發表的一篇文章《Dig more coal -- the PCs are coming》:

“在美國的某個地方,每次在線訂購一本書時都會燃燒一塊煤。

今天,全球年產量為 500 億個集成電路和 2000 億個微處理器,這些芯片中的每一塊都依靠電力運行。

您的個人電腦及其外圍設備需要大約 1000 瓦的功率。IntelliQuest 的一項研究表明,互聯網用戶平均每周在線 12 小時,這種使用意味著一年大約 1000 千瓦小時的電力消耗。

互聯網上至少有 1 億個節點,每年消耗數百至數千千瓦時的電力,加起來有 2900 億千瓦時的需求。這大約是美國總需求的 8%。再加上用於建造和操作獨立的(未聯網的)芯片和計算機的電力,總數躍升至約 13%。現在有理由預測,在未來十年內,一半的電網將為數字-互聯網經濟提供動力。“

2. 比特幣礦機與電力

無獨有偶,當比特幣沖上2萬的時候的2017年,CNBC上也有過一篇對比特幣挖礦帶來巨大電力需求,從而引發的對電力擔憂。

“僅 11 月份,開采比特幣所消耗的能源量就飆升約 26%,目前總計接近 36 TWh,足以為約 330 萬戶傢庭供電。Digiconomist 指出,如果比特幣是一個國傢,這將使比特幣成為第 59 位最大的能源消耗者。

以比特幣挖礦為例,預測如果繼續以目前的速度增長,2019 年比特幣挖礦的用電量將與美國的用電量相匹配,到 2020 年將與全球的總需求相匹配。“

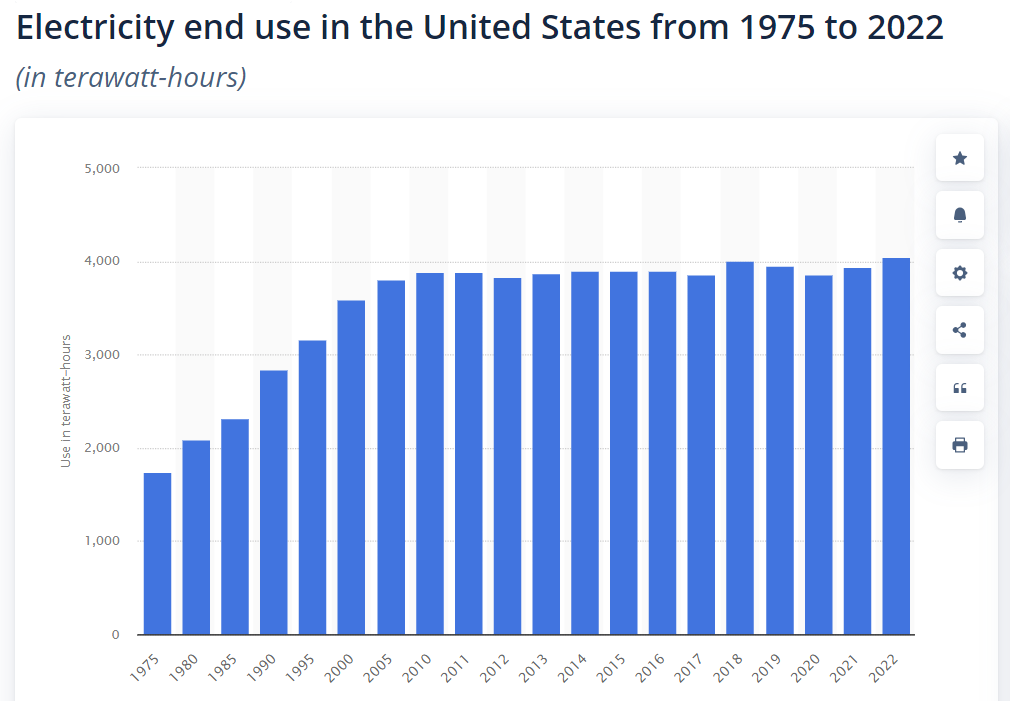

當時,當我們回溯過去這麼多年在我們經歷互聯網泡沫以及互聯網和PC滲透率飽和,以及比特幣接近7萬的今天,美國整體電力的需求依然維持穩定。每一輪新的技術周期發展的過程中,也總有這樣那樣的聲音。

3. AI與算力

回到AI對電力影響的本身,我們回歸數字,先做一個簡單暴力的假設:

1)目前我們大約600萬H100base,假設有2027年我們有2000萬張H100的base(或者說類似H100的算力,暫不考慮新卡的迭代)

2)假設每臺都是8芯片服務器,100%的利用率

3)假設單臺服務器功率10KW

4)假設2027年數據中心的PUE為 1.4

5)假設每臺服務器運行365*24 小時,

那麼總共的電力消耗是307 TWh,這是什麼概念呢?

2023年全球電力消耗,28510 TWh,假設每年以低個位數增長,至2027年,全球AI算力新增電力能源消耗大約占全球的1%。

2023年美國電力消耗,4335 TWh,假設每年以低個位數增長,至2027年,全球AI算力新增電力消耗大約占美國的6.5%。

(當然,這隻是一個靜態的簡單假設,未來應用端會發展成什麼樣帶來多少新增的電力需求,我們先不考慮)

所以,消耗一個阿根廷或者荷蘭一年的電力又怎麼樣呢?電力的本身因為其傳輸性以及其發電種類(天然氣/煤炭/風光)的限制,本就是一個區域性極強的商品,AI Data Center不會隻建在阿根廷或者荷蘭。

那到底是未雨綢繆還是危言聳聽?以及為什麼馬斯克和奧特曼會提出類似的擔憂?

他們擔憂的核心不在於電力消耗問題,而在於美國的電力基礎建設。

4. 美國的電網

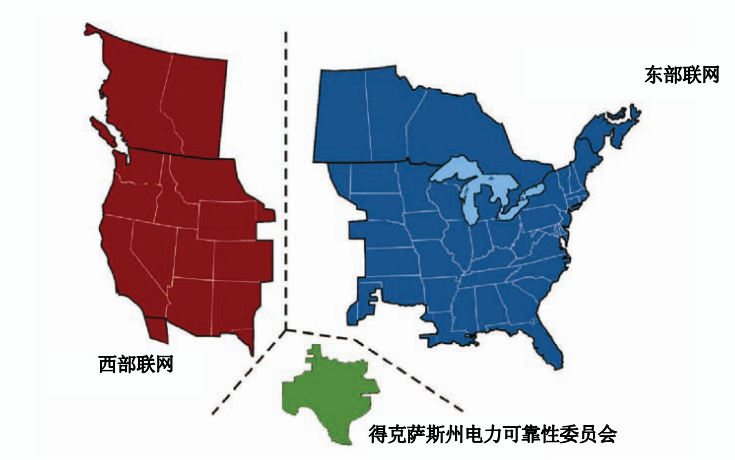

美國本土的電力系統由三個獨立的同步電網組成:東部聯網、西部聯網和得克薩斯州電力可靠性委員會(ERCOT),它們之間僅靠幾條小容量的直流線路相連。這三個電網分別占美國電力銷售 量的 73%、19%和 8%

美國電網目前由約 170 000 英裡的高壓(200kV 以上)輸電線路和相關設備,以及近 6 000 000 英裡的低壓配電線路組成。投資者所有的電力公司擁有整個系統的大約 66%,而聯邦企業則擁有 14%,剩餘部分為其他公共實體(7%)、合作式企業(6%)、獨立 輸電公司(4%)及其他(3%)。美國聯邦能源監管委員會(FERC)擁有整個電力躉售及輸 電價的管轄權。

第一點,陳舊的基礎設施,全球化的後遺癥

美國70%以上的輸電系統已經超過25年的歷史,全國大部分電網都在老化,其中一些部件已經使用超過一個世紀,遠遠超過它們50年的預期壽命。

過去10年建成的輸電線路約68%是在2012年-2016年間建成的,其中2013年建成規模是10年來最多的一年,但也隻有3500英裡。

其背後的核心在於21世紀後的全球制造業分配,以至於美國所需電力投資顯得沒那麼必要。畢竟,占著全球經濟總量17%的中國,其用電量占全球的30%。

所以,在助力制造業回歸美國的過程中,電力投資也是拜登經濟學的重要一環。

而盡管在拜登上臺後,再三敦促跨州電力的投資,但效果甚微,這是為什麼呢?

第二點,跨州建設的難度,聯邦制度的弊端

美國的輸電項目往往需要跨州建設,對於跨州的輸電設施或由聯邦機構管理 的美國 30%的土地而言,成本分攤和選址是 很容易引起爭議的問題。

1935 年聯邦電力法 案使所有輸電線路的選址成為各州而不是聯 邦能源監管委員會(FERC)的事務,跨越由聯邦機構管理的地域的線路需要得到那些機構的許可。因此,跨州輸電設施的建設需要 得到多個州的監管機構,有時還需一個或多個 聯邦機構的許可。但各州關於基建的監管和審批程序不同,導致開工時間不斷拖延。

並且,美國某些州的法律賦予州內土地所有者阻止輸電線路建設的權力,不管是聯邦政府還是聯邦能源監管委員會(FERC)都無法推翻。再加上如果州內出現反對聲音,往往使得規劃好的項目一拖再拖。

2022年建成的典型項目從提出並網請求到商業運營需要5年時間,而2015年為3年,2008年不到2年,連網成本大幅增加。項目互聯協議執行與商業運營日期之間的典型時間間隔也有所增加,從2007年至2014年期間建設的項目的約17個月增加到2015年至2022年期間建設的項目的約22個月。

所以,縱使再多的風光新能源也面臨著發電側和用電側無法匹配的問題,即電力有效傳輸的問題。例如,美國最吸引人的風力資源位於從得克薩斯州經達科他州向北延伸至加拿大邊境的“風帶”。美國太陽能發電主要位於幾乎沒有雲的人口稀少的西南部沙漠。

第三點,效益的不確定性,享受主義的難題

項目開發商面臨巨大的成本不確定性,例如極端天氣、人工,初始研究結果可能與最終成本有很大不同,因為到達設施研究階段(發電機並網協議執行前的最後階段)的項目數量可能遠遠少於集群研究階段早期檢查的項目數量。

並且美國項目完成率非常低,後期退出現象越來越普遍。傳輸升級的范圍和成本的不確定性以及與當前互連過程相關的延長的時間表,通常導致撤回和連續的重新研究。

其他的挑戰包括獲得土地、許可證、社區支持、電力購買者和融資,以及項目經濟和可用政策激勵的意外變化。

所以,以上因素也導致在目前情況下,即便是個位數的電力需求增速,也面臨著電力供應的短缺。在美國,大型變壓器和開關器的訂單交付周期已經延長至半年以上。要知道,一個AI 數據中心的電力需求是普通數據中心的2倍以上,而一個AI 訓練數據中心的電力需求是普通的6倍以上。

我們舉一個德州的例子,到 2027 年,我們預計全美數據中心總容量將增加約 30 GW。德克薩斯州的主要城市約占數據中心總庫存和新增數據中心的 15%。

按比例計算,這意味著到 2027 年,德州將新增 5 GW的數據中心容量,即每年約 1 GW,而這每年1GW的量大約會帶來德州商業批發電價每年5%以上的增速。

同時,疊加除數據中心以外,美國制造業建設的回歸對電力需求的擠占,新能源風光對電力負荷也有更高要求。

而美國的電力供應,會因為基礎建設的瓶頸和效率,而遇到短期的不穩定問題。

這也就是為什麼,馬斯克擔憂的不是電力需求有多麼多麼大,其本質是美國本身的電力供給所遇到的階段性瓶頸,這背後疊加從全球化到區域化過程中需要解決的矛盾,聯邦制度下各州的各自為政,享受主義下勞動力的嚴重短缺,這些都是拜登經濟學背後的隱形成本。

所以,AI的大勢所趨的背景下,聯邦政府低效的執行力匹配不上FOMO大廠的高效執行力,這才催生背後一系列的問題。

順著這一條線,建議關註Data Center的Capex 系列,例如GE/ ETN/ ITRI/ VRT。以及Opex系列,例如電力公司 VST等。

當然,這些都是供給創造需求的一系列股市,那是誰創造供給?還是NV。