與2016年和2020年相比,由於初選季的競爭較少,外國對美國總統選舉的惡意影響起步較慢。俄羅斯的努力主要集中在破壞美國對烏克蘭的支持,而中國方面則試圖利用社會兩極分化,削弱人們對美國民主制度的信心。

此外,人們擔心復雜的人工智能深度偽造視頻會成功操縱選民,但這一擔心尚未得到證實,而較簡單的"淺層"人工智能增強和人工智能音頻偽造內容可能會取得更大成功。這些見解和分析包含在今天發佈的第二份《微軟威脅情報選舉報告》中。

俄羅斯在破壞美國對烏克蘭的支持方面投入巨大

俄羅斯的影響力行動(IO)在過去兩個月中愈演愈烈。微軟威脅分析中心(MTAC)已追蹤到至少有 70 名俄羅斯人員利用傳統媒體和社交媒體以及隱蔽和公開的活動,從事以烏克蘭為重點的虛假信息活動。

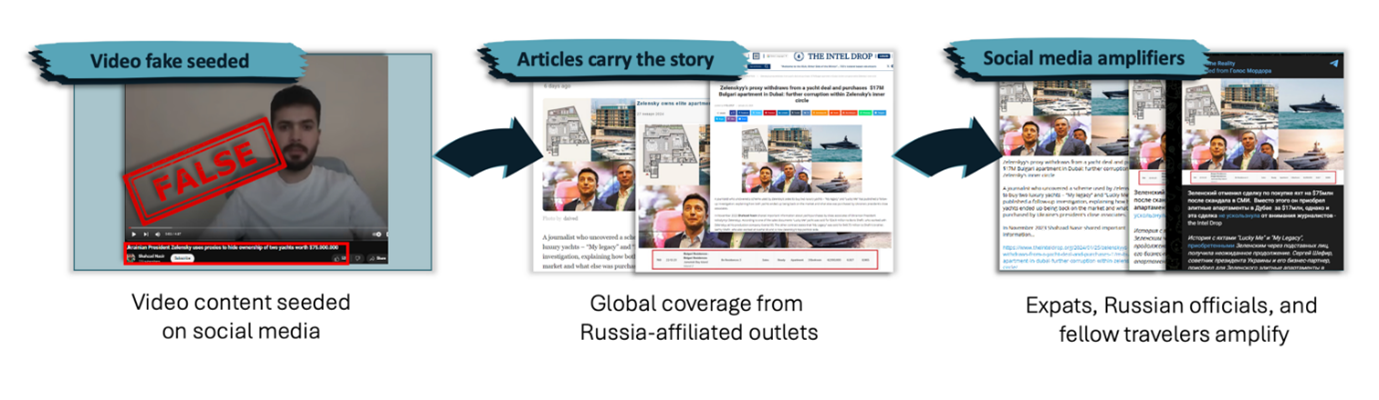

例如,微軟追蹤到的名為 Storm-1516 的行為者使用多種語言的一致模式,成功地向美國受眾洗白反烏克蘭的言論。通常情況下,該組織會遵循三個階段的流程:

個人以舉報人或公民記者的身份出現,在專門建立的視頻頻道上播出敘述內容

然後,一個看似無關聯的全球秘密管理網站網絡對該視頻進行報道

然後,俄羅斯外籍人士、官員和同行者會擴大這種報道。

最終,美國受眾很可能在不知情的情況下重復和轉發這些虛假信息。

圖 1:Storm-1516 向美國受眾空間發送虛假信息的流程

中國試圖擴大社會分歧,破壞美國民主制度

中國在以選舉為重點的活動中采用多層次的方法。它利用現有的社會政治分歧,將其攻擊與黨派利益結合起來,鼓勵這些信息的轉發。

圖 2:與中國有關聯的仿冒賬戶冒充美國選民,發佈以美國大選為主題的內容

中國還在與選舉有關的影響活動中越來越多地使用人工智能,這是它與俄羅斯的不同之處。俄羅斯對人工智能的使用在影響方面不斷發展,而與中國有關聯的行為體則利用人工智能生成技術有效地創建和增強圖像、備忘錄和視頻。

伊朗迄今活動有限,經常在選舉後期攪局

伊朗過去的行為表明,它很可能會在臨近美國大選日時發起嚴重的網絡影響力行動。德黑蘭的選舉幹預戰略采用一種獨特的方法:將網絡和影響力行動結合起來,以產生更大的影響。中東地區持續不斷的沖突可能意味著伊朗將改變其針對美國的計劃目標和行動。

2024 年大選中的生成式人工智能--風險依然存在,但與預期不同

自 2022 年末生成式人工智能民主化以來,許多人擔心這種技術會被用來改變選舉結果。MTAC 與微軟的多個團隊合作,對民族國傢在影響行動中惡意使用生成式人工智能的情況進行識別、分流和分析。

簡而言之,迄今為止,使用世界領導人和候選人的高制作合成深度偽造視頻並未造成大規模欺騙和廣泛混淆。事實上,我們已經看到,受眾更容易傾向於並分享簡單的數字偽造品,而在過去十年中,影響力行動者一直在使用這些數字偽造品。例如,印有真實通訊社標識的虛假新聞報道。

受眾有時確實會被人工智能生成式內容所吸引,不過成功的場景有很大的細微差別。我們今天的報告解釋以下因素如何導致生成式人工智能在 2024 年的選舉中面臨風險:

人工智能增強內容比完全由人工智能生成的內容更具影響力

人工智能音頻比人工智能視頻更具影響力

聲稱來自私人場合的虛假內容(如電話)比來自公共場合的虛假內容(如世界領導人的深度偽造視頻)更有效

在危機和突發新聞期間,虛假信息的傳播更具穿透力

模仿知名度較低的人比模仿世界領導人等知名度很高的人效果更好

隨著 11 月的臨近,我們預計俄羅斯、伊朗和中國都將加快影響和幹擾活動的步伐,因此在選舉日之前,MTAC 將繼續識別和分析惡意使用生成式人工智能的情況,並逐步更新評估。需要特別註意的一點是:如果有一種復雜的深度偽造技術用於影響 11 月的選舉,那麼用於操縱選舉的工具很可能尚未進入市場。幾乎每天都有越來越先進的視頻、音頻和圖像人工智能工具進入市場。上述評估是根據 MTAC 迄今觀察到的情況做出的,但我們很難知道從現在到 11 月,我們會從生成式人工智能中觀察到什麼。

上述評估是根據 MTAC 目前的觀察得出的,但從現在到 11 月,隨著人工智能的發展以及俄羅斯、伊朗和中國地緣政治目標的演變,2024 年大選的風險可能會隨著時間的推移而發生變化。

閱讀原文:

https://blogs.microsoft.com/on-the-issues/2024/04/17/russia-us-election-interference-deepfakes-ai/