6個月掏出3410億參數自研大模型,馬斯克說到做到!就在剛剛,馬斯克的AI創企xAI正式發佈此前備受期待大模型Grok-1,其參數量達到3140億,遠超OpenAIGPT-3.5的1750億。這是迄今參數量最大的開源大語言模型,遵照Apache2.0協議開放模型權重和架構。

Grok-1是一個混合專傢(Mixture-of-Experts,MOE)大模型,這種MOE架構重點在於提高大模型的訓練和推理效率,形象地理解,MOE就像把各個領域的“專傢”集合到一起,遇到任務派發給不同領域的專傢,最後匯總結論,提升效率。決定每個專傢做什麼的是被稱為“門控網絡”的機制。

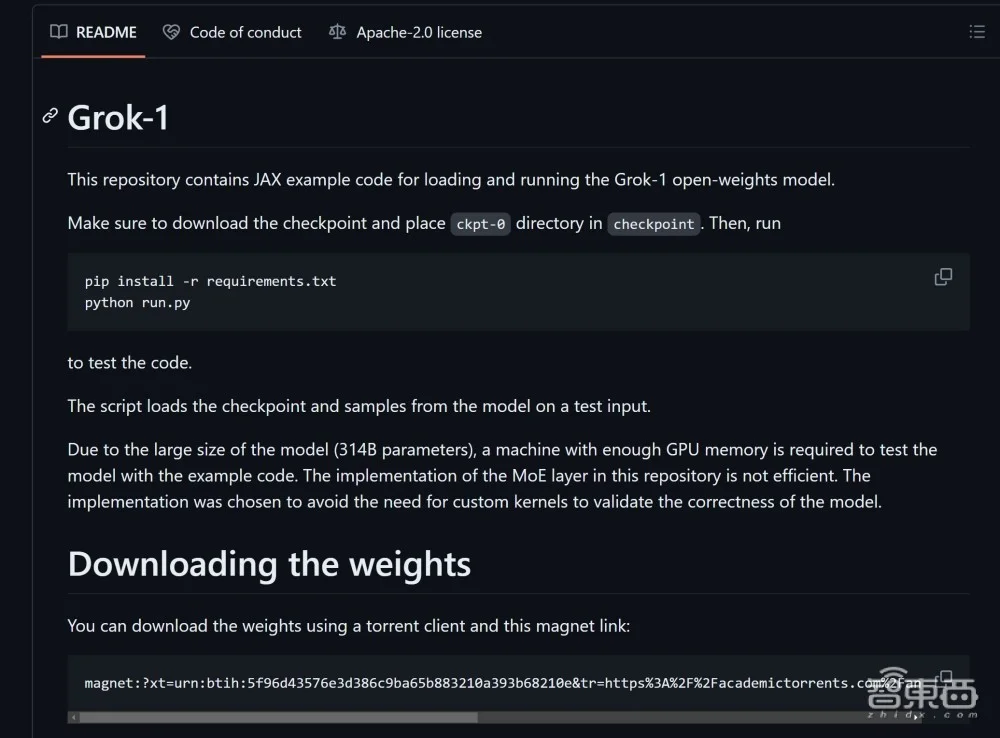

xAI已經將Grok-1的權重和架構在GitHub上開源。

目前Grok-1的源權重數據大小大約為300GB。

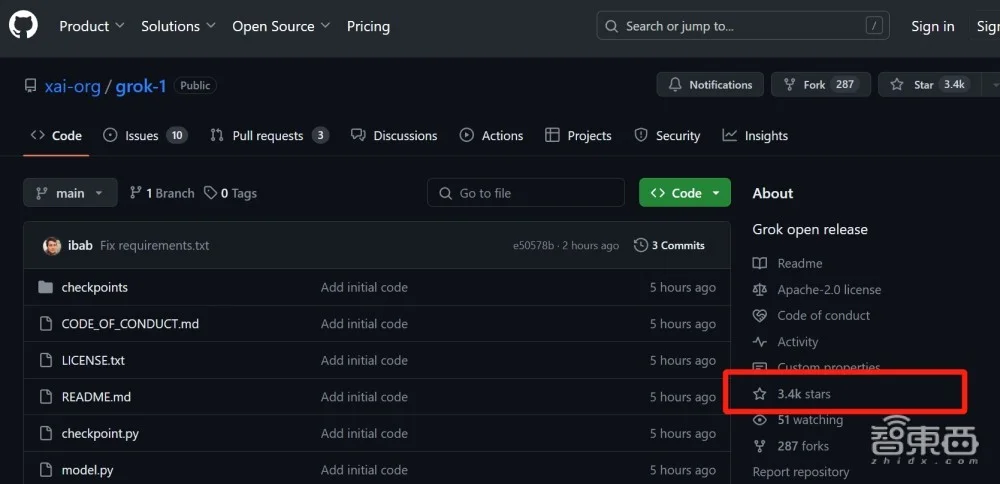

截至北京時間3月18日上午7時許,Grok-1項目收獲3400顆星。

Grok-1是馬斯克xAI自2023年7月12日成立以來發佈的首個自研大模型。xAI特別強調說這是他們自己從頭訓練的大模型。Grok-1沒有針對特定應用進行微調。

xAI是馬斯克去年剛剛成立的明星AI創企,其目的之一就是與OpenAI、Google、微軟等對手在大模型領域進行競爭,其團隊來自OpenAI、GoogleDeepMind、Google研究院、微軟研究院等諸多知名企業和研究機構。

此前馬斯克剛剛“怒噴”OpenAI不夠“Open”,後腳這就開源自傢的頂級3410億參數自研大模型Grok-1。雖然馬斯克在預熱到發佈的過程中也“放幾次鴿子”,但最終他並沒有食言。

今天,xAI還公佈Grok-1的更多細節:

基礎模型基於大量文本數據訓練,未針對特定任務進行微調。

3140億參數的Mixture-of-Experts模型,其對於每個token,活躍權重比例為25%。

xAI從2023年10月開始使用自定義訓練堆棧在JAX和Rust之上從頭開始訓練。

但此次xAI並沒有放出Grok-1的具體測試成績,其與OpenAI即將發佈的GPT-5的大模型王者之戰,必將成為業內關註的焦點。

當然,馬斯克發大模型,怎麼會少的大佬隔空對線“互懟”?

xAI官方消息剛剛發佈,ChatGPT的官方賬號馬上就跟馬斯克在X平臺上進行互動,在Grok官方賬號評論下回復道:“偷我的笑話。”

馬斯克自然不會示弱,馬上說請告訴我OpenAI“Open”之處在哪裡。

馬斯克高仿號也馬上跑過來添油加醋,說我們都知道是Sam在運營ChatGPT的賬號。

值得一提的是,此次xAI發佈Grok-1消息的封面圖片,是由Midjourney生成,Grok給出提示文本:一個神經網絡的3D插圖,具有透明節點和發光連接,展示不同粗細和顏色的連接線的不同權重(A 3D illustration of a neural network, with transparent nodes and glowing connections, showcasing the varying weights as different thicknesses and colors of the connecting lines)。

原圖: