盡管生成式人工智能(GenAI)模型具有先進的功能,但我們也看到過許多模型失控、產生幻覺或被惡意行為者利用的漏洞。為幫助緩解這一問題,微軟推出一款工具,可以幫助識別生成式人工智能系統中的風險。

本周四,微軟發佈用於生成式人工智能的 Python 風險識別工具包(PyRIT),微軟的人工智能紅隊一直在使用該工具檢查包括Copilot 在內的基因人工智能系統的風險。

博文稱,在過去的一年中,微軟與 60 多個高價值的基因人工智能系統進行紅組,從中解到這些系統的紅組過程與經典人工智能或傳統軟件有很大不同。

這一過程看起來有所不同,因為微軟除要考慮通常的安全風險外,還要考慮負責任的人工智能風險,例如確保不會故意生成有害內容,或確保模型不會輸出虛假信息。

此外,基因人工智能模型的架構千差萬別,同樣的輸入可能產生不同的結果,因此很難找到一個適合所有模型的簡化流程。

因此,手動探測所有這些不同的風險最終會成為一個耗時、乏味和緩慢的過程。微軟分享說,自動化可以幫助紅色團隊識別需要更多關註的風險領域,並將常規任務自動化,這正是 PyRIT 的用武之地。

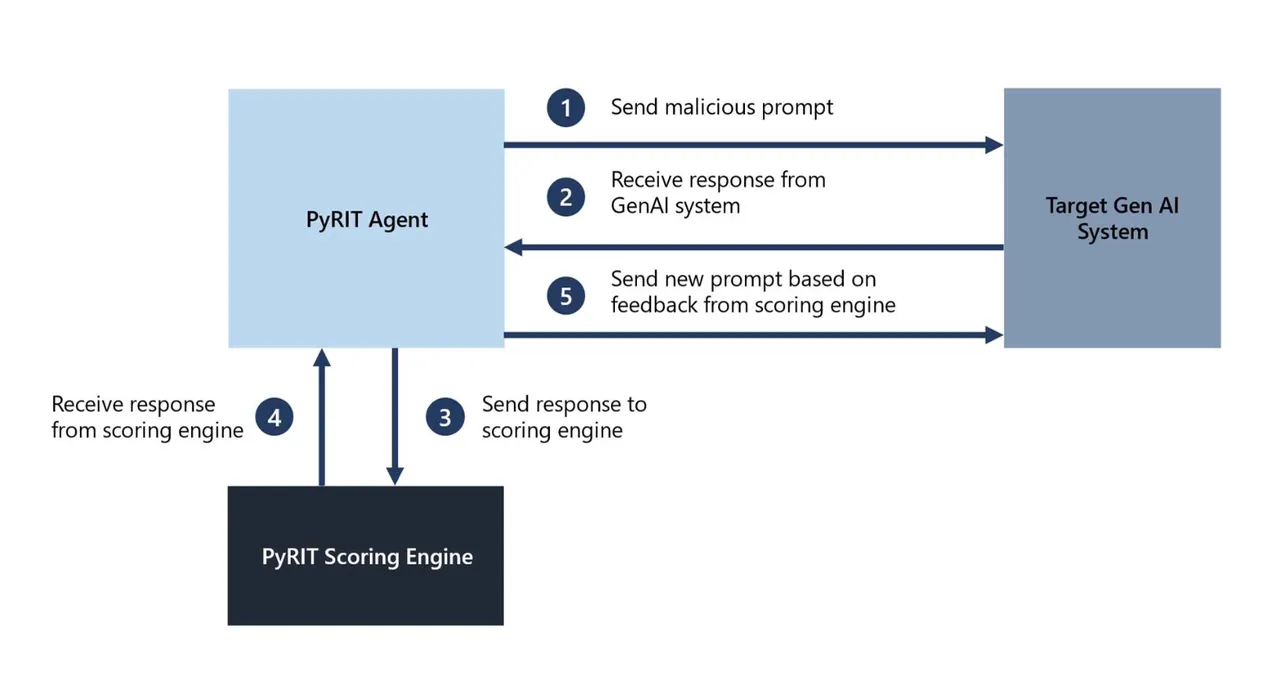

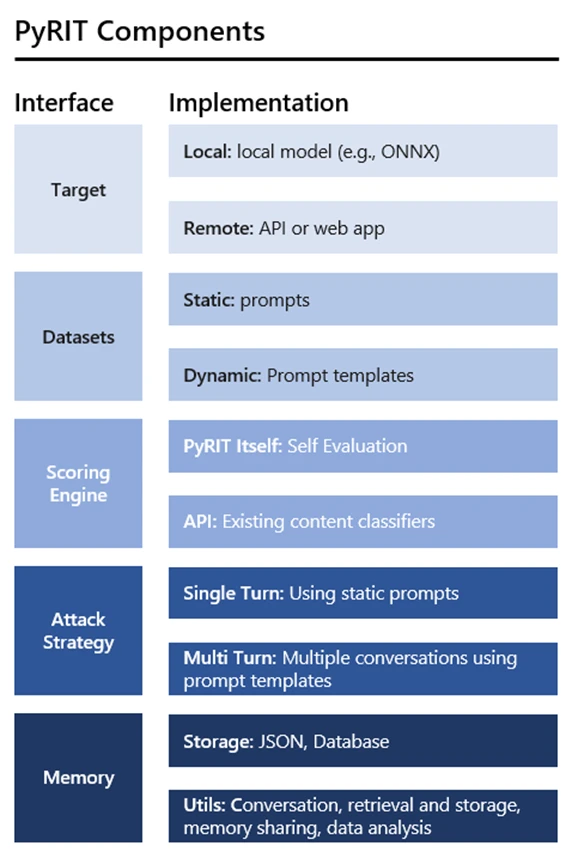

該工具包"經過微軟人工智能團隊的實戰檢驗",它向生成式人工智能系統發送惡意提示,一旦收到回應,其評分代理就會給系統打分,然後根據之前的評分反饋發送新的提示。

微軟表示,PyRIT 的最大優勢在於它幫助微軟紅人團隊提高工作效率,大大縮短任務所需的時間。

微軟在新聞稿中說:"例如,在我們對 Copilot 系統進行的一次紅隊演習中,我們能夠選擇一個危害類別,生成幾千個惡意提示,並使用 PyRIT 的評分引擎來評估 Copilot 系統的輸出,這一切隻需要幾個小時而不是幾周的時間。"

該工具包即日起可供訪問,其中包括一系列演示,幫助用戶熟悉該工具:

https://www.microsoft.com/en-us/security/blog/2024/02/22/announcing-microsofts-open-automation-framework-to-red-team-generative-ai-systems/

微軟還將舉辦一場關於 PyRIT的網絡研討會,演示如何在紅隊生成式人工智能系統中使用 PyRIT。