ChatGPT這樣的生成式AI不僅需要千億級的大模型,同時還需要有龐大的算力基礎,訓練AI現在主要依賴NVIDIA的AI加速卡,達到ChatGPT這種級別的至少需要1萬張A100加速卡。高性能加速顯卡現在是稀缺資源,國內購買NVIDIA高端顯卡更是不容易,來自商湯科技的一份紀要顯示,能達到ChatGPT這種算力要求的公司在國內鳳毛麟角,隻有6傢。

他們是商湯、百度、騰訊、字節、阿裡和幻方,其中百度、騰訊、字節、阿裡這樣的互聯網巨頭能買到且買得起1萬張A100顯卡不讓人意外。

百度3月底已經發佈自己對標ChatGPT的產品文心一言,接下來其他公司也會陸續發佈自己的AI產品。

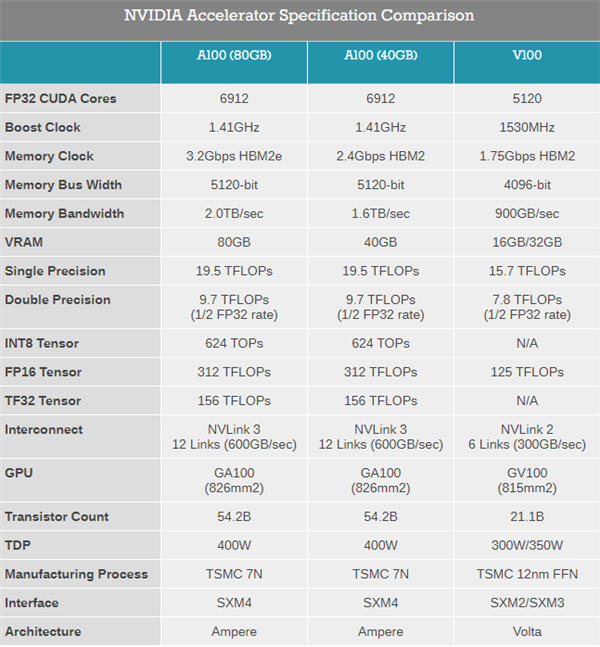

NVIDIA A100核心及計算卡是2020年5月份發佈的,也是安培架構的第一款產品,7nm工藝制造,542億個晶體管,826平方毫米面積,8196個流處理器,實際開啟6912個,搭配5120-bit 40GB HBM2顯存,PCIe版本功耗250W。

A100的單精度浮點性能高達19.5TFlops,FP64性能9.7TFLOPS,INT8性能624TOPS,TDP 400W,顯存的帶寬也是恐怖的1.6TB/s,後期還發佈過80GB HBM2e的版本,頻率從2.4Gbps提升到3.2Gbps,使得帶寬從1.6TB/s提升到2TB/s。