ChatGPT居然這麼費電?最新的等式出現:ChatGPT日耗電量≈1.7萬傢庭日耗電量。什麼概念?一年光電費就要花2億!美國普通傢庭平均單日用電29千瓦時,而ChatGPT的單日用電量超過50萬千瓦時。(美國商業用電一度約為0.147美元也就是1.06元,相當於一天53萬元)消息一出就直接沖上熱搜第一。

除OpenAI,Google也“不容小覷”:

在Google搜索中應用生成式AI技術,Google每年的耗電量將高達290億千瓦時,也就是每天約7900萬度(?)。

而在未來,AI這一“吃電巨獸”的食量還會更驚人。

數據統計:

到2027年,人工智能數據中心的用電量將和荷蘭、瑞典等小國用電量相當。

有網友看完表示:

這是利好光伏和風電?

所以AI最後拼的是誰發電多、誰發電成本低?

AI要耗多少電?

如上數據來自一篇論文《The growing energy footprint of artificial intelligence》。

作者是荷蘭數字經濟學傢Alex de Vries,他通過英偉達、OpenAI、Google等公開數據進行估算。

結果就得出很多意想不到的結論。

首先,現在大模型訓練時期的耗電量和推理階段相比,已經不值一提。

SemiAnalysis數據顯示,OpenAI需要3617臺英偉達HGX A100、共28936個GPU來支持ChatGPT推理。

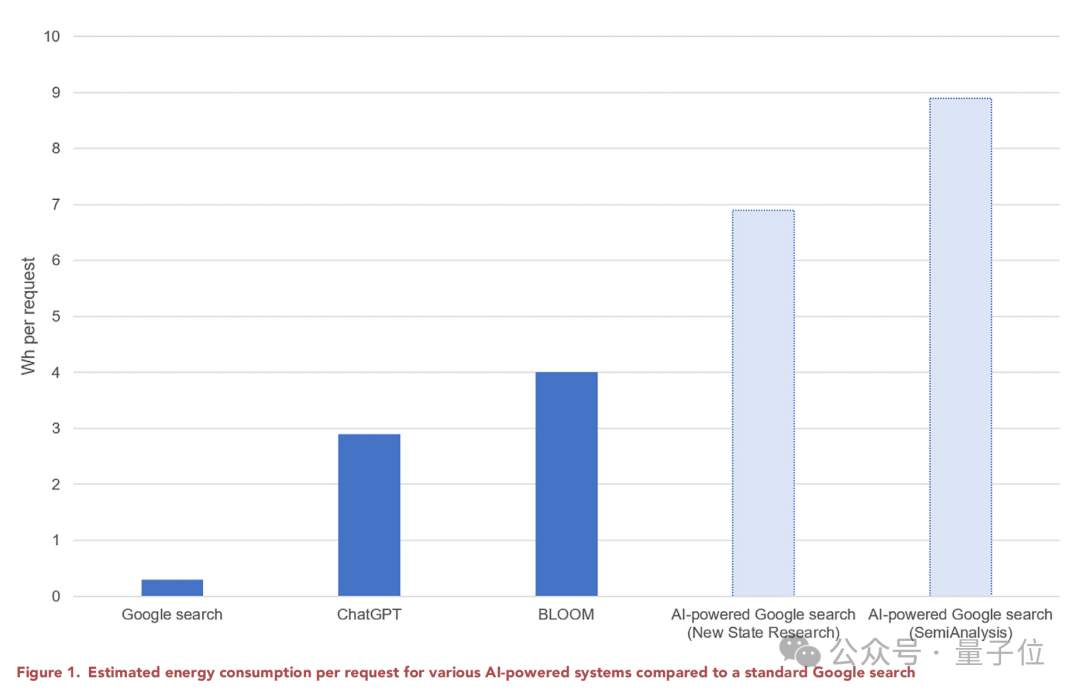

ChatGPT每天需要響應1.95億次請求,預計每天需要消耗564兆瓦時電力,每個請求大約2.9瓦時。

而GPT-3整個訓練階段的耗電量預估為1287兆瓦時,是ChatGPT大約4天的消耗量。

Google報告也表示,2019-2021年,與人工智能相關的能源消耗中有60%來自推理部分。

因此論文提出未來研究AI用電量時,更應該從全周期角度考量。

但這也與模型再訓練頻率、模型性能與功耗之間的平衡有關系。比如BLOOM在推理階段的耗電量就顯著降低。

其次,搜索引擎如果用上AI,耗電量還會更高。

Google方面曾在去年2月表示,AI響應請求的成本可能是普通搜索的10倍。

數據顯示,使用一次Google搜索消耗的電量是0.3瓦時。這和上面分析給出的數據相呼應。

如果要將大模型能力植入到Google搜索中,預計需要512821個HGX A100,按照每臺設備功耗為6.5千瓦來計算,每天將需要80吉瓦時的電力消耗,一年需要29.2太瓦時。

目前Google每天需要處理高達90億次搜索,換算一下,平均每個請求要消耗6.9-8.9瓦時,已經是普通搜索的20倍+。

同樣的現象在英偉達的財報數據中也可以看到。

去年第二季度,英偉達收入創紀錄,其中數據中心部門較上季度相比增長141%,這表示AI方面的需求擴增。

今年,英偉達AI服務器出貨量可能達到150萬臺,總功耗可能達到9.75-15.3吉瓦。這一數量級的服務器,每年的用電量將達到85.4-134太瓦時。

不過AI用電量會一路飆升嗎?

研究認為也不一定。

哪怕像Google這樣在全球擁有數十億用戶的廠商,也會慎重考慮AI與搜索引擎的融合。硬件、軟件和電力成本壓力下,廠商腳步或許沒那麼快。

硬件生產本身還受到掣肘,AI熱潮使得臺積電CoWoS先進封裝產能吃緊,但新建工廠真正可能開始批量生產要等到2027年,這或許也會影響英偉達的出貨量。

以及模型本身的算法和架構也會讓AI功耗在一定程度上降低。

最終研究認為,關於AI用電量的問題,過於悲觀或樂觀都不可取。

短期內,在各種資源因素影響下,AI用電量增速會被抑制;但硬件和軟件的能效提高,顯然也無法抵消長期的電力需求增長。

總之,作者認為在AI開發方面,還是不要鋪張浪費的好。監管機構也需要考慮要求廠商披露相關數據,提高整個AI供應鏈的透明度,從而更好解這一新興技術的環境成本。

實際上,此前關於AI消耗資源的話題已經多次引發討論。

有研究指出,到2027年,數據中心人工智能的用電量將與荷蘭或瑞典等小國的用電量相當。

加州大學河濱分校研究表明,問ChatGPT5-50個問題,就可消耗500毫升水。

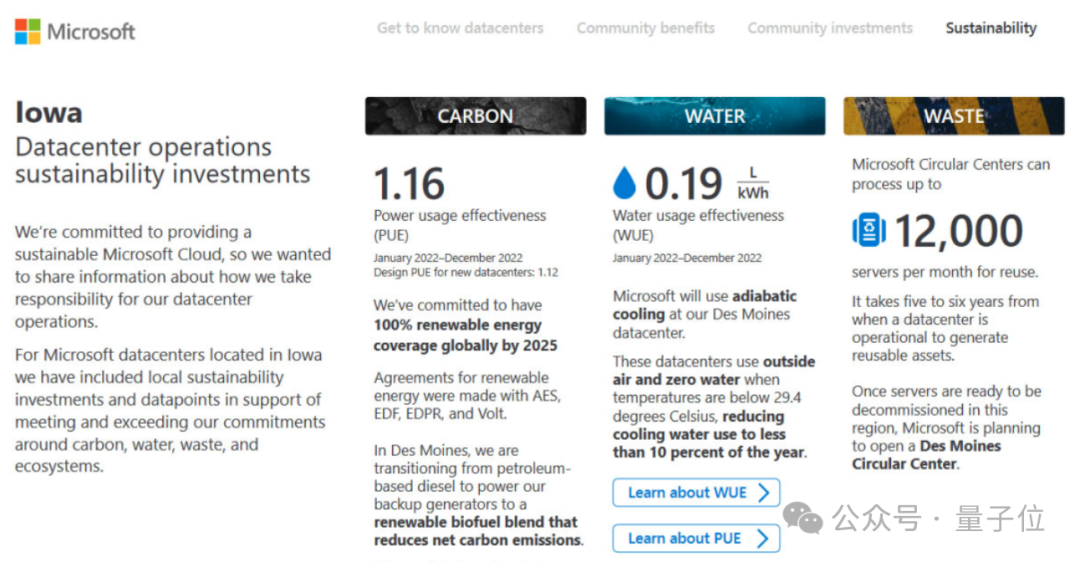

因為AI超算數據中心需要大量水來散熱,微軟也承認用水是訓練模型的一大成本,從2021年到2022年,其全球用水量飆升34%,相比研究AIGC前急劇增加。

網友:也要看產出

除微博,#ChatGPT日耗電超50萬度#的消息也在知乎沖上熱榜第三。

盡管這一數據看起來驚人,但不少網友都表示:

我們還是需要比較一下投入產出。

知乎網友@段小草就淺算一下:

一天50萬度電,1.7萬個美國傢庭。但美國有1.2億個傢庭,也就是隻需萬分之一的傢庭用電,就能支撐一個服務全球TOP 1的AI產品、服務幾億用戶,這還是在浪費能源破壞環境嗎?

言外之意,如下所說(來自知乎網友@桔個仔):

ChatGPT創造的價值其實遠超它的能耗。

和某些技術(咳咳,懂得都懂)的耗電量相比,它可能更不值一提。

所以,有人(知乎網友@玩吾傷智)直接就表示,這則消息應該這麼理解:

震驚, 隻需要1.7萬普通傢庭的電量即可滿足ChatGPT的一日用電需求。(手動狗頭)

咳咳,有意思的是,上面的答主@段小草還提到一篇論文,題為《The Carbon Emissions of Writing and lllustrating Are Lower for Al than for Humans》,講的是AI在畫畫和寫作上的碳排放量一個比人類少310到2900倍,一個比人類少130到1500倍。

這樣看來,AI甚至算得上“節能減排的先鋒”。(手動狗頭)

吶,我們還是早點洗洗睡、關註GPT-5什麼時候發吧。

奧特曼:我們需要可控核聚變

話又說回來,盡管比起收益,ChatGPT一日1.7萬個傢庭的能耗還不值一提,但AI能耗確實也是一個值得關註的問題。

而這點,奧特曼早就在“擔憂”。

在今年1月的一場達沃斯會議中,他就表示:

人工智能的未來取決於清潔能源的突破。

△ 圖源Digwatch

具體而言,他認為:

隨著技術越來越成熟,AI將消耗越來越大量的電力,如果能源技術無法突破,就無法實現這一目標(即讓AI技術釋放全部潛力)。

而現在,公眾還不是很解這個需求究竟有多大,奧特曼本人表示也遠超他的預期。

至於如何提升能源產量,他也直言:

需要可控核聚變,或者更便宜的太陽能及存儲等等。

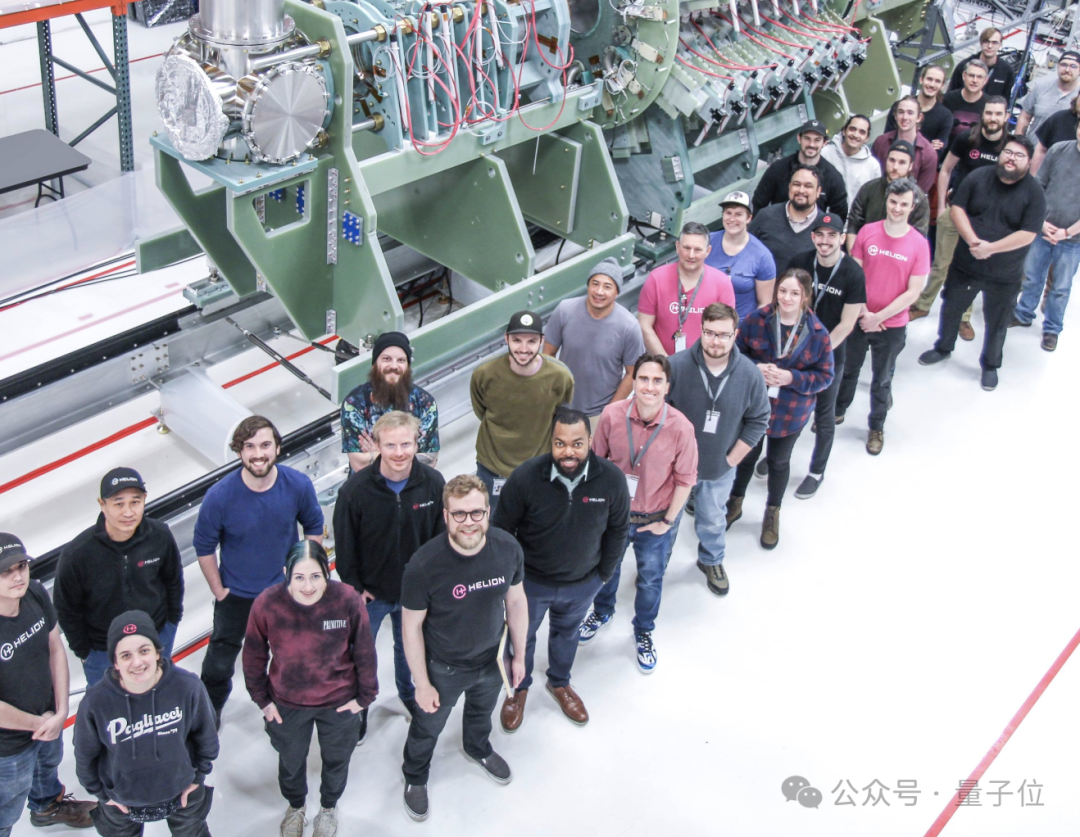

——說起可控核聚變,奧特曼其實早就押註一傢相關公司,名叫Helion。

他在它身上投資3.75億美元,這是他以個人名義投資的最大一筆。

除此之外,奧特曼的“爸爸”微軟也押註這傢公司。

據解,Helion成立於2013年,目前約150+員工。他們預計將在2028年上線50兆瓦規模的可控核聚變發電項目,微軟將率先采購。

原報告:

https://www.cell.com/joule/abstract/S2542-4351(23)00365-3

參考鏈接:

[1]https://weibo.com/1642634100/O4lb78n3U?refer_flag=1001030103_

[2]https://www.businessinsider.com/chatgpt-uses-17-thousand-times-more-electricity-than-us-household-2024-3

[3]https://www.newyorker.com/news/daily-comment/the-obscene-energy-demands-of-ai

[4]https://www.theverge.com/2024/1/19/24044070/sam-altman-says-the-future-of-ai-depends-on-breakthroughs-in-clean-energy

[5]https://www.zhihu.com/question/647926823