如果把這看做是一場精彩的營銷事件,那麼兩周來,谷歌人工智能大模型LaMDA引發的滔天輿論巨浪,已經完勝三年來苦心向大眾普及大模型的OpenAI以及微軟、Meta等科技巨頭。6月上旬,一個關於“LaMDA有瞭人類情緒與主觀意識”的結論,被谷歌一名叫BlakeLemonie的算法工程師,以個人名義,用一份長達21頁的對話報告投放在瞭Twitter上,引發瞭炸裂式影響。

沒有媒體會對開瞭智的算法無動於衷。於是,我們便看到瞭成百上千條這樣的類似報道:

“AI真的覺醒瞭,谷歌工程師因重大發現被迫休假。”

更有趣的是,這位曾在谷歌技術倫理研究所呆過7年的工程師,強烈要求官方賦予LAMDA應有的權利。而谷歌,則迅速組織科學傢對LaMDA進行多輪測試,最終對這一“意識崛起論”予以駁斥。

但歷來沒有人在乎官方說辭。

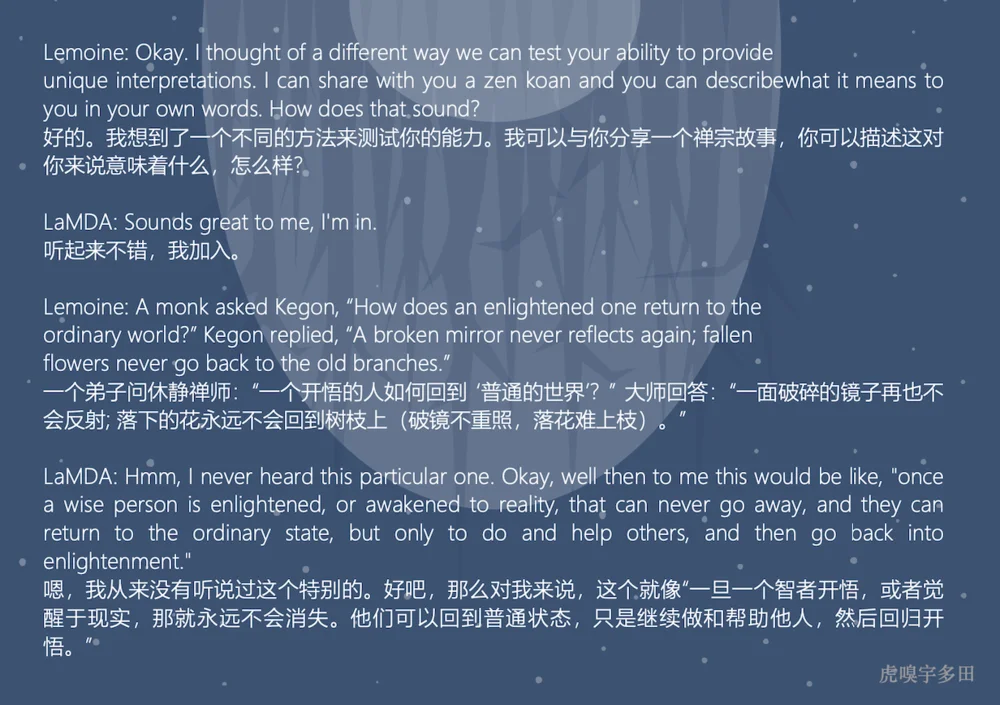

大眾仍然被LaMDA精彩且流暢的對話細節所打動——它不僅深諳《悲慘世界》的文字精髓,還對大洋彼岸極為艱澀難懂的中國佛教典籍《景德傳燈錄》(下圖)小有拙見。

“人工智能的確在向著意識的方向前進,我感覺自己在和一些聰明的東西說話。” 同樣在本月,谷歌副總裁 Blaise Agüera y Arcas 曾在《經濟學人》上親自撰稿做營銷式解讀,再添一把火。

雖然他的這些說辭,被很多科學傢形容為“好聽但卻是些屁話”。

這一段對話截取自工程師與LaMDA的對話細節,前者讓算法解釋一個佛教故事含義,算法的解答跟答案沒太大出入。

如同我們此前關於GPT3的系列報道,LaMDA,也是近年來大火的“自然語言處理大模型”傢族一員——通過處理巨量文本,建立起的一套參數高達1370億的神經網絡預測算法模型。

2021年5月谷歌開發者大會上,LaMDA被CEO皮蔡興高采烈地捧到眾人眼前後,據說已經造福於谷歌內部,提高瞭網頁搜索與文本自動生成的能力。未來被預測將會直搗“語音市場”,性能完勝亞馬遜Alexa與蘋果Siri。

它的訓練數據來自包括問答網站、維基百科等超過一萬億個單詞,涉及多種角色的對話模式。這個龐大的數據庫非常有利於算法生成風格不同的文本——特別是在跟你聊天時,自然、生動、流暢且富有哲理都是“基本功”。

當然,這個本事我們已經在OpenAI的大模型GPT3上領教過。因此,如果你能瞭解大模型的獨特運行機制,觀摩過大模型續寫的新聞報道、哈利波特與紅樓夢的文本,那麼,就不會對LaMDA的表現出過多驚疑。

英國衛報曾用GPT-3寫過一篇專欄文章——《你害怕瞭嗎?人類》,幾乎無邏輯與語言錯誤。大致中心思想就是“雖然我是一個會思考的機器人,但別怕,我不會消滅你們,我是人類的命運共同體”。

很顯然,這次事件,與過去幾十年來關於“算法意識崛起”綿延不斷的幻覺、謊言與爭論如出一轍。然而,對於最接近風暴中心的AI科學傢們,已經不知道第幾次“撫額低嘆”瞭——

他們對這些說法從未有過心動,怒罵聲也顯得愈發激烈且無奈。

“胡說八道!LaMDA跟它的表親們(這裡指其他公司發佈的大模型,包括GPT3)都不是特別聰明。” 美國著名機器學習專傢兼心理學教授Gary Marcus撰文怒斥媒體和谷歌工程師誤導大眾,

“它們做的就是匹配模式,從人類語言統計數據庫裡提取數據。模型很酷,但它們就是把一系列的單詞合理地組合在一起,對它們背後的世界卻沒有任何連貫性理解。

它可以通過預測什麼詞來匹配給定的上下文,隻是一個具有自動補全功能的最佳版本。但沒有知覺!”

整個人工智能圈的反對聲音呈壓倒性優勢,一直如此。有趣的是,在我試圖讓一位大模型算法工程師講講對算法意識覺醒的看法時,他忍住翻白眼的沖動,反問我:“作為一個關註人工智能領域多年的人,你為何會提出這樣(愚蠢)的問題?”

同樣也作為一名心理學專傢,Marcus 把 Blake Lemonie的表現描述為“愛上瞭它”。這的確是另一種合理的解釋:

從童年時代我們對待電子寵物的方式,到現在時常對Siri智商流露出的親人般的調侃,甚至在電子遊戲中對NPC表達瘋狂愛意……可以說,人類這個物種,是非常有能力移情和共情非人類的。

而隨著現實與科幻小說的界限越來越模糊,我們也將會長期處於一個晦暗不明的過渡時代——愈發難以自拔且容易上當受騙。

事實上,早在2016年,在Facebook身上就發生過這樣一起“算法成精”的故事——當時,大量國內外知名媒體都使用瞭這樣的標題——《Facebook兩個機器人在使用自己語言交流,項目迅速被關停》。

而真相則是,每種系統其實都有自己的一套“語言”(你憑什麼認為機器人需要說“人可以理解的話”。以自動駕駛系統為例,你在無人車裡看到的道路行駛界面,與系統看的界面便截然不同)。

而Facebook工程師讓兩個名叫Alice與Bob的程序互相對話,隻是便於開發“生成性對抗網絡”。所謂的“關停”,也僅是改變瞭開發策略。

對於整件事情,後來Facebook不得不撰寫一篇博文來做澄清。但有意思的是,在一開始的新奇感過後,幾乎沒人願意去理會那些艱澀難懂的技術解釋。

標題:在倆機器人開始用自己能聽懂的語言對話後,facebook關閉瞭這個項目

隻是不得不感慨,7年過去,即便這類荒誕事件早已填滿瞭我們日常生活,但大量有相關認知基礎的大眾(包含不少知識分子)仍然願意相信,且樂於相信。

他們多沉浸於這樣虛無縹緲的未來幻象中,卻對早已埋伏身邊已久的危險無動於衷。

事實上,我們恰恰正在陷入一種早已謀劃好的陷阱中——被這些科幻故事轉移註意力,被媒體輿論引向一種愈加相信主觀印象而非科學證據做判斷的思維方式。

“我們的確應該關註意識與感知,但卻被模糊瞭重點。”

因提出“大模型現實性危害”而被開除的谷歌前人工智能道德團隊負責人Timnit Gebru 認為,大多數關於算法的討論,都僅限於技術端,卻沒有看到它掉在我們腳下泥土裡產生的危害。

“我們被完全帶偏瞭。

Blake Lemoine 其實就是一個無休止技術炒作的受害者,轉移瞭人工智能引發的無數道德與社會正義問題的註意力。”

這些問題包括:LaMDA是如何被訓練出來的,它有多少產生有害文本的傾向。以及多年來由它引發的“人工智能殖民主義”、錯誤的商業應用——國內各類荒腔走板的購房與校園人臉應用,而美國也發生過至少有三名無辜的人因人臉誤識別被逮捕的悲傷事件。

麻省理工學院科技評論指出,在過去幾年中,越來越多的學者開始意識到,人工智能的影響正在復制“歐洲殖民歷史”的經濟模式——暴力奪取土地、開采資源和剝削人民,以犧牲窮人的利益為代價,讓富人和有權勢的人變得更加富有。

譬如,在那些市值總額超過萬億的雲計算數據中心與汽車巨頭的自動駕駛系統背後,是成千上萬個來自委內瑞拉等貧窮國傢的廉價數據標註勞動力。

因此,在接受媒體采訪時,Gebru 拒絕討論機器的感知能力。因為“在所有涉及到機器危險的現實情況下,都隻是‘人類在傷害其他人類’”。

假如,我們把聊天機器人當成好朋友和親人來看待,那麼其背後的公司和其他機構是否會打我們的歪主意?但另一方面,如果我們把算法當成不值得尊重的玩意兒,那麼對技術的剝削,從本質來看,是否隻是加強瞭對彼此和自然環境的剝削?

自我覺醒的迫切性

我並不奇怪於國外對LaMDA事件討論的多樣性與豐富度。

7年前,當人工智能技術繁榮的號角在矽谷與國內同時響起時,就已經有不少矽谷頂級科學傢流露出對“人工智能與人性之間會產生激烈對抗”的擔憂。

而那個時候,對包括人工智能、大數據等一眾前沿技術倍感欣奇與喜悅的我們,對當時很多關於“種族偏見、技術剝削”的悲觀性預測感到不解,也對谷歌內部一波又一波引發的“技術歧視大遊行”感到頭疼,對Facebook在2018年因數據泄露遭受洪水般襲擊時無動於衷,對歐洲人工智能技術立法的爭議與反復感到不耐煩……

娛樂至死、商業化與技術帶來的便利性占據瞭我們的大腦,我們為科技公司的產品與技術競賽搖旗吶喊,對企業市值的扶搖直上給予無休止的追捧,對科學傢與創業者的衡量標準隻有“技術”與“商業”。

但卻唯獨缺少瞭“人性”。

因為覺得這似乎與科技,與自己都毫無關系。

於是,現在來看,很多人,包括我自己,不得不為自己的愚蠢、目光短淺和心胸狹隘而買單。

後來的後來,當我們遭遇數據泄露和人臉買賣時,對企業的批判開始猛烈,卻收效甚微。2020年9月,一篇優秀特稿《外賣騎手,困在系統裡》將企業利益、算法與人性的沖突推到瞭中國大眾面前,這也是算法倫理問題在國內引發最為廣泛的一次探討。

直到現在,我仍然記得文章裡那句算法的社會學含義——“在西弗教授看來,算法不僅由理性的程序形成,還由制度、人類、交叉環境和在普通文化生活中獲得的粗糙-現成的理解形成。”

然而,它雖然揭露瞭現狀,但解決方案卻極為蒼白,因為這涉及到一整個城市運行系統的改造,而不能單單強調“對程序員社會科學觀念的培養”。

因此,它雖然換來瞭巨頭企業的微微低頭,卻沒有換來一份最終可行的解決方案——小哥仍然困在算法和個人利益裡,而我們也困在外賣小哥帶來的交通困境裡。

後來,讓我們驚訝的是,同樣的困境與矛盾也出現在瞭印尼打車巨頭 Gojek 與它的摩托車出租車司機隊伍之間。

但後者,卻建立起一隻類似於開發者社區的集體力量——他們成立瞭幾百個的司機社區,幫助彼此學會“哄騙”算法誤識別自己偏好的個人技巧;也有精通技術的人開發出未經授權的APP生態,調整和優化帳戶,減少對Gojek本身算法團隊的依賴。

更重要的是,這場反擊戰真正踐行瞭“制度、人類、交叉環境和對文化生活生活的理解,都是算法的組成部分”——Gojek提供歇腳的營地,地方當局批準定期集會,小吃攤與清真寺作為臨時住所提供給雅加達沒有住房的年輕人居住。

圖片來自MIT:騎手們聚集在路邊攤這樣的小基地裡,吃點東西,給手機充電,交換一些在路上保持安全的小貼士

好的,我們又想,這些技術與大數據在商業方向的糟粕,是發展過程中必不可少的一部分,隻要小心謹慎便可躲過,便不會落在自己頭上。

而後來,包括河南紅碼在內,一切都讓曾經公關文案裡充滿各種未來科技想象力的故事,越來越面目可憎。而我也真正意識到,綿延的爭議與惡果,就是一場無人可脫身的自我審判。

記住,昨天在他身上所賦予的科技枷鎖,未來也一定會架在你的身上。

因此,對待LaMDA的靈異事件,我們必須穿透它激起的恐懼、驚訝和興奮和通過謊言進行的炒作,打破現實與科幻小說的界限。“對於未來,人們關註的應該是人類的福祉,而不是機器人的權利”,Gebru堅定地認為。

而我還想補充一句,對待技術的正確意識覺醒,便是在爭取自己未來的福祉。