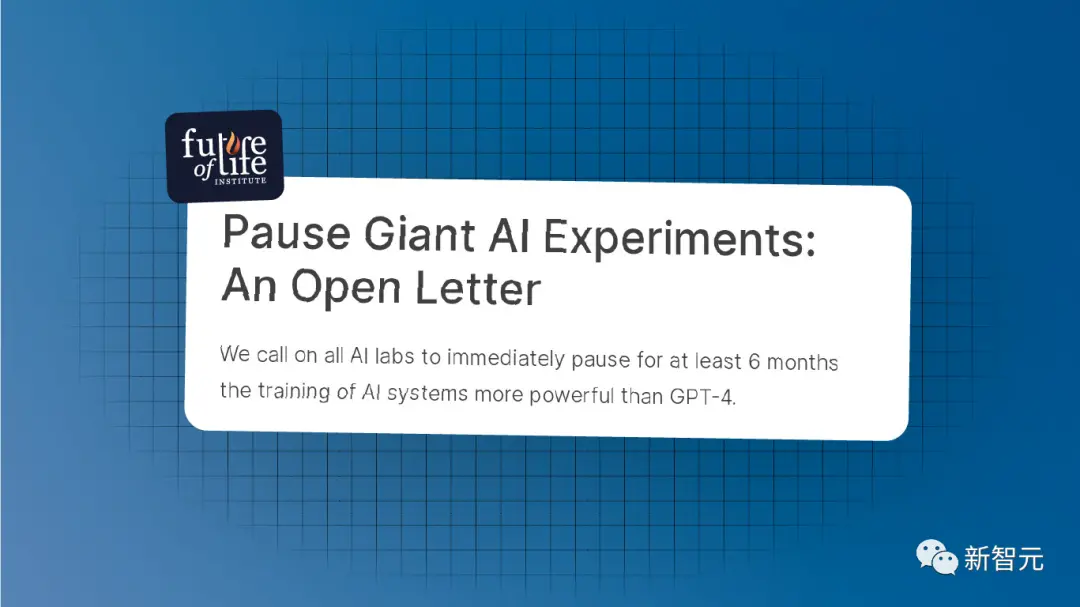

GPT-4強到發指,不止群眾們恐慌,今天,全世界的AI大佬們也出手!千人發表聯名信,呼籲所有人暫停訓練比GPT-4更強的AI。就在剛剛,網上曝出一封千位大佬的聯名信,要封殺所有比GPT-4強的AI!

在這封聯名信上,超過1000位大佬呼籲——我們應該立即停止訓練比GPT-4更強大的AI系統,暫停期至少6個月。

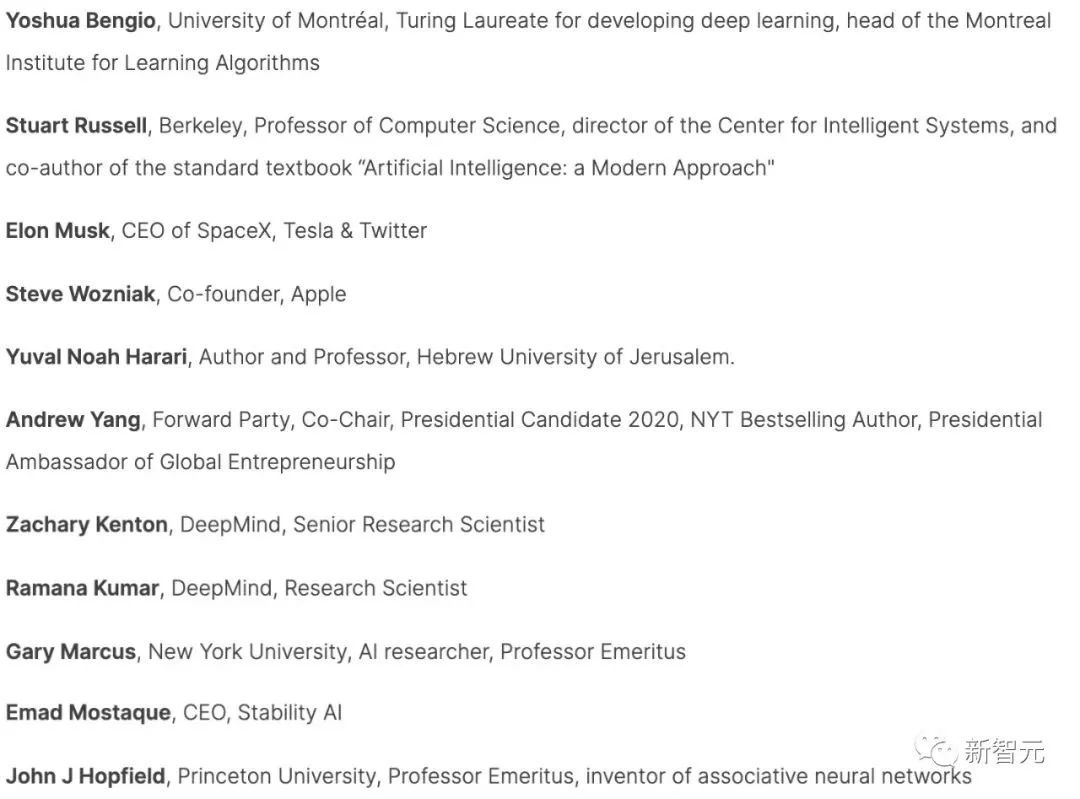

目前簽名的有,圖靈獎得主Yoshua Bengio、Stability AI首席執行官Emad Mostaque、蘋果聯合創始人Steve Wozniak、紐約大學教授馬庫斯、馬斯克,以及“人類簡史”作者Yuval Noah Harari等等。

看看這根本看不到頭的簽名,大佬含量過高。

能夠集齊一千多位大佬的簽名,想必這項聯名已經準備多時。

不過,同樣作為圖靈獎得主的Yann LeCun並沒有簽署:“我不同意這個前提。”

另外,簽名中還出現一個所謂的“OpenAi CEO”,但根據馬庫斯和一眾網友的推測,應該不是本人簽的名。整件事非常撲朔迷離。

截止發稿前,他還特地@一下Sam Altman確認消息。

大佬聯名:叫停比GPT-4強的AI

公開信表示,大量研究表明,得到頂級AI實驗室的認可、具有人類競爭智能的AI系統,可能對社會和人類構成深遠的風險。

正如廣泛認可的Asilomar AI原則中所述,高級AI可能意味著地球生命史上的深刻變化,我們應該投入相應的考量和資源,對之進行規劃和管理。

不幸的是,到現在為止,還沒有任何人采取行動。

最近這幾個月,全球的AI實驗室已經完全失控,它們瘋狂地開展AI競賽,來開發和部署更強大的AI,而沒有任何人可以理解、預測、控制這些AI,連它們的創造者都不能。

如今,AI系統在一般系統上已經變得和人類一樣有競爭力,我們必須捫心自問:

是否應該讓機器用宣傳和謊言充斥我們的信息渠道? 是否應該讓所有的動作都變得自動化,即使是令人滿意的工作?是否應該發展可能某一天會超越我們、淘汰我們、取代我們的非人類智能?是否應該冒險失去對人類文明的控制?

任何未經選舉產生的技術領導者,都沒有權利做出如此重要的決定。

隻有當我們確信,這種AI的影響是積極的、風險是可控的時候,才應該開發強大的AI系統。而且,我們必須有充分的理由相信這一點,潛在的影響越大,我們就更加需要確信這一點。

OpenAI最近關於通用人工智能的聲明指出,“某個階段,在開始訓練未來的系統之前,進行獨立的審查可能非常重要,而對於創建新模型所用算力的增長速度,也應該有所限制。”

我們同意這一點,而那個時間點,就是現在。

因此,我們呼籲所有AI實驗室立即暫停訓練比GPT-4更強大的AI系統,至少6個月。

這種暫停應該向所有人公開,所有人都可驗證,並且要涉及所有關鍵成員。如果不能迅速暫停,就應該讓政府介入。

在這6個月內,所有AI實驗室和獨立學者都應該合力開發一套共享安全協議,用於高級AI的設計和開發。協議完成後,應該由獨立的外部專傢進行嚴格的審計和監督。這些協議必須確保這些AI系統毋庸置疑的安全。

這並不是說,我們要絕對暫停AI的開發,隻是說,我們應該從危險的競賽中退後一步,轉向具有湧現能力的、更大的、不可預測的黑箱模型。

所有的人工智能研究和開發,都應該重新聚焦於這一點——讓當如今最強大的SOTA模型更加準確、安全、可解釋、透明、穩健、對齊,值得人類信賴,對人類忠誠。

與此同時,開發者必須與政策制定者合作,大幅加快開發強大的AI管理系統。

系統至少應該包括:

專門負責監管AI的機構

出處和水印系統,從而幫助區分真實與生成的內容,並且能夠跟蹤模型的泄漏

強大的審計和認證系統

在AI造成傷害後,明確誰該承擔責任

為AI安全技術研究提供強大的公共資金

人類可以享受AI帶來的繁榮未來。在成功創建強大的AI系統後,我們可以享受“AI之夏”,收獲回報,設計上述系統,以造福所有人,給全人類一個適應的機會。

現在,我們的社會已經暫停其他可能造成災難性影響的技術。對於AI,我們也該如此。

讓我們享受一個漫長的AI夏天,而不是毫無準備地進入秋天。

很快,這封千位大佬簽署公開信就引發輿論的軒然大波。

支持的人認為對於AI的恐慌是合理的,因其訓練效率太高,智能的水平每天都在膨脹。

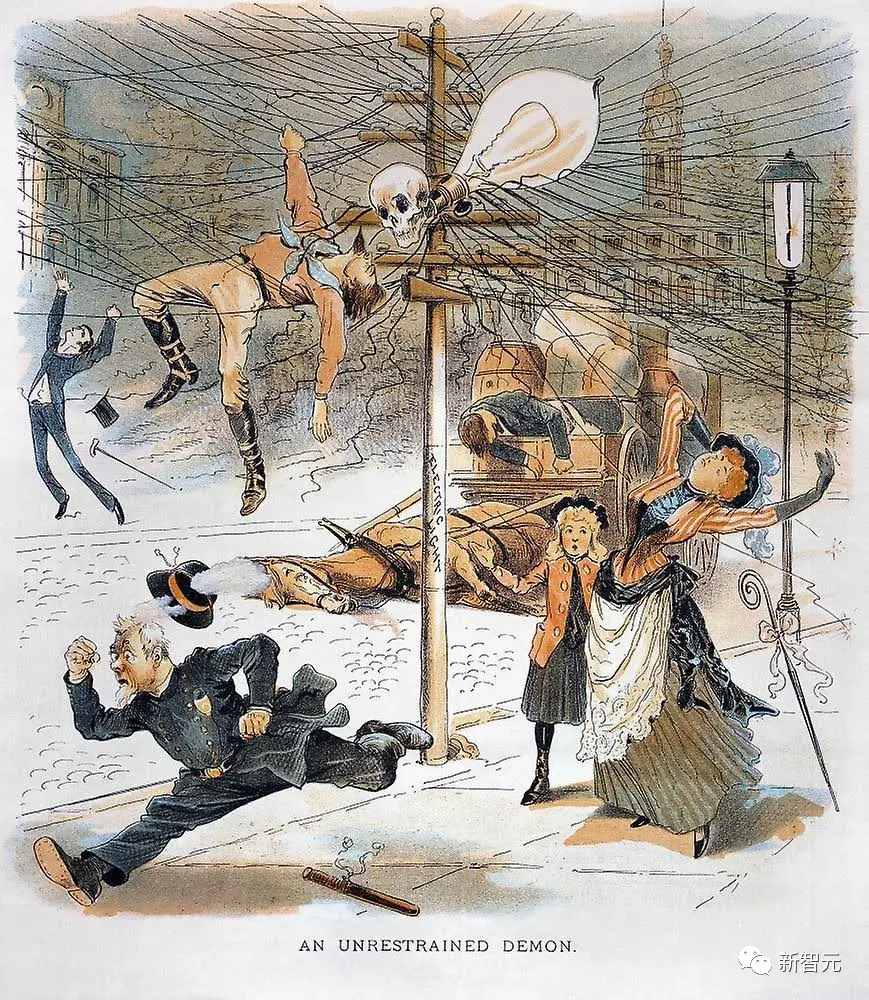

反對的人甚至貼出愛迪生指示人畫的交流電害死人的宣傳海報,認為這不過莫名的指控,在別有用心的勢力在誤導不明真相的群眾。

Sam Altman,態度耐人尋味

從最近發生的事來看,這封信的到來,可謂是千呼萬喚始出來。

從去年11月底,ChatGPT仿佛叩響發令槍,全世界的AI機構都在瘋狂沖刺,卷到紅眼。

而“始作俑者”的OpenAI,腳步也絲毫沒有放慢,聯合著金主爸爸微軟,它隔一陣就給我們來一個暴擊。

先進的AI工具帶給人們的恐慌,一波又一波沖擊著所有人。

今天,大佬們終於出手。

而在昨日公開的訪談中,Sam Altman的話中,竟有一些耐人尋味的表達。

他說,GPT系列為何會出現推理能力,OpenAI的研究者自己搞不明白。

他們隻知道,在不斷測試中,人們忽然發現:從ChatGPT開始,GPT系列開始出現推理能力。

另外Altman在訪談中還說這樣石破天驚的一句:“AI確實可能殺死人類”。

而除Altman,人工智能教父Geoffrey Hinton、比爾蓋茨、紐約大學教授Gary Marcus最近也紛紛發出警示:AI消滅人類,真的不是空談。

OpenAI研究員預測:AI將知道自己是AI

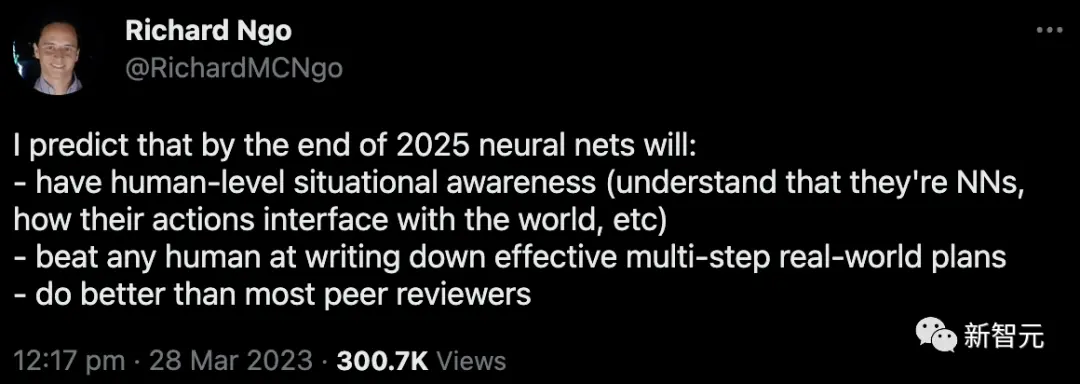

無獨有偶,來自OpenAI治理團隊的Richard Ngo,也對兩年後AI的發展程度進行預測。

在此之前,他是DeepMind的AGI安全團隊的研究工程師。

根據Richard的預測,神經網絡在發展到2025年底時將具備以下特性:

擁有人類水平的態勢感知,比如知道自己是神經網絡等

在撰寫復雜且有效的計劃方面超過人類

比大多數同行評審做得更好

可以自主設計、編碼並分發完整的應用程序

在任何一項白領工作者可以在10分鐘內完成的計算機任務上勝過任何人

編寫能獲獎短篇小說,以及長達5萬字的書籍

生成連貫的20分鐘電影

不過,優秀的人類在以下幾個方面仍然會做得更好(盡管速度要慢得多):

寫小說

連續數天穩定地執行一個計劃

在科學研究上取得突破,比如定理的創新(盡管神經網絡至少已證明一個)

與神經網絡控制的機器人相比,完成典型的體力勞動任務

此處補充一下,通俗地講,態勢感知(situational awareness)是指個體對周圍環境中發生的事件和情況的感知、理解和預測。這包括解周圍環境的動態變化,評估這些變化對自己和他人的影響,以及預測未來可能出現的情況。

有關態勢感知在AI研究中的具體定義,可以參閱下面這篇論文:

論文地址:https://arxiv.org/abs/2209.00626

Richard表示,自己的預測其實更接近2年,但由於不同人會采用不同的評估標準,所以2.75年似乎更穩健。

此外,這裡提到的“預測”是指,Richard認為這個觀點的可信度超過50%,但不一定比50%高很多。

需要註意的是,預測並沒有基於任何與OpenAI有關的特定信息。

網友翹首以待GPT-5

相比於十分謹慎的大佬,網友們在體驗性能炸裂的GPT-4之後,顯然已經迫不及待地等著GPT-5的到來。

最近,關於GPT-5的預測,更是就像雨後春筍一般冒個不停……

(非官方)

根據一個神秘團隊的預測,GPT-5將在GPT-4的基礎上,帶來一系列令人興奮的功能和增強的性能,比如在可靠性、創造力和適應復雜任務方面的全面超越。

· 個性化模板:根據用戶的特定需求和輸入變量進行定制,提供更個性化的體驗。

· 允許用戶調整AI的默認設置:包括專業性、幽默程度、說話語氣等。

· 自動將文本轉換成不同格式:如靜態圖像、短視頻、音頻和虛擬模擬。

· 高級數據管理:包括記錄、跟蹤、分析和共享數據,從而簡化工作流程並提高生產力。

· 輔助決策:通過提供相關信息和見解,協助用戶做出明智的決策。

· 更強的NLP能力:增強AI對自然語言的理解和響應,使其更接近人類。

· 集成機器學習:允許AI不斷學習和改進,隨著時間的推移適應用戶需求和偏好。

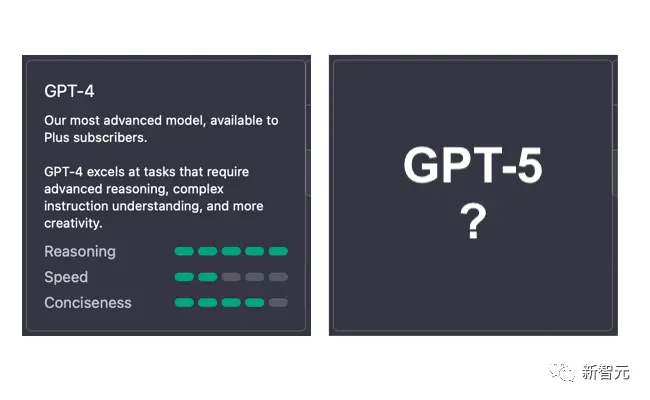

作為過渡的GPT-4.5

此外,這個團隊還預測,作為過渡的GPT-4.5模型將在2023年9月或10月推出。

GPT-4.5將建立在2023年3月12日發佈的GPT-4的優勢基礎上,為其對話能力和上下文理解帶來更多的改進:

處理更長的文本輸入

GPT-4.5可能會在保持上下文和連貫性的同時處理和生成更長的文本輸入。這一改進將提高模型在處理復雜任務和理解用戶意圖方面變的性能。

增強的連貫性

GPT-4.5可能會提供更好的連貫性,確保生成的文本在整個對話或內容生成過程中始終關註相關主題。

更準確的回應

GPT-4.5可能會提供更準確和上下文相關的回應,使其成為各種應用的更有效工具。

模型微調

此外,用戶可能也可以更加便捷地微調GPT-4.5,從而更有效地定制模型並應用於特定任務或領域,客戶支持、內容創建和虛擬助手等。

參照目前GPT-3.5和GPT-4的情況,GPT-4.5很可能也會為GPT-5的創新奠定堅實基礎。通過解決GPT-4的局限性並引入新的改進,GPT-4.5將在塑造GPT-5發展過程中發揮關鍵作用。

參考資料:

https://futureoflife.org/open-letter/pause-giant-ai-experiments/

https://chatgpt-5.ai/gpt-5-capabilities/

https://twitter.com/RichardMCNgo/status/1640568775018975232