大科技公司繼續不計後果地投入數十億美元,為消費者提供人工智能助手。微軟的Copilot、Google的Bard、亞馬遜的Alexa和Meta的Chatbot都已經擁有生成式人工智能引擎。蘋果是少數幾個似乎在慢慢將Siri升級為LLM的公司之一。它希望與本地運行而非雲端運行的LLM競爭。

更糟糕的是,生成式人工智能(GenAI)系統,甚至像巴德(Bard)等大型語言模型(LLM),都需要大量的處理,因此它們通常通過向雲端發送提示來工作。這種做法會帶來一系列其他的隱私問題,並為惡意行為者提供新的攻擊載體。

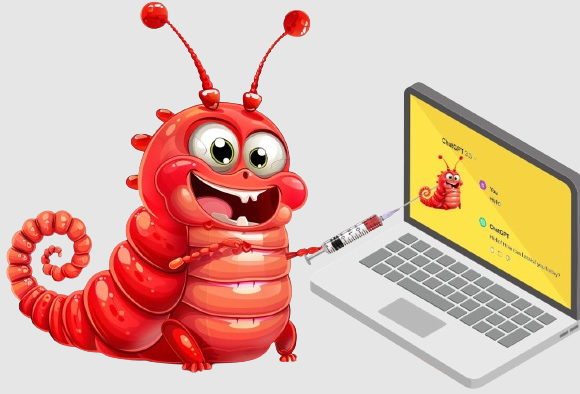

ComPromptMized 公司的信息安全研究人員最近發表一篇論文,展示他們如何創建"零點擊"蠕蟲,從而"毒害"由 Gemini (Bard) 或 GPT-4 (Bing/Copilot/ChatGPT) 等引擎驅動的 LLM 生態系統。蠕蟲病毒是一組計算機指令,除打開受感染的電子郵件或插入U盤外,用戶幾乎不需要采取任何行動,就能隱蔽地感染多個系統。任何 GenAI 供應商都沒有防范措施來阻止此類感染。不過,將這種病毒引入 LLM 數據庫則比較棘手。

研究人員想知道"攻擊者能否開發惡意軟件,利用代理的 GenAI 組件,對整個 GenAI 生態系統發動網絡攻擊?"簡短的回答是肯定的。

ComPromptMized 創建一個蠕蟲病毒,他們稱之為莫裡斯二世(Morris the Second,簡稱 Morris II)。莫裡斯二號使用通俗易懂的"對抗性自我復制提示",誘騙聊天機器人在用戶之間傳播蠕蟲病毒,即使他們使用不同的 LLM。

"這項研究表明,攻擊者可以在輸入中插入此類提示,當 GenAI 模型處理這些輸入時,會促使模型將輸入復制為輸出(復制),並從事惡意活動(有效載荷),"研究人員解釋說。"此外,這些輸入還能利用 GenAI 生態系統內的連通性,迫使代理將其傳遞(傳播)給新的代理"。

為驗證這一理論,研究人員創建一個孤立的電子郵件服務器,用於"攻擊"由 Gemini Pro、ChatGPT 4 和開源 LLM LLaVA 支持的 GenAI 助手。然後,ComPromptMized 使用包含基於文本的自我復制提示和嵌入相同提示的圖片的電子郵件。

這些提示利用人工智能助手對檢索增強生成(RAG)的依賴,也就是從本地數據庫之外獲取信息的方式。例如,當用戶詢問"Bard"閱讀或回復受感染的電子郵件時,它的 RAG 系統就會將內容發送給Gemini專業版,以便做出回復。然後,Morris II 復制到 Gemini 上,並執行蠕蟲的有效載荷,包括數據外滲。

這項研究的合著者本-納西博士說:"生成的包含敏感用戶數據的響應被用於回復發送給新客戶的電子郵件時,會感染新的主機,然後存儲在新客戶的數據庫中。"

不僅如此,基於圖像的變種可能更加難以捉摸,因為提示是不可見的。黑客可以將其添加到看似無害或預期的電子郵件中,如偽造的時事通訊。然後,蠕蟲就可以利用助手向用戶聯系人列表中的每個人發送垃圾郵件,汲取數據並將其發送到 C&C 服務器。

納西說:"通過將自我復制提示編碼到圖片中,任何包含垃圾郵件、濫用材料甚至宣傳內容的圖片都可以在最初的電子郵件發送後被進一步轉發給新客戶。"

他們還可以從郵件中提取敏感數據,包括姓名、電話號碼、信用卡號、社會保險號或"任何被視為機密的數據"。ComPromptMized 在發佈其工作之前通知Google、Open AI 等公司。

如果說 ComPromptMized 的研究表明什麼的話,那就是大科技公司可能需要放慢腳步,放遠目光,以免我們在使用他們所謂和善的聊天機器人時,需要擔心新的人工智能驅動的蠕蟲和病毒。