86歲的羅馬教皇方濟各大概不會料到,在他飽受支氣管炎困擾的那些日子裡,一張機器生成的圖片讓他成時尚界的“頂流”。那件巴黎世傢風格的白色羽絨服裡包裹著的人仿佛是他,又不是他。

一些人在社交平臺上留言稱,他們已無法判斷何為真實、何為虛構。

機器生成的虛假圖像:教皇穿著巴黎世傢風格羽絨服,走在城市街道上。

巴勃羅·塞維爾(Pablo Xavier,假名)——一個31歲的芝加哥建築工人,是這張熱門圖片的締造者。他在一個周五的下午吸食毒品時產生靈感,決定創作一組和“教皇”相關的作品,於是便有那張“教皇穿著巴黎世傢/盟可睞的羽絨服,走在羅馬和巴黎的街道上”的圖片。

與傳統的藝術工作者不同,塞維爾的創作並不涉及專業美術知識。他使用的工具叫Midjourney。這是一款時興的人工智能(AI)繪畫工具,即便是沒有美術基礎的人也能將其掌握。用戶需要做的隻是在輸入框中填入描述性的文字,等待數分鐘,便會有對應的圖片產出。

Midjourney目前需要搭載Discord使用,在輸入框中填入描述性文字,會有對應的圖片產出。

與之類似的AI圖像生成器還包括OpenAI開發的DALL-E,以及Stability AI與慕尼黑大學(LMU)合作研發的Stable Diffusion。雖然使用的訓練模型略有差異,這些工具的共同點在於,它們都能將簡單的文字描述轉化成圖像輸出。

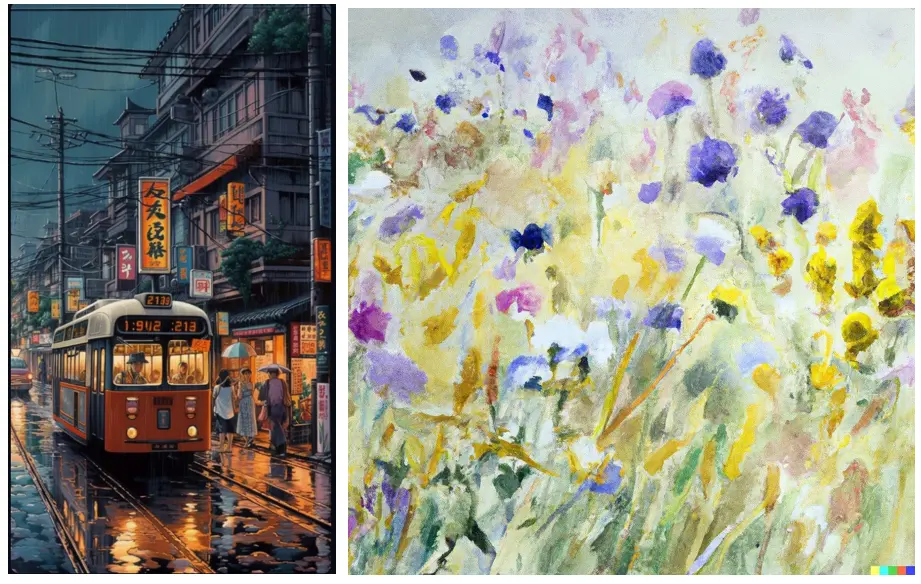

左圖來自Midjourney圖例; 右圖由OpenAI根據“野花,草地,秋韻,水彩”描述進行創作。註意右下角的5個色塊,這是DALL-E 2制圖的標志(水印)。

塞維爾告訴美國聚合新聞網站BuzzFeed的記者,他覺得讓教皇身穿羽絨服的圖片“很完美”。他把它發到一個名為AI Art Universe的Facebook小組裡,又傳到社交論壇Reddit上。之後,這張圖片就像外界所看到的那樣——像病毒一般傳開。

長期關註互聯網文化的美國記者佈羅德裡克(Ryan Broderic)在Twitter上表示,“巴黎世傢教皇”可能是第一個真正被大規模傳播的AI虛假信息(misinformation)案例。但類似的案例層出不窮。就在“巴黎世傢教皇”被“曝光”的同時,一組聲稱“美國前總統特朗普被逮捕”的圖片已經在賽博空間傳播開來。網絡上還流傳著一張顯示“俄羅斯總統普京單膝跪地”的圖片。隻不過,這些圖片無一例外是用機器生成的。

Bellingcat創始人Eliot Higgins用Midjourney創造一組展示特朗普被捕的圖片。

當技術的發展模糊現實和虛構之間的界限,面臨人工智能被武器化的風險,人類要怎麼做,才能避免被愚弄?答案或許飄蕩在風中。但現階段,相較於在現實世界中用各類鏡頭拍攝的照片,用AI生成的圖片在仿真性上仍有一些“瑕疵”。通過探尋這些“瑕疵”,我們在當下仍有較大可能識別出用機器生成的圖片。

此處,“澎湃明查”將結合具體圖例,為大傢介紹一些當下仍可使用的鑒別AI生成圖片的方法。

工具

嚴格來說,塞維爾發佈的圖片並沒有他所認為的那般“完美”。無論是圖中教皇那隻以奇怪的姿勢抓著不完整的咖啡杯的右手,還是其身上掛著的沒有顯示出適當直角的十字架的佩飾,或是其戴著的眼鏡鏡片邊緣不合理的陰影,都暗示這不是一張在正常物理空間拍攝的照片。

左:圖中人物右手受到擠壓,咖啡杯的形狀和手握咖啡杯的姿勢極不自然;中:配飾上的十字架圖案沒有呈現適當的直角;右:眼鏡鏡片在人物臉部呈現不合理的陰影。

在判斷一張圖片是否是由機器生成時,首先值得關註的是圖片中是否存在一些異常的細節。《華盛頓郵報》技術專欄作傢奧維德(Shira Ovide)對此提出4點可供參考的建議:

第一,查看圖中人物的雙手,是否存在手指過多或其它怪異的情況。早期的AI在生成人物手部圖像時常常出現問題,業界普遍認為這是由於訓練集中人類手部圖像出現的頻率往往低於臉部導致的。Midjourney從V5版本起已經對機器生成的手部效果進行較大改進,但不意味著已經沒有漏洞。

DALL-E生成的虛假圖像:騷亂中的法國總統馬克龍。其手部手指的數量和姿勢均十分怪異。

例如,在塞維爾創作的教皇圖像中,人們可以輕易地觀察到,圖中人物的右手看起來被壓扁,而他手握咖啡杯的姿勢也顯得極不自然。

第二,觀察圖像中人物的配件。是否存在缺少或不匹配的耳環、眼鏡架?隻有一個輪子的自行車?如果圖像中出現一些違背現實的物體,那麼它就很有可能是用機器生成的。

同樣以塞維爾創作的教皇圖像為例。一些目光敏銳的人或許已經註意到,方濟各脖子上佩戴的傳統胸飾十字架隻有一條帶子,這是不合理的。

方濟各脖子上佩戴的傳統胸飾十字架(紅圈內)隻有一條帶子。

第三,觀察圖像中的文字。當一張圖片中出現路牌、廣告牌、產品包裝袋時,不妨留心一下這些物體上包含的文字內容。它是一堆亂碼嗎?你能看懂文字顯示的信息嗎?

以英國哈裡王子打包麥當勞食品的圖像為例,這是一張用AI生成的圖片。盡管圖中黃色包裝袋上顯示的餐廳標志看起來很逼真,但袋子上的文字卻是胡言亂語。

機器生成的虛假圖像:英國哈裡王子打包麥當勞食品。包裝袋上的文字是一堆亂碼。

第四,掃描背景。人工智能生成的圖像可能會有模糊或扭曲的細節,這一點在圖像背景中尤其明顯。例如在這張顯示特朗普被捕的假圖中,當我們將目光從畫面中心移開時,就不難註意到,背景中執法人員的臉早已模糊或變形。

Higgins用Midjourney生成的“特朗普被捕”的虛假圖像背景中,執法人員的臉產生模糊或變形。

除上述4點,AI生成的圖像還有可能會出現一些常見的異常細節。例如人物的臉部不對稱,牙齒偏離中心,配飾與身體融為一體等。這些細節之前也常常被應用於對深假圖像(DeepFake,俗稱AI換臉)的觀測中。但隨著人工智能技術的發展,這些發現AI圖像的線索也許很快就會過時。人們可能將越來越難用肉眼發現AI生成的內容。

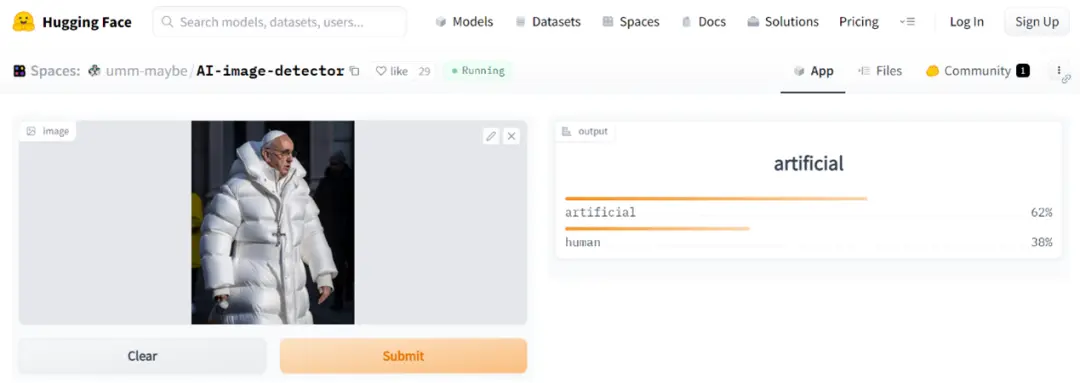

在業界,一些科學傢近年來開始嘗試將解決問題的目光轉向機器,期待“用魔法打敗魔法”。例如Mayachitra的工程師在2021年建立一個用以檢測圖片是否使用生成對抗網絡技術的GAN檢測器;開源社區Hugging Face上搭建有針對AI生成內容的AI圖像檢測器和OPENAI檢測器;2020年,微軟公司還曾發佈過一項名為Microsoft Video Authenticator的工具,用以針對網絡上用深假技術制作的虛假視頻。但出於安全的考慮,微軟公司並未將這款工具開放供人們使用。

用Hugging Face的AI圖像檢測器檢測“巴黎世傢教皇”圖像,反饋此圖有62%的概率由機器生成。

需要指出的是,現階段,許多用於檢測AI圖片的工具反饋的結果並不總是準確,這可能是由於它們隻能針對某些使用特定模型的AI圖片進行檢測。

面對人工智能技術被武器化的風險,人類目前的應對之法還存有諸多局限。但這不意味著要因噎廢食,阻止新技術的發展。奧維德指出,偽造圖像的現象由來已久,把AI造假看作世界末日的做法是不負責任的。

目前,除將希望寄托於技術和監管,人們更多可以做的,或許是在傳播信息前,能夠冷靜思考,尋找圖片的來源,閱讀和圖像相關的標題、背景信息,留心圖片上是否存有AI生成圖片的水印,並對圖片的細節進行判斷。