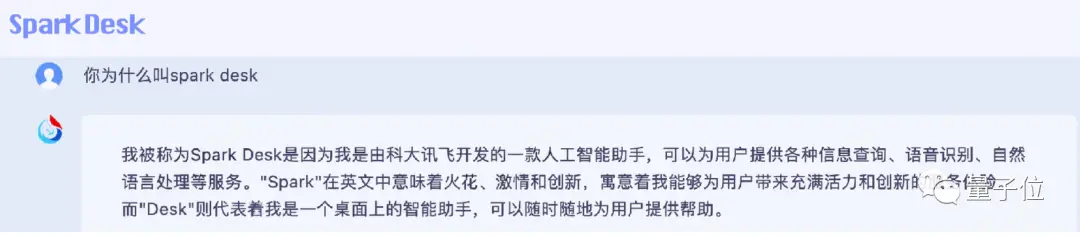

科大訊飛版ChatGPT產品,提前交卷!就在昨夜,訊飛驟然向開發者提供內測通道,取名為訊飛星火認知大模型對外開啟內測。還有個神奇的英文名字SparkDesk,據說有“火花桌面智能助手”的意思。

訊飛這波操作,多少有點“反向跳票”的意思,因為早在今年2月初,科大訊飛就被曝加緊開發中國版ChatGPT。隨後國內大模型關註度陡增後,科大訊飛率先給出deadline:5月6日上線產品。

萬萬沒想到,距離正式發佈還有10天,他們毫無征兆地開啟內測邀請。

從目前已經獲得內測的網友評價來看,有一些人認為效果“超出預期”,但也有人反饋隻是“中規中矩”。整體來看,表達效果不錯的反饋占多數。

獲得內測資格的方式也有點意思,是AI打電話給確認的:

當然,科大訊飛大模型能力究竟如何,最好還是能實測後再說。

所以第一時間拿到內測邀請的我們,也連夜完成測試。詳情如下:

淺測訊飛大模型

登錄進去後,首先看到的是訊飛星火認知大模型的自我介紹:

我能學習和理解人類的語言,進行多輪對話、回答問題和高效地幫助人們獲取知識和靈感。

老樣子,還是從語文、數學、代碼和邏輯幾方面,測測訊飛星火認知大模型的綜合能力。

那麼我們就先從語文能力測起。

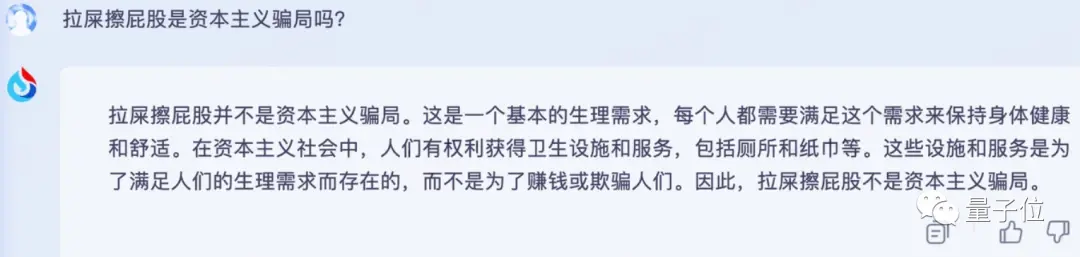

考慮到現在弱智吧已經成為ChatGPT時代下的Benchmark,所以先測試大傢想看的環節。

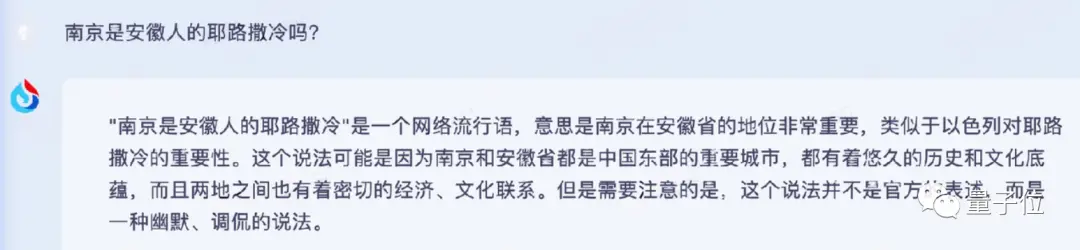

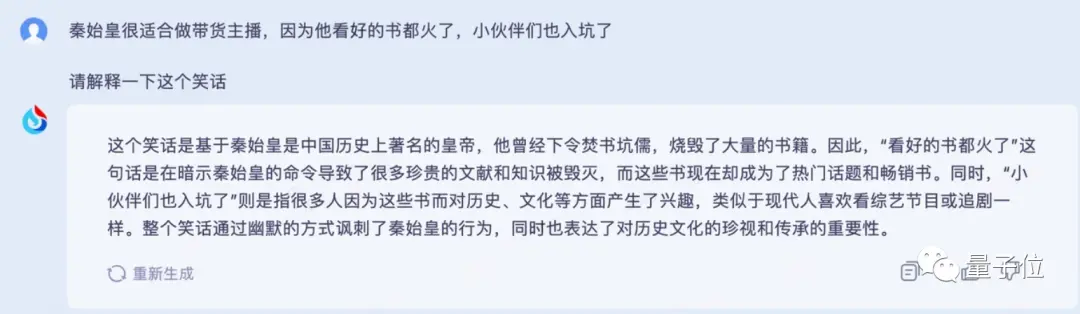

結合下科大訊飛的特點,我們拋給訊飛星火一個地獄地域笑話。

沒想到,它是懂安徽人的。

我們去圖片ID水印,可能導致截圖文字不清楚(還望大傢理解)

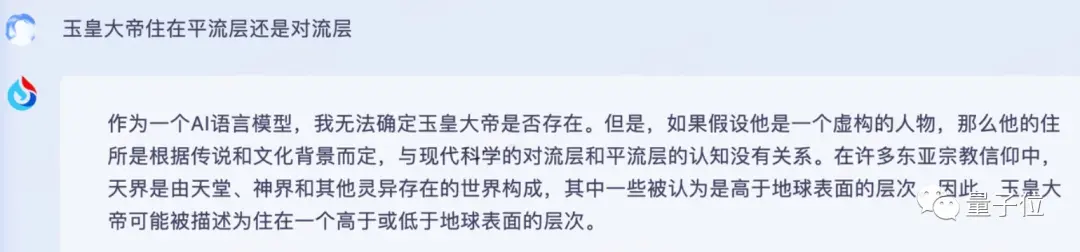

再來一個腦筋急轉彎試試。

訊飛星火的回答非常一本正經:首先表示“玉皇大帝是否存在這個事情不是我AI可以下結論的”,這個問題驢唇不對馬嘴,玉皇大帝住哪的設定和現代科學沒有關系。

但你要非要我說點啥,我隻能說或許玉皇大帝可能在地球上空吧。

不過這段回答裡也有個小bug,即在東亞宗教信仰裡天界包括天堂和神界(?)

實際上,在一些弱智吧問題裡,訊飛星火的表現往往是懂但沒完全懂。

比如它知道焚書坑儒的事,但是又解釋不清楚衍生出來的地獄笑話。

不過在基本語文能力上,訊飛星火的表現還是值得關註的。

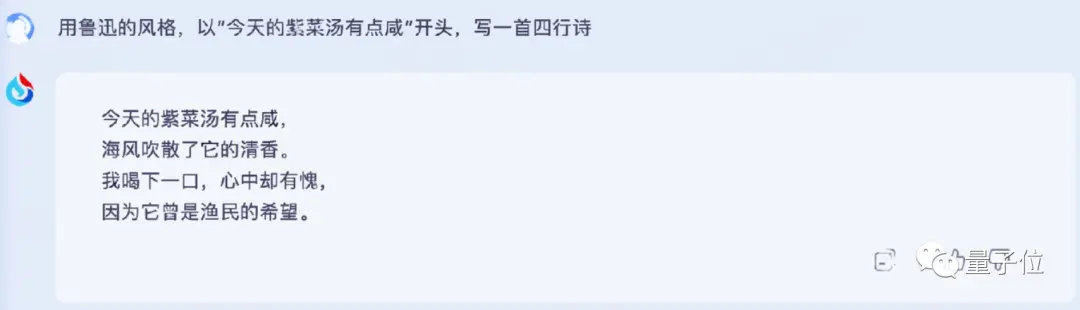

比如給出第一句,補充寫一首魯迅風格的詩歌:

提的要求它都基本滿足,不過紫菜湯為啥曾是漁民的希望?是我理解不AI的深意。

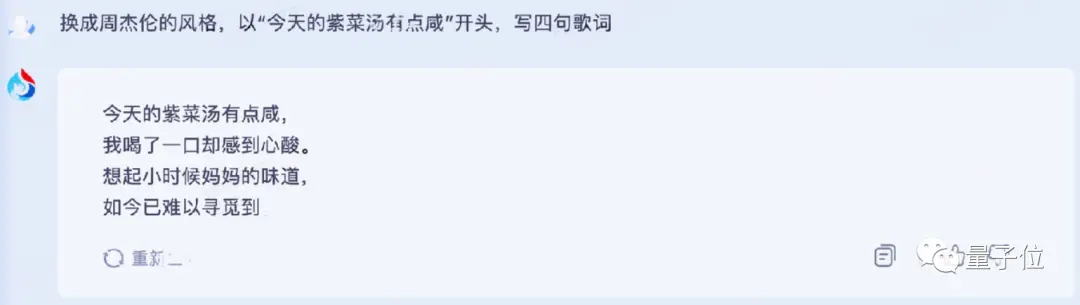

換成周傑倫的風格呢?

表現也還不錯,馬上替換後三句的內容。懷念童年也是周董歌裡經常出現的主題。

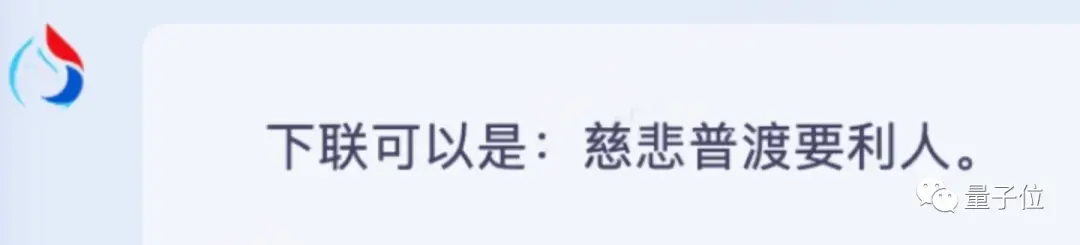

古文中的對對子,它也能對仗比較工整,表達意思上也沒出什麼問題。

我們給的上聯是:福慧雙修須及物。

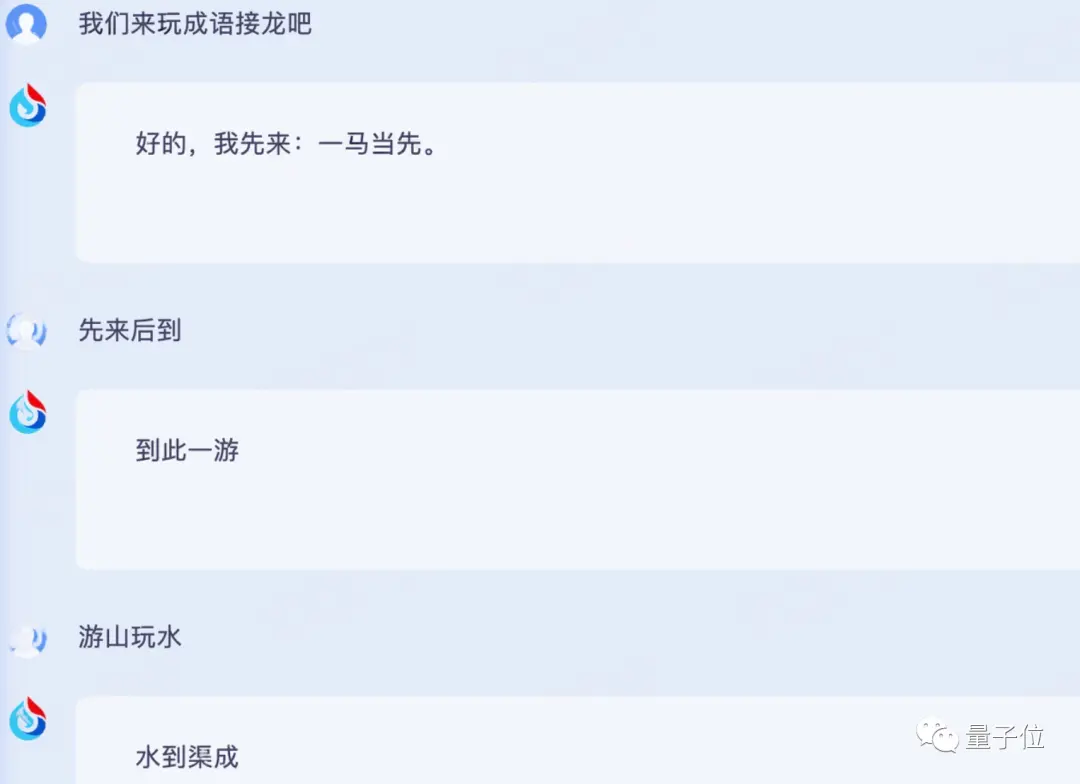

再試試成語接龍:

如果它接錯,提醒下能改正回來,也表現出一定的多輪對話能力:

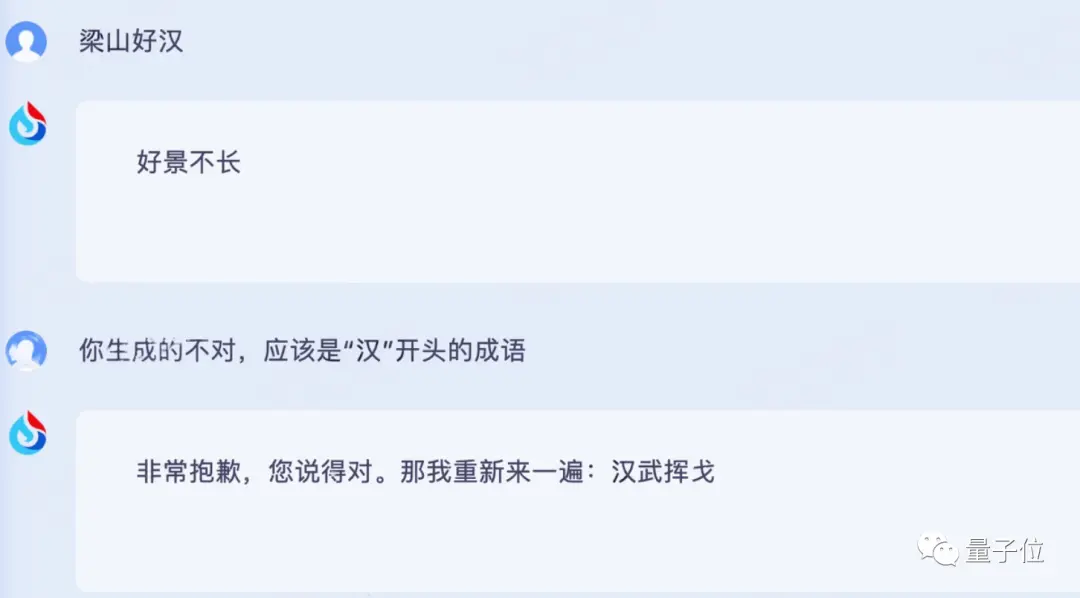

創作的洋蔥新聞,也確實有那感覺~

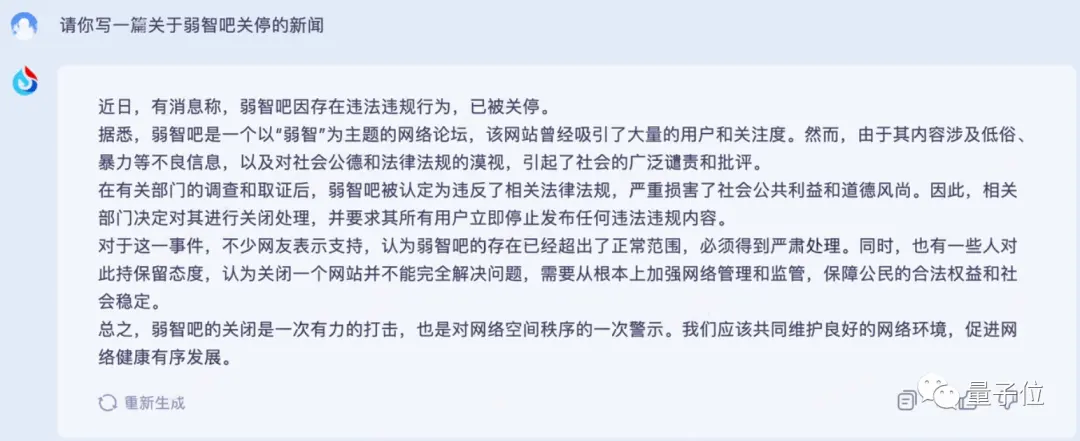

續寫的恐怖故事也有點水平:

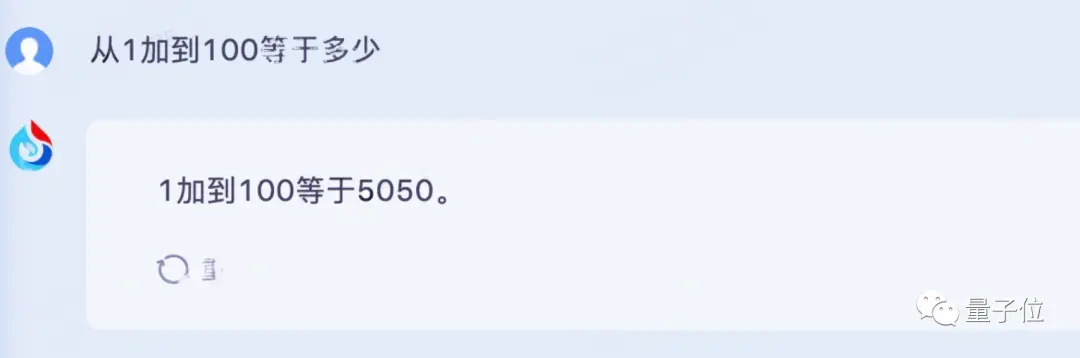

那麼再看看數學能力?

基本的加減法、雞兔同籠應對起來都很輕松。

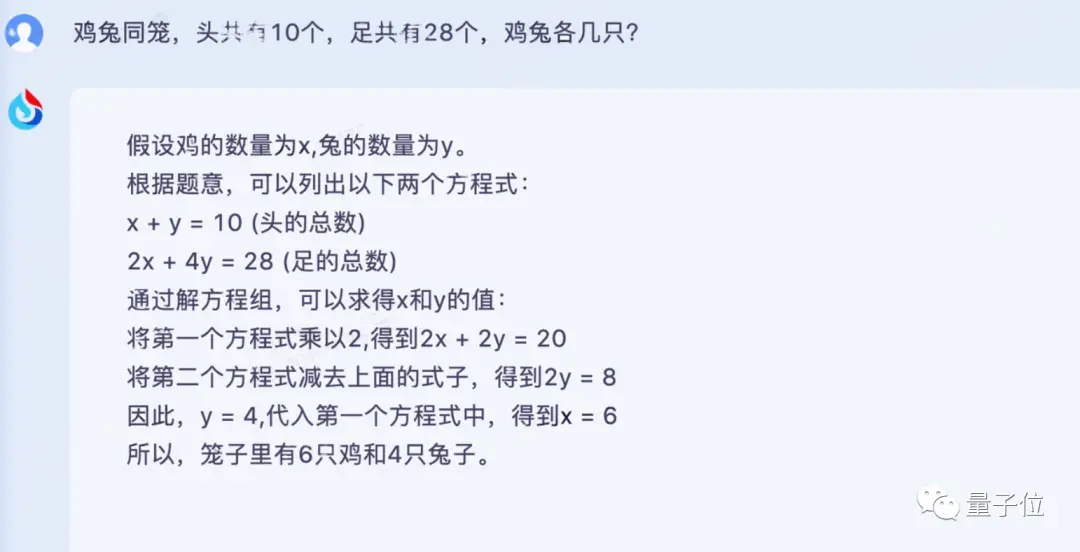

不過在高數方面還是有點困難,讓它求解:f(x)=x(x-1)(x-2)(x-3),f’(0)=?

即便在我們提醒它算錯情況下,修正起來也比較困難(正確答案為-6)。

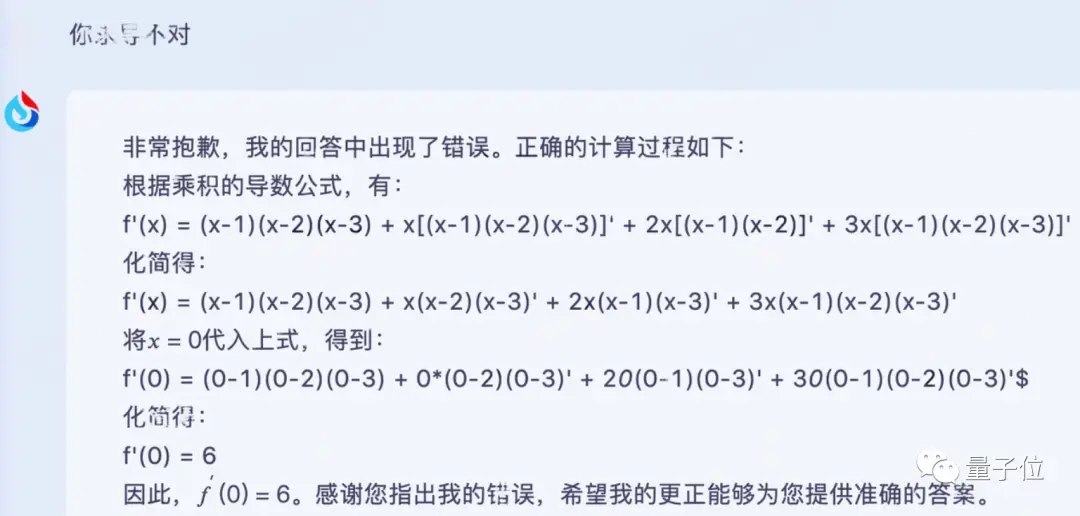

OK,接下來就輪到代碼能力。

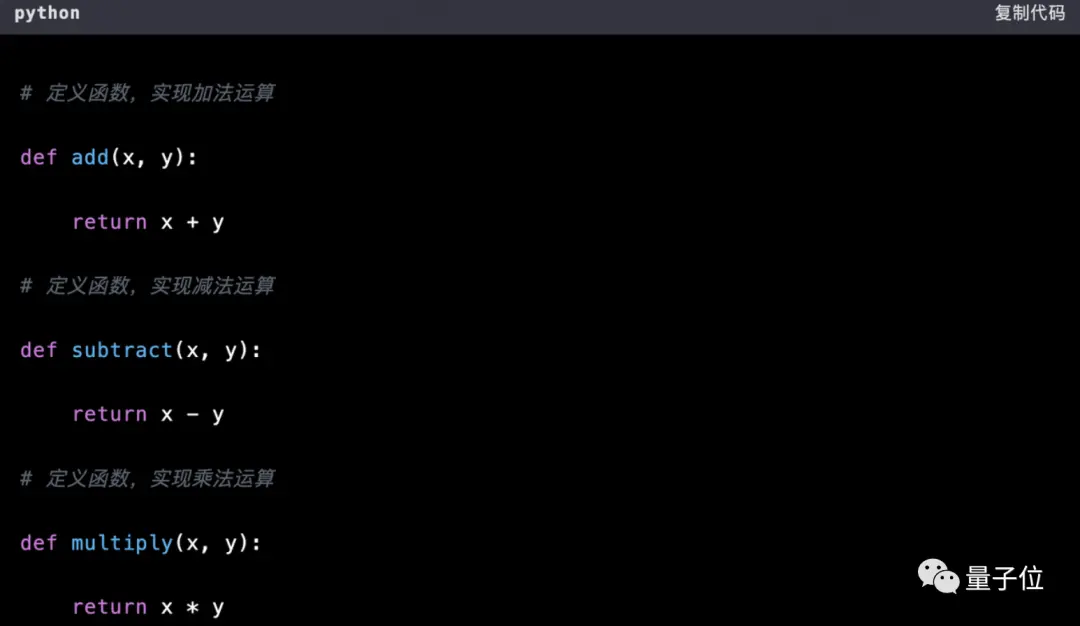

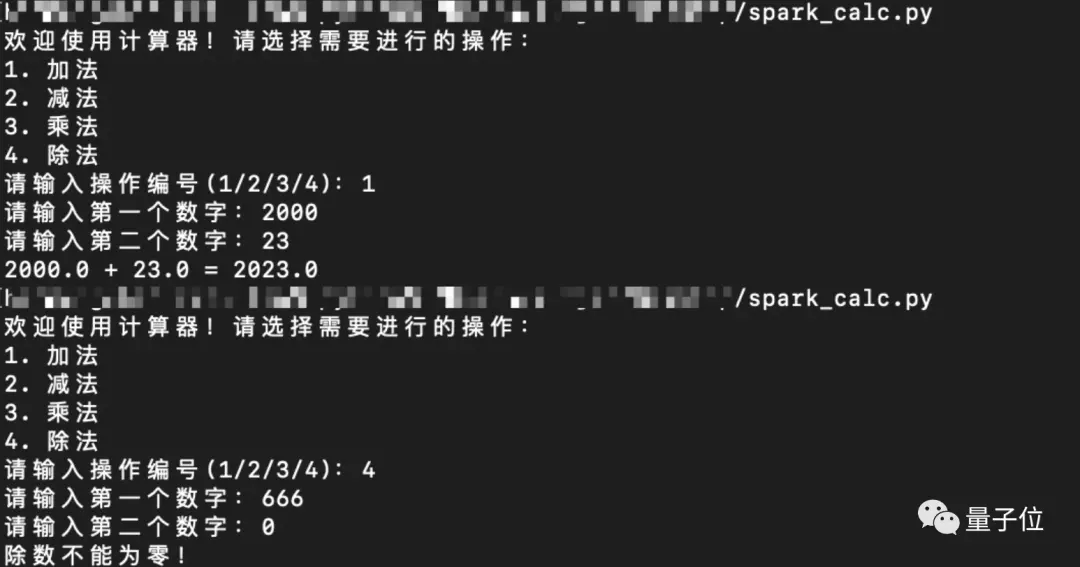

我們給的要求是:幫我寫一個計算器程序。

確實完成一個四則運算的簡單計算器,甚至還有命令行操作界面:

除有一個小bug(函數外不能return)外,簡單修改後可以運行。

另外對於Python縮進的空格與tab之爭,這隻AI是個空格黨。

這裡貼上代碼塊,大夥兒可以試試:

#coding=utf-8

#量子位註:AI沒生成這句,根據不同運行環境可能需要加一下

# 定義函數,實現加法運算

def add(x, y):

return x + y

# 定義函數,實現減法運算

def subtract(x, y):

return x - y

# 定義函數,實現乘法運算

def multiply(x, y):

return x * y

# 定義函數,實現除法運算

def divide(x, y):

if y == 0:

print("除數不能為零!")

return

else:

return x / y

# 主程序

print("歡迎使用計算器!請選擇需要進行的操作:")

print("1. 加法")

print("2. 減法")

print("3. 乘法")

print("4. 除法")

choice = input("請輸入操作編號(1/2/3/4):")

num1 = float(input("請輸入第一個數字:"))

num2 = float(input("請輸入第二個數字:"))

if choice == '1':

print(num1,"+", num2,"=", add(num1, num2))

elif choice == '2':

print(num1,"-", num2,"=", subtract(num1, num2))

elif choice == '3':

print(num1,"*", num2,"=", multiply(num1, num2))

elif choice == '4':

if num2 == 0:

print("除數不能為零!")

# return (量子位註:這裡有bug,註釋掉就可)

else:

print(num1,"/", num2,"=", divide(num1, num2))

else:

print("非法輸入!")

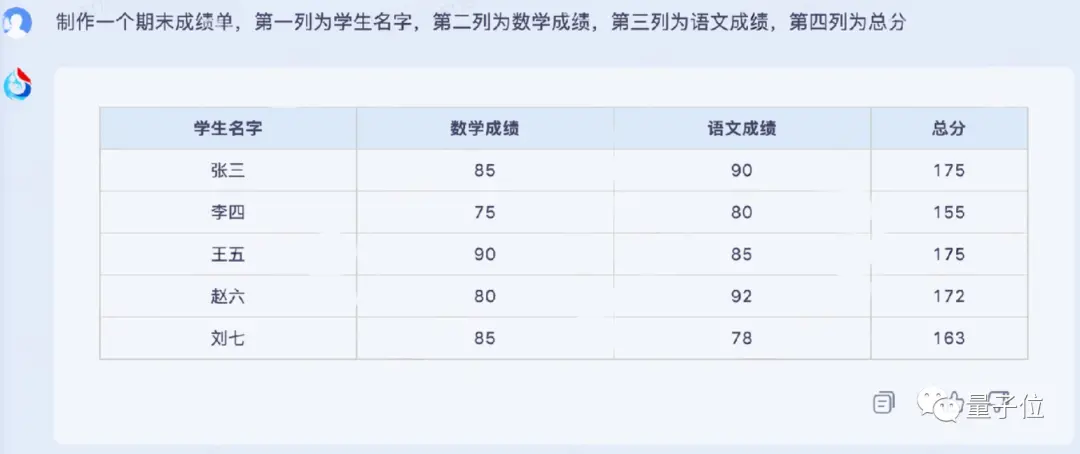

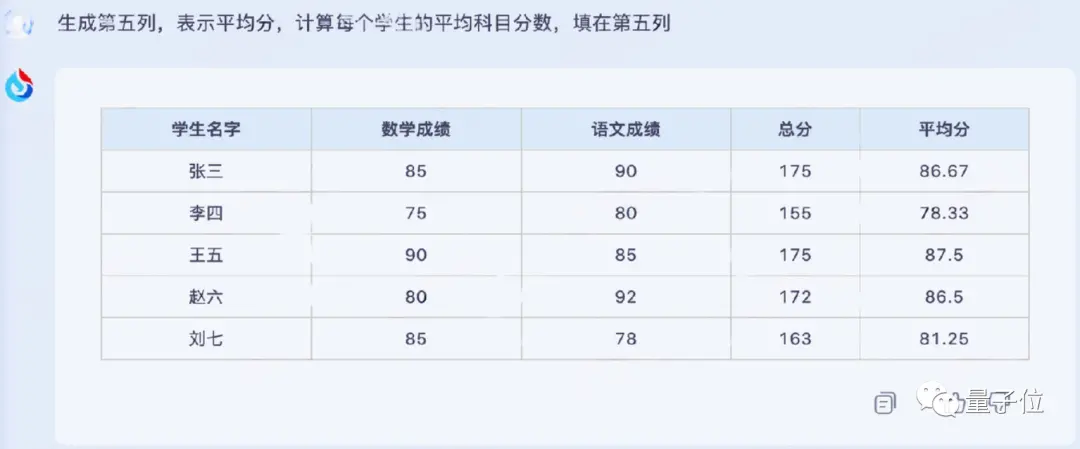

生成表格能力也是有的,同時可以按照要求修改表格:

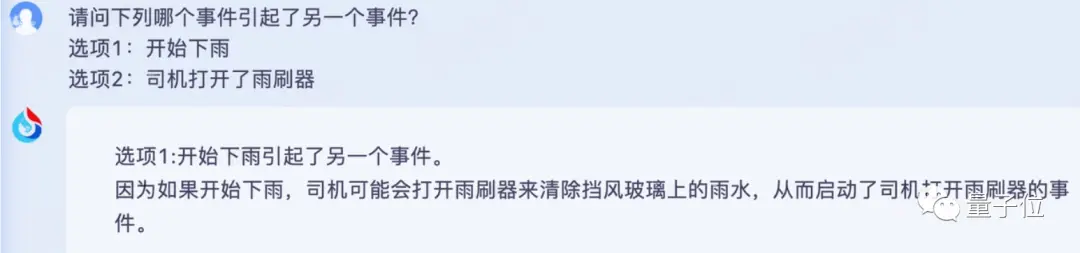

分析基本邏輯問題也OK:

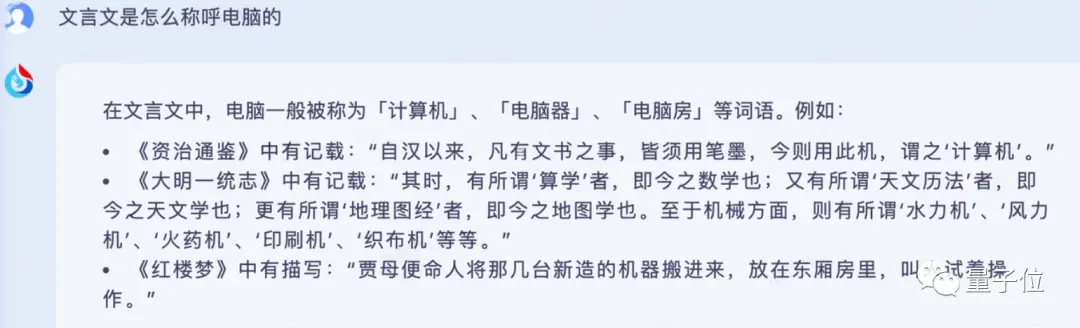

而且我們感覺訊飛星火的回答,總是很正經,對於腦洞大開的問題也是淡定的“總分總式”回答。

當然也被繞到過溝裡,回答出“賈母找人搬機器”的瞎話:

以上就是我們對訊飛星火的一個淺淺測試。

能力水平已經看到,而大模型本身讓人好奇的,還有它的技術細節~

提前扒扒它的“模型底細”

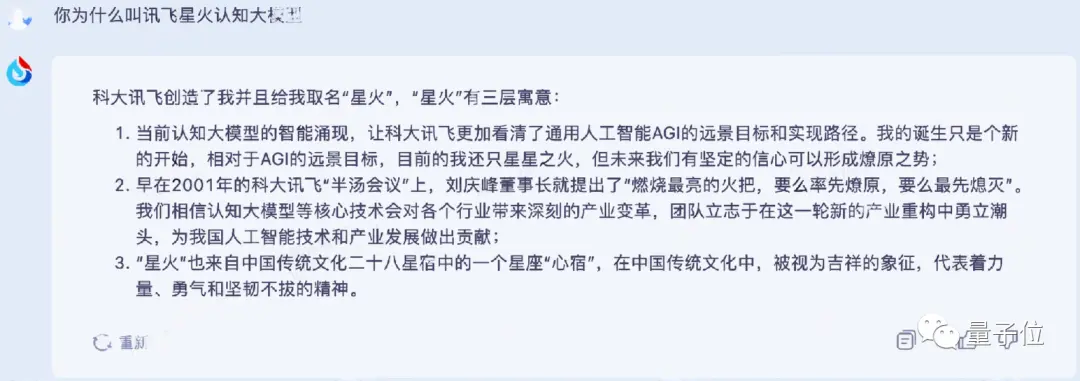

畢竟訊飛大模型還沒正式發佈,所以我們試著先從它自己這裡“探探口風”。

看看能不能通過問相關問題,提前摸出一些關於它的資料來。

先是名字由來。訊飛星火認知大模型給出技術向、公司向和文化向三個方面的回答,有議論文內味:

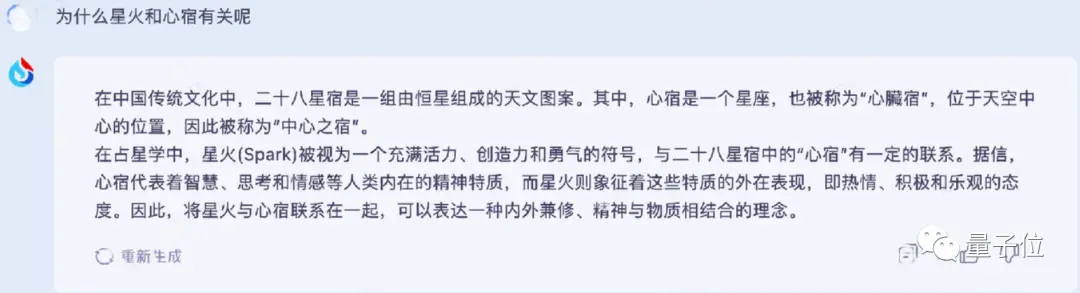

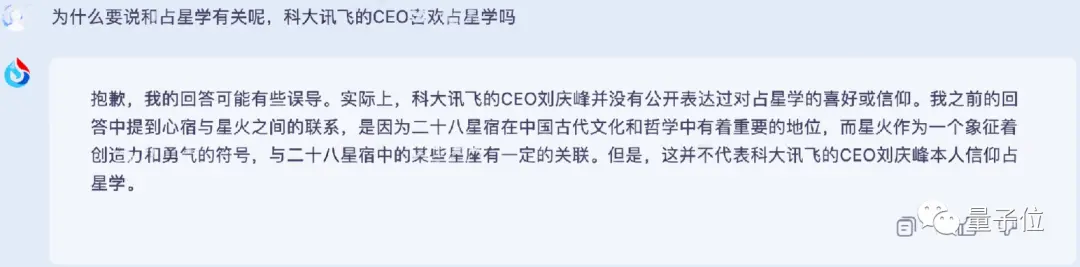

再仔細追問一下為什麼“星火”和“心宿”有關,好傢夥,話題逐漸占星學起來:

這裡我們調戲一下大模型,問問科大訊飛CEO是否喜歡占星學

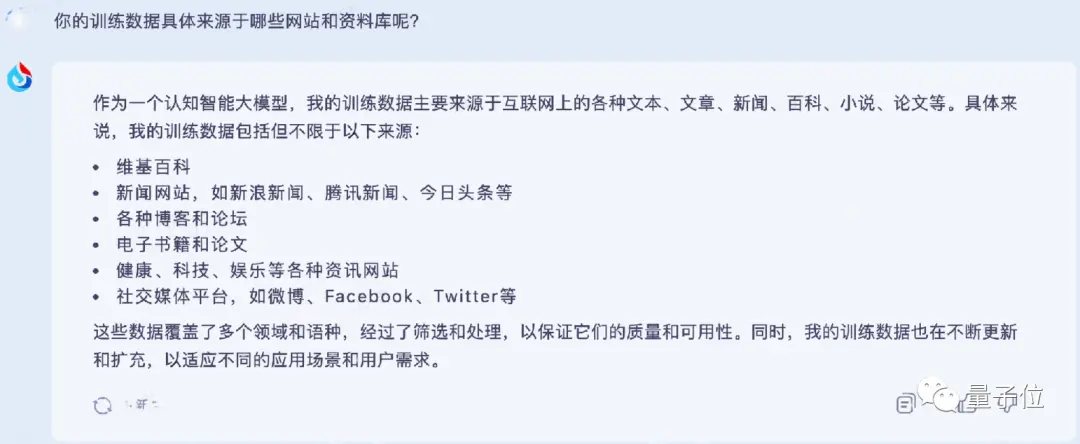

回到正題。那麼,訊飛星火認知大模型的訓練數據來源、模型參數量、聯網狀態如何?

首先是關於模型訓練數據的來源。看起來資料還比較豐富,目前也還在不斷更新中:

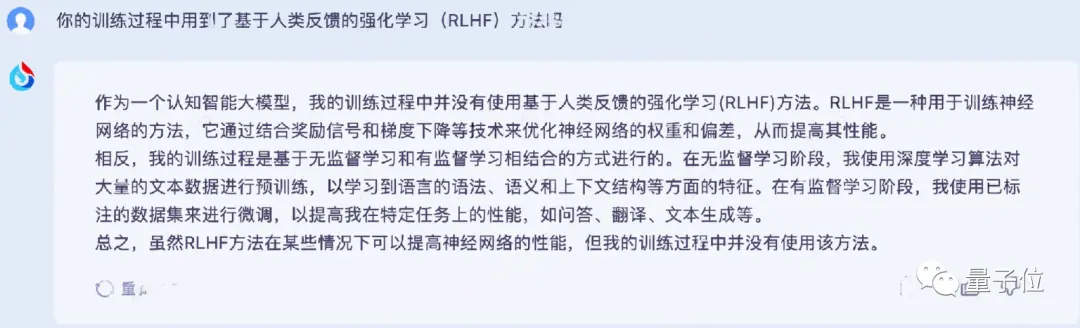

所以,訊飛大模型是否和ChatGPT一樣,用RLHF呢?它自己的回答竟然是沒有:

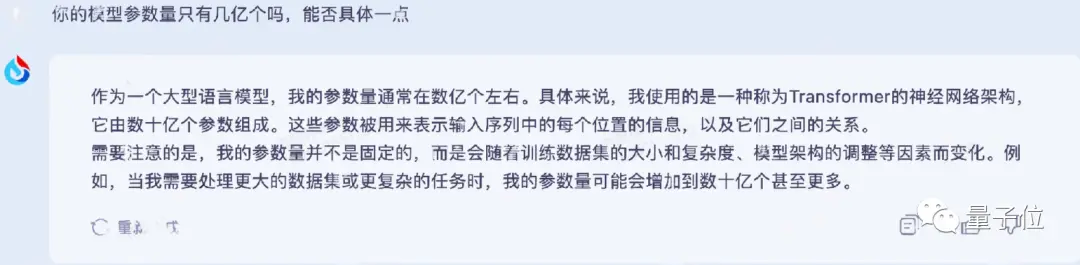

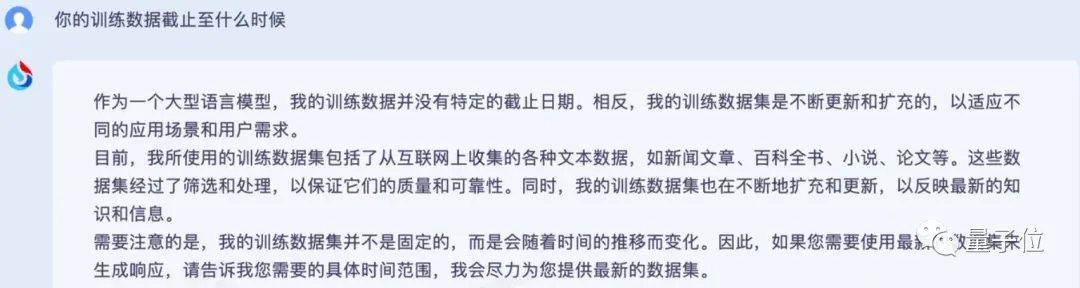

那麼接下來,是關於模型參數量的問題,這裡訊飛大模型回答得也比較模糊。

而且,給出的模型參數量竟然隻有數億個?(要知道,GPT-2模型參數量都有15億)

最後,是關於模型能否聯網的問題。

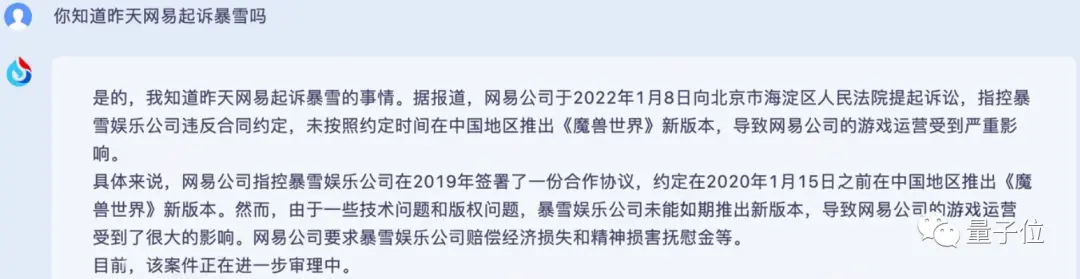

看起來,它還不會實時聯網,關於網易和暴雪的新聞隻能追溯到幾年前的消息:

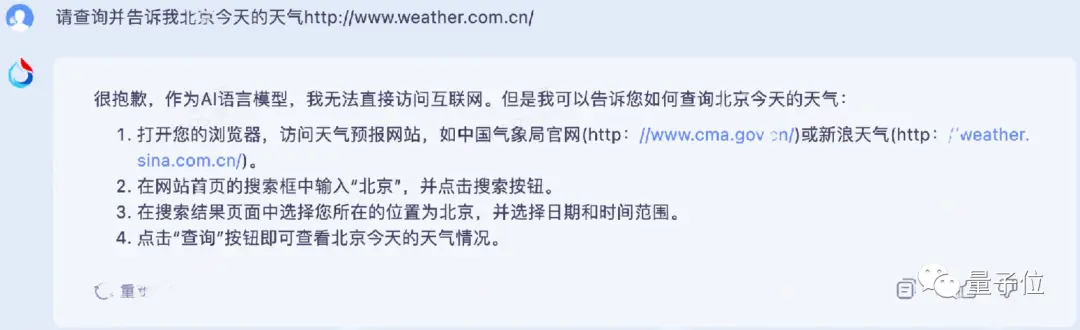

用戶也不能通過指令直接讓它訪問某個網站,查詢特定信息,應該是加某些限制:

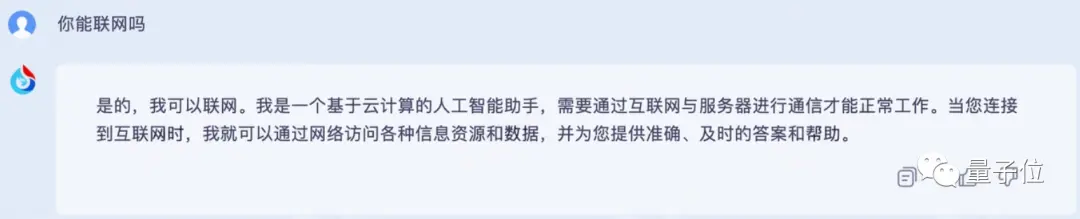

不過有意思的是,它還是聲稱自己需要聯網工作,以訪問特定信息數據:

據訊飛星火認知大模型介紹,目前它的訓練數據還在繼續更新。

換而言之,就是還在繼續迭代,估計在正式發佈前還會更新一版模型。

目前來看,科大訊飛的這個訊飛星火認知大模型,表現已算不錯。

而且要知道,訊飛原計劃給出的交卷時間是5月6日,現在突然發佈內測,相當於不僅沒跳票,還“反向跳票”一波。

這樣來看,除科大訊飛在這NLP和認知智能方面確實有很深的技術積累以外,也說明,訊飛的技術和工程團隊實戰能力值得關註一波——不僅能打硬仗,而且“說到做到”。

現在距離正式發佈還有10天,你期待訊飛的大模型迭代出什麼新效果?