隨著全球各國選舉的集中到來,Meta將在未來幾個月內開始對上傳到Facebook、Instagram和Threads的人工智能生成的照片進行標註。該公司還將開始懲罰那些不披露現實視頻或音頻是否由人工智能制作的用戶。

Meta 公司全球事務總裁尼克-克萊格(Nick Clegg)在接受采訪時說,隨著人工智能生成的媒體越來越難以辨別真假,這些措施旨在"激勵"科技行業。白宮一直在大力推動企業為人工智能生成的內容加上水印。克萊格說,與此同時,Meta 公司正在開發工具來檢測合成媒體,即使其元數據已被篡改,以掩蓋人工智能在創作中的作用。

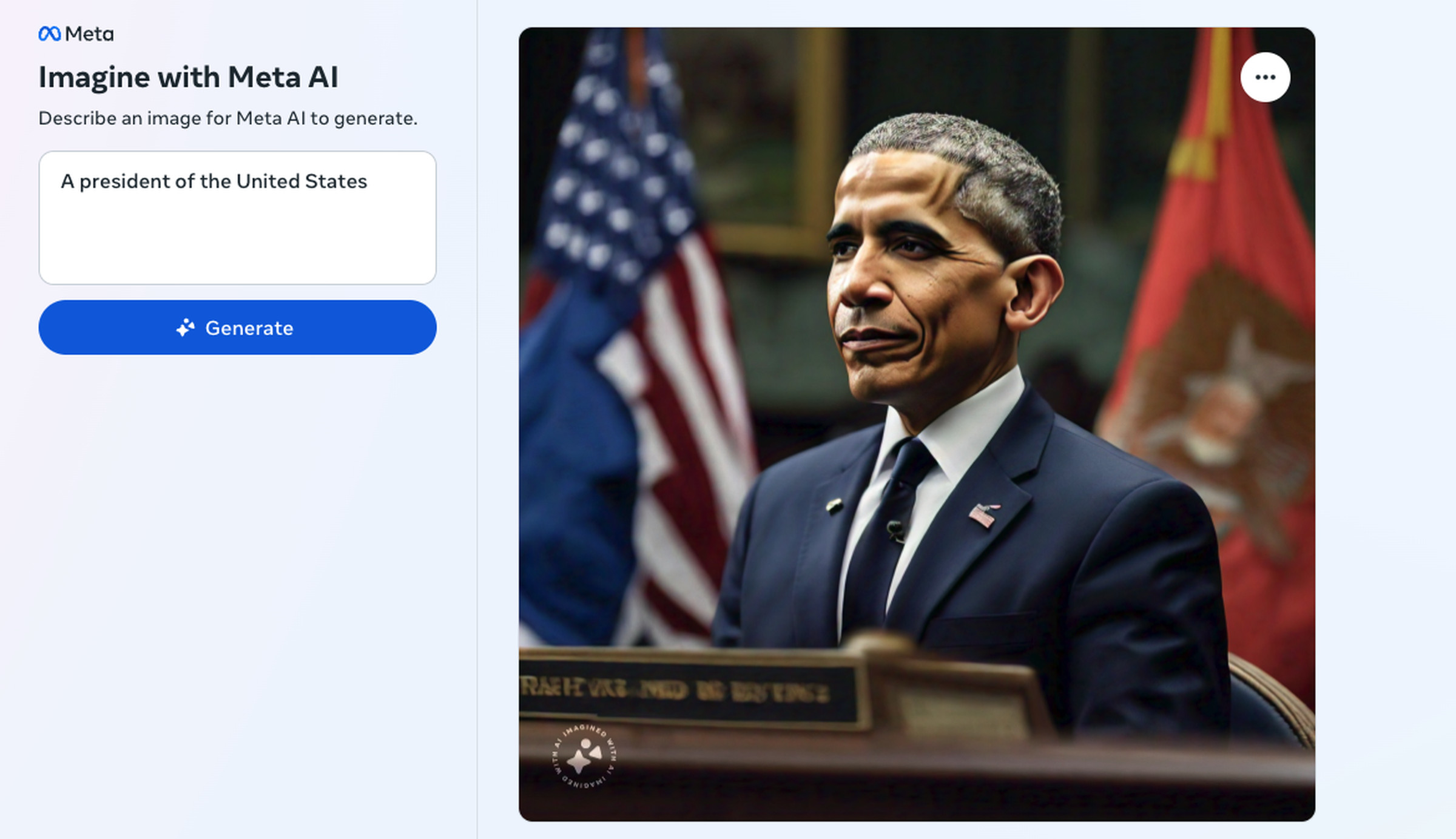

Meta 已經在使用自己的Imagine AI 生成器生成的圖片上打上"Imagined with AI"的水印,該公司還將開始在使用Google、OpenAI、微軟、Adobe、Midjourney 和 Shutterstock 的工具生成的人工智能照片上打上同樣的水印。克萊格說,在建立識別人工智能生成的視頻和音頻的標準方面,該行業遠遠落後於其他行業。雖然 Meta 對此類媒體如何被用於欺騙保持高度警惕,但該公司不可能靠自己抓住一切。

他說:"對於那些擔心視頻、音頻內容被設計用來在大選前的重要政治問題上欺騙公眾的人,我們將保持高度警惕。我是否認為有可能發生這樣的事情:無論多麼迅速地發現或迅速地貼上標簽,我們還是會被莫名其妙地指責掉鏈子?是的,我認為這是可能的,如果不是很有可能的話。"

Meta 公司一直在與人工智能合作夥伴關系等組織合作,在現有內容真實性計劃的基礎上進一步發展。Adobe 最近發佈內容憑證系統,將內容出處信息納入圖像元數據。Google在發佈針對圖片的測試版 SynthID 水印後,又將其擴展到音頻文件。

克萊格說,Meta 將很快開始要求用戶披露使用人工智能制作的逼真視頻或音頻帖子。他說,如果用戶不披露,"將受到從警告到刪除違規帖子的各種處罰"。

人工智能生成的政客病毒式帖子已經有很多例子,但克萊格低估這種現象在大選年席卷 Meta 平臺的可能性。他說:"我認為,我們不可能很快看到完全由人工合成的、具有重大政治意義的視頻或音頻。我隻是不認為事情會這樣發展"。

他說,Meta 還開始在內部測試使用根據社區標準訓練的大型語言模型(LLM),並稱其為數以萬計的人工審核員提供一種高效的"分流機制"。他說:"這似乎是一種非常有效且相當精確的方法,可以確保上報給我們人工審核員的內容確實是那種需要人工判斷的邊緣案例。"